언어모델학습

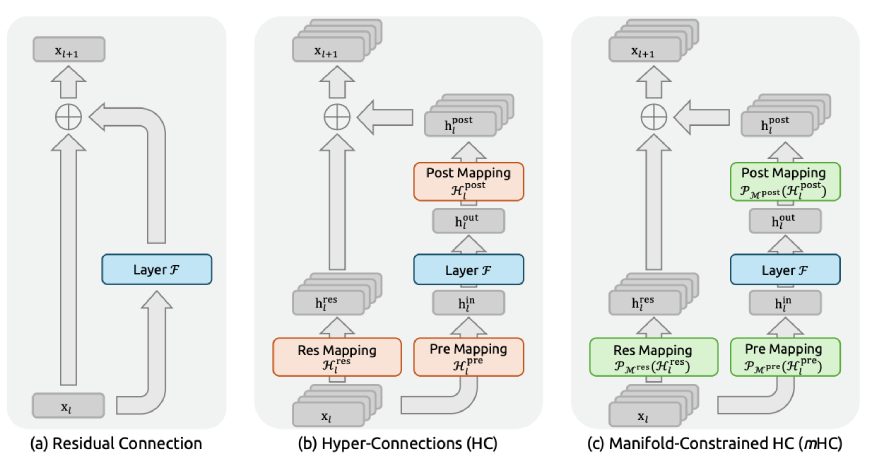

DeepSeek, AI 학습 불안정성을 3000배→1.6배로 잡다: mHC 아키텍처의 비밀

DeepSeek의 mHC 아키텍처가 대규모 AI 모델 학습의 불안정성 문제를 어떻게 해결했는지 소개합니다. 신호 증폭 3000배→1.6배 개선으로 안정성과 성능을 동시에 확보한 비결을 설명합니다.

Written by

데이터 고갈 시대의 해법: Diffusion 모델이 보여준 ‘크로스오버’ 현상

제한된 데이터로 학습 시 Diffusion 언어 모델이 기존 AR 모델보다 3배 효율적이라는 연구. 같은 데이터 반복 학습 시 나타나는 ‘크로스오버’ 현상을 소개합니다.

Written by