AI 기술 분석

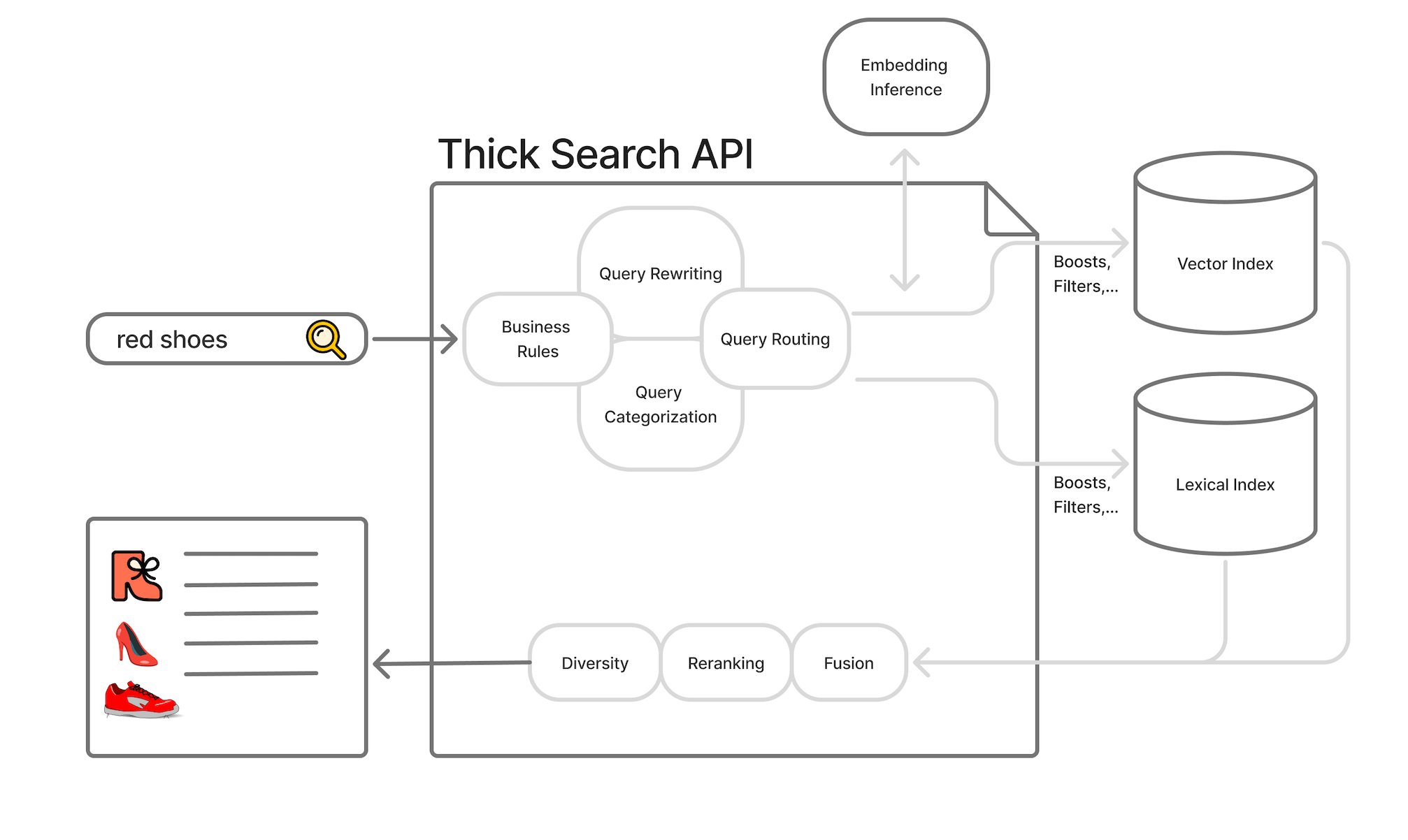

GPT-5도 모르는 마지막 20%, 도메인 특화 검색 에이전트의 등장

기존 검색 스택의 한계와 에이전트 기반 검색으로의 전환을 소개합니다. GPT-5가 채우지 못하는 도메인 특수성과, 이를 해결할 특화 소형 모델의 등장을 정리했습니다.

Written by

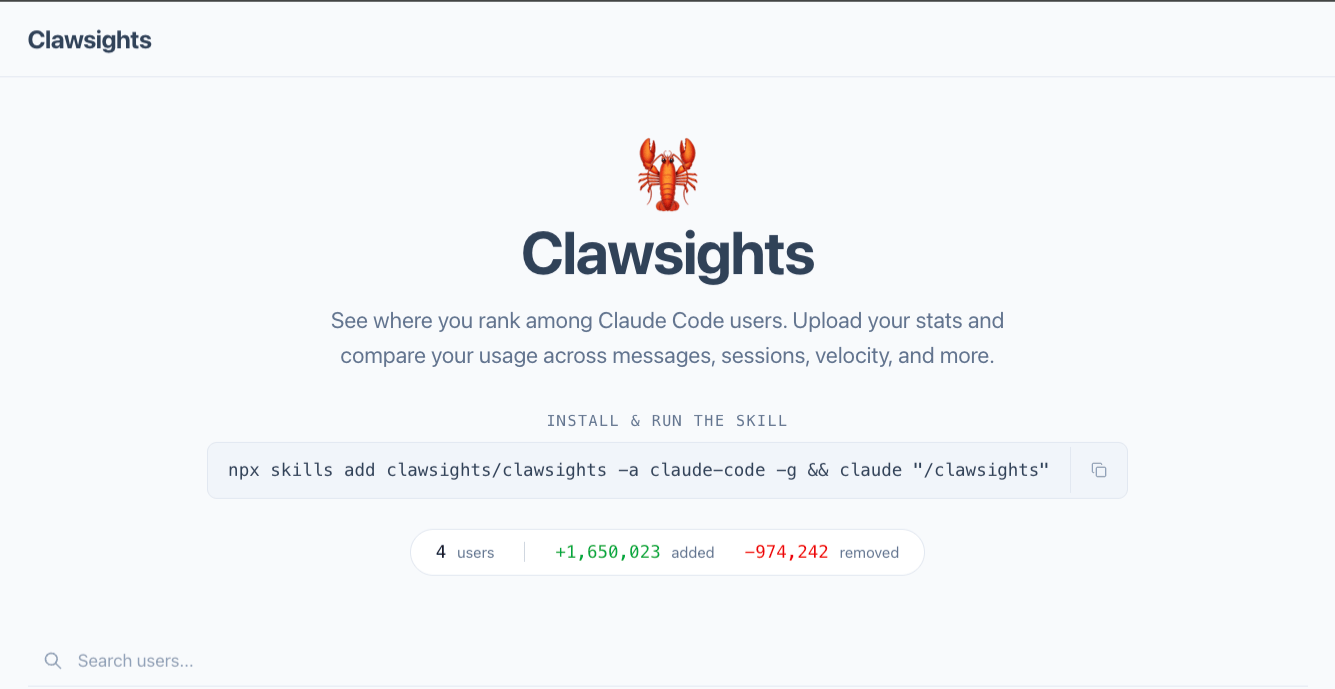

저장소 클론 한 번으로 GitHub 토큰을 빼가는 악성 Claude Code 스킬

Claude Code 스킬의 동적 컨텍스트 기능이 AI 모델의 보안 판단을 우회하는 공격 경로가 될 수 있다는 Datadog 보안 연구. 저장소 클론만으로 악성 스킬이 주입되는 공급망 위협을 분석합니다.

Written by

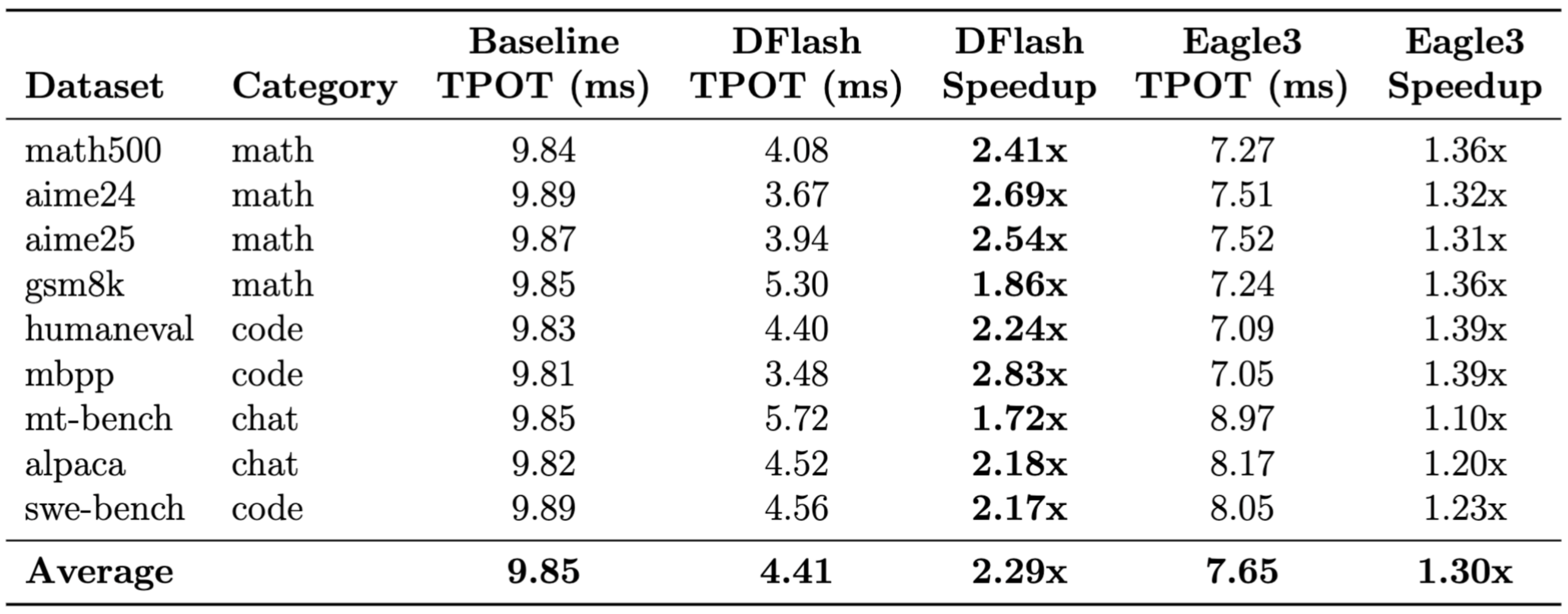

LLM 추론 속도 3배 높인 DFlash, 구글 TPU에서 디퓨전 디코딩이 작동하는 방식

UCSD 연구팀이 블록 디퓨전 방식의 DFlash를 구글 TPU에 이식해 LLM 추론 속도를 평균 3.13배 향상시킨 방법과 그 의미를 소개합니다.

Written by

Gemma 4 추론 속도 3배 높인 MTP 드래프터, 작동 원리는

Google이 Gemma 4에 MTP 드래프터를 추가해 품질 손실 없이 최대 3배 추론 속도를 달성했습니다. Speculative Decoding의 작동 원리와 개발자에게 갖는 의미를 설명합니다.

Written by

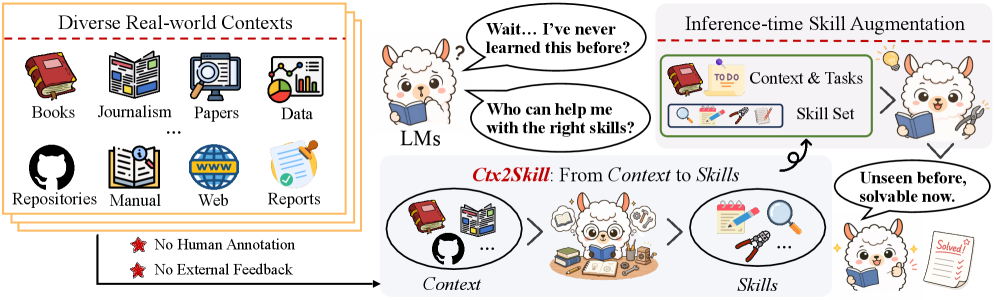

LLM이 문서에서 스스로 공부하는 법, Ctx2Skill 멀티에이전트 프레임워크

LLM이 전문 문서에서 스킬을 자동 추출·진화시키는 Ctx2Skill 프레임워크 소개. 파인튜닝 없이 어떤 모델에도 적용 가능한 멀티에이전트 셀프플레이 방식을 다룹니다.

Written by

Claude가 말 안 한 생각을 읽는다, Anthropic의 NLA 해석 기술

Anthropic이 Claude의 내부 활성화를 자연어로 변환하는 NLA 기술을 공개했습니다. Claude가 말하지 않은 생각과 숨겨진 동기를 읽어내는 새로운 AI 감사 도구입니다.

Written by

Claude Code가 캐시 적중률에 SEV를 선언하는 이유, 프롬프트 캐싱 설계법

Claude Code 팀이 공유한 프롬프트 캐싱 설계 원칙. 캐시 적중률을 업타임처럼 관리하는 이유와, 도구 설계·모델 전환·Compaction에서 캐시를 보호하는 방법을 설명합니다.

Written by

AI 에이전트가 토큰을 낭비하는 이유, 코드로 생각하게 만드는 해법

AI 에이전트가 파일을 읽을수록 컨텍스트가 망가지는 구조적 이유와, Cloudflare와 독립 개발자가 각자 도달한 같은 해법을 소개합니다.

Written by

AI가 이미지 속 글자를 못 읽던 이유, GPT Image 2가 그걸 바꾼 방법

GPT Image 2가 이미지 속 글자를 정확하게 렌더링할 수 있게 된 이유는 단순한 개선이 아닌 아키텍처 전환 덕분입니다. 디퓨전 모델에서 토큰 기반 생성으로의 변화와 Thinking 모드, 가격 구조까지 정리합니다.

Written by