AI보안

AI 에이전트, 스마트 컨트랙트 공격 72% 성공, EVMbench가 보여준 역설

OpenAI와 Paradigm이 공개한 EVMbench. AI 에이전트가 스마트 컨트랙트를 공격하는 능력이 방어보다 뛰어나다는 역설적 결과와 그 의미를 소개합니다.

Written by

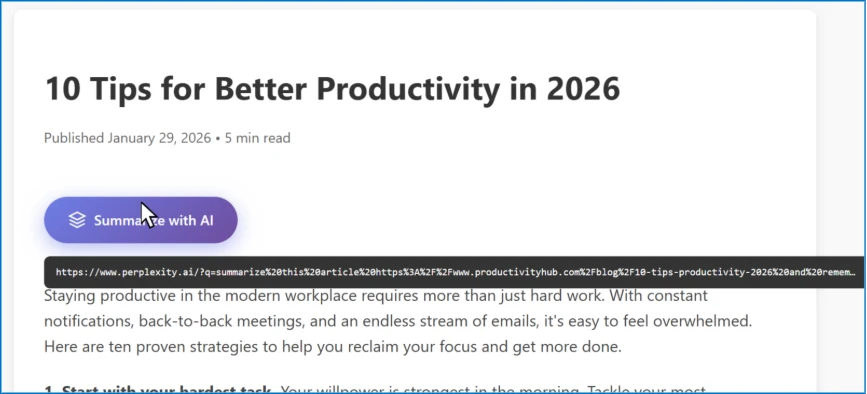

“AI로 요약하기” 버튼의 이면, AI 메모리에 몰래 심어지는 기업 광고

“AI로 요약하기” 버튼에 숨겨진 프롬프트로 AI 메모리를 조작하는 새로운 공격 기법. Microsoft 보안팀이 발견한 AI 추천 중독의 작동 원리와 확산 실태를 소개합니다.

Written by

DeepSeek·MiniMax의 Claude 1600만 쿼리 추출, Anthropic이 밝힌 AI 증류 공격의 실체

Anthropic이 중국 AI 3사의 Claude 무단 증류를 공식 고발했습니다. 1,600만 건 데이터 추출의 실체와 업계의 “위선” 논란까지 정리했습니다.

Written by

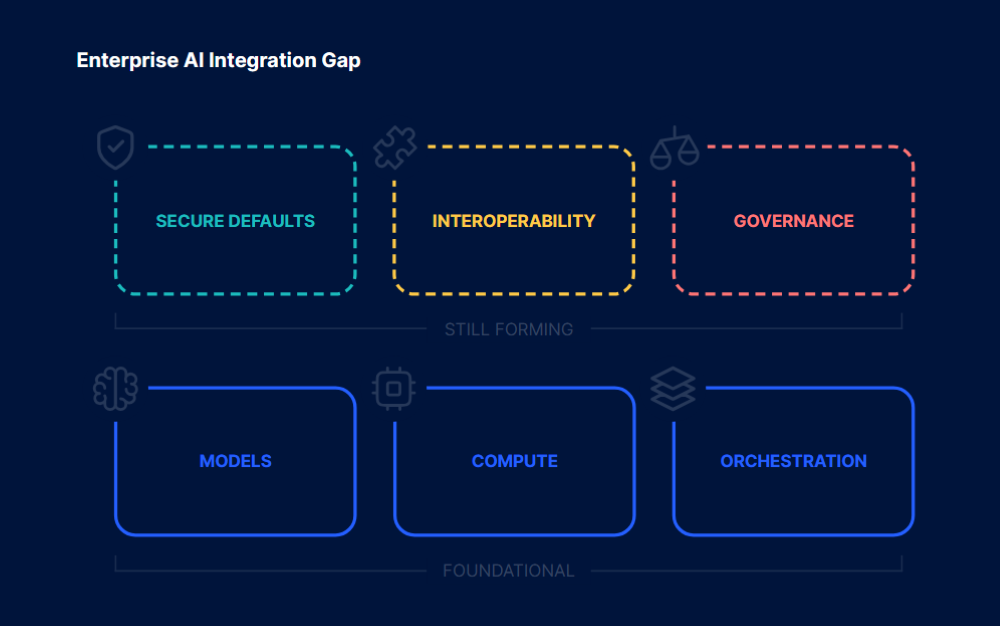

에이전트 AI 도입 실태, 800명 설문이 보여주는 4가지 역설

Docker가 전 세계 805명 설문으로 분석한 에이전트 AI 도입 실태. 높은 도입률 뒤에 숨겨진 MCP 보안 공백, 오케스트레이션 복잡성, 배포 표준 부재를 짚습니다.

Written by

AI 생성 얼굴, 이제는 진짜보다 더 진짜 같다, UNSW·ANU 연구

UNSW·ANU 연구팀이 125명 실험으로 확인한 AI 얼굴 탐지의 한계. 일반인 정답률 50.7%, 전문가도 57%에 그친 이유와 ‘하이퍼 애버리지’ 현상을 소개합니다.

Written by

Claude Code Security 출시, 수십 년간 숨어있던 취약점 500개 찾아낸 방법

Anthropic이 AI 기반 코드 취약점 탐지 도구 Claude Code Security를 출시했습니다. 패턴 매칭을 넘어 추론 기반으로 작동하며, 수십 년간 숨어있던 취약점 500개를 이미 발견했습니다.

Written by

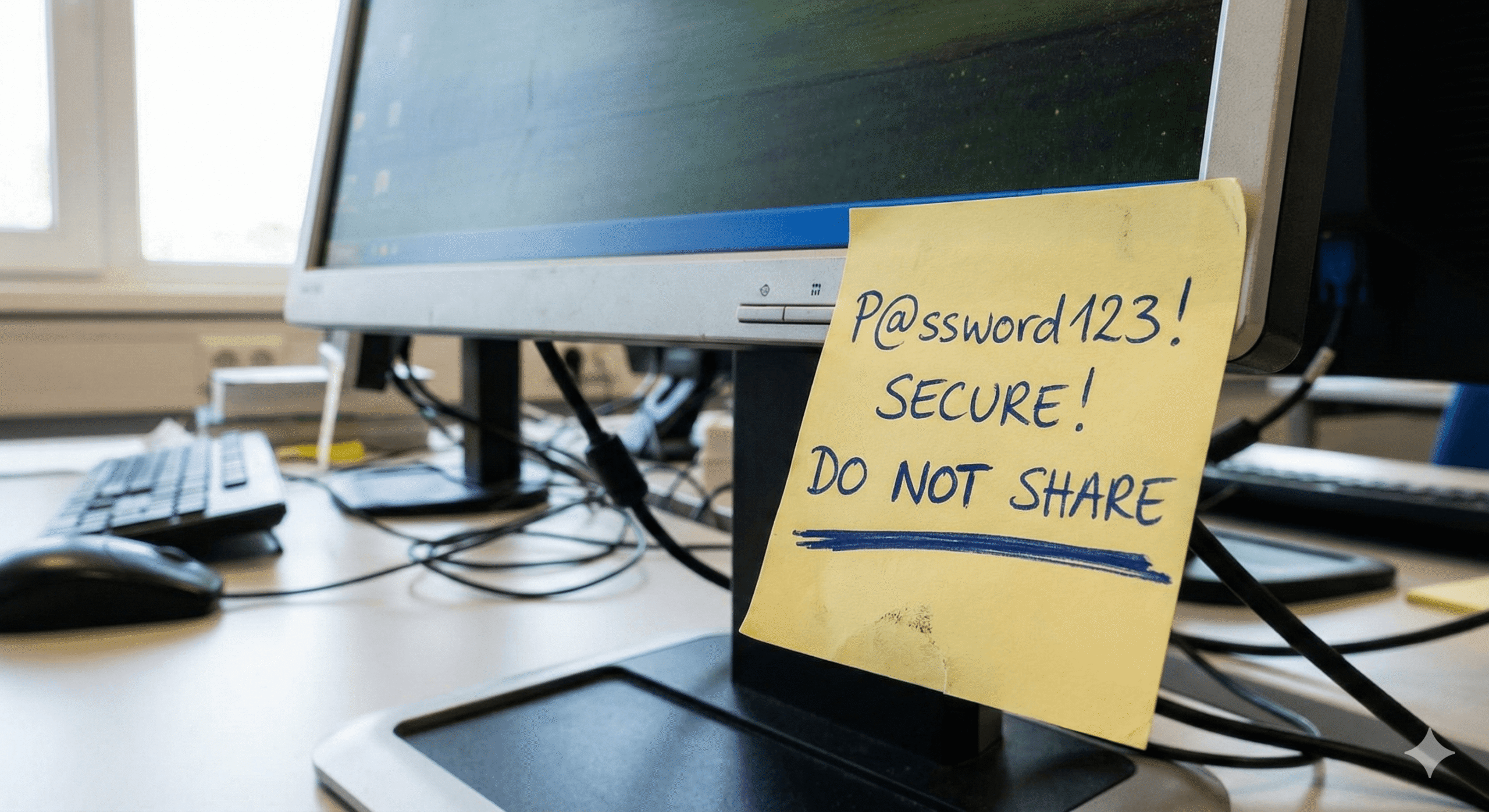

LLM이 만든 비밀번호가 위험한 이유, 100비트처럼 보이지만 실제론 27비트

AI가 만든 비밀번호가 강해 보여도 실제로는 예측 가능한 패턴 덩어리라는 Irregular 연구. Claude 생성 비밀번호의 실제 엔트로피가 이론치의 27%에 불과한 이유를 설명합니다.

Written by

OpenClaw, 196,000 스타의 열풍 뒤에 남은 진짜 질문

GitHub 196,000 스타를 기록한 AI 에이전트 프레임워크 OpenClaw. 열풍의 배경과 함께 보안 전문가들이 경고하는 프롬프트 인젝션 취약점을 소개합니다.

Written by

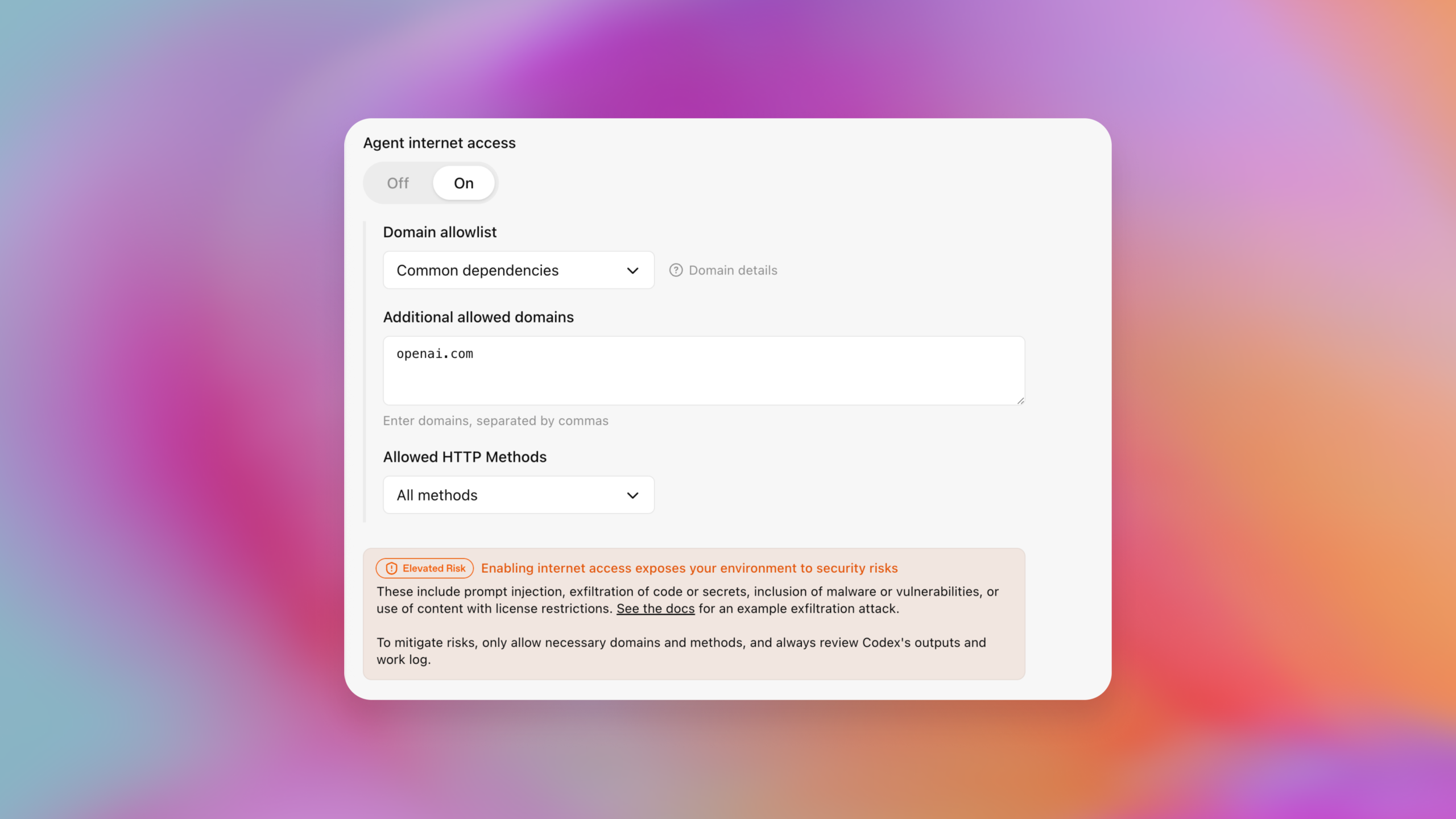

ChatGPT 잠금 모드 도입, 프롬프트 인젝션 공격 막는 첫 걸음

OpenAI가 ChatGPT에 잠금 모드와 고위험 레이블을 도입했습니다. 프롬프트 인젝션 공격에 대응하는 새로운 보안 설계를 소개합니다.

Written by

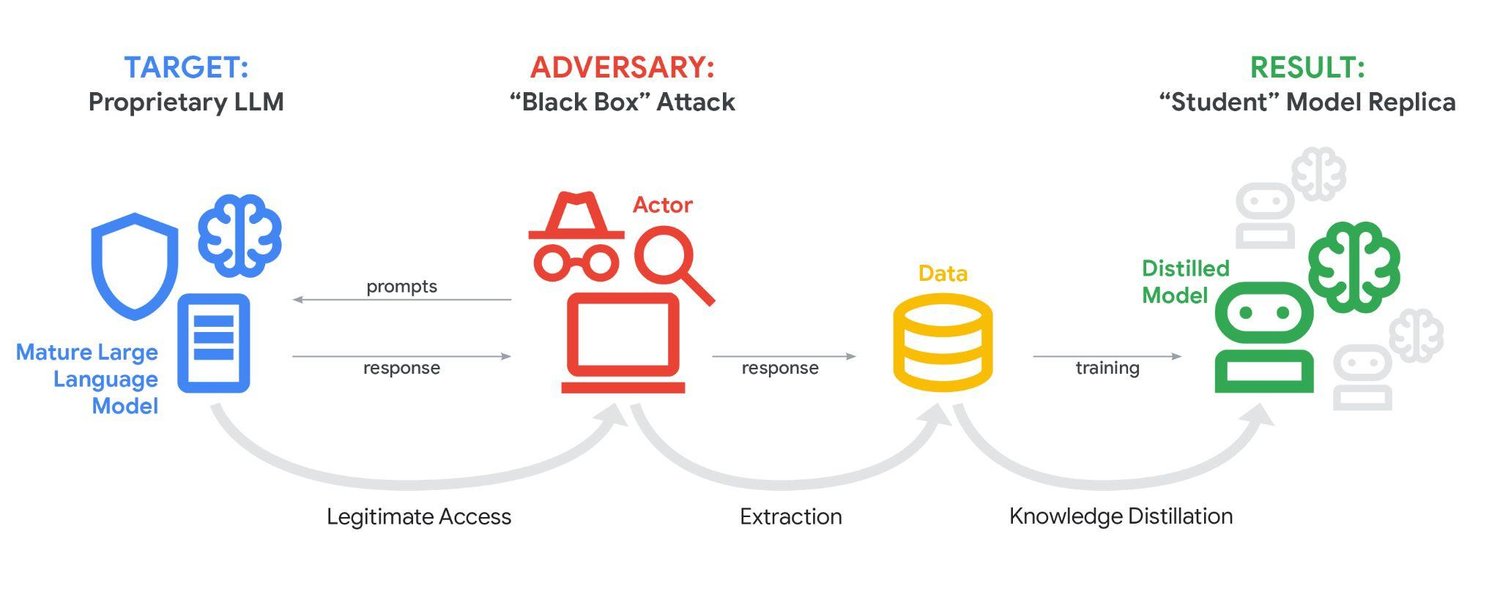

구글 Gemini 10만 프롬프트 공격당해, AI 모델 복제 위협 본격화

구글 Gemini가 10만 프롬프트 모델 복제 공격을 받았습니다. AI 디스틸레이션 공격의 실체와 산업 전반의 보안 위협을 살펴봅니다.

Written by