AI 검색 시스템이 답을 내놓기 전, 수십억 개의 웹페이지 중 관련 문서를 추려내는 첫 번째 필터가 있습니다. 바로 임베딩 모델입니다. 이 단계에서 놓친 문서는 이후 어떤 고성능 모델을 써도 되살릴 수 없습니다.

Perplexity가 자사의 텍스트 임베딩 모델 두 종을 오픈소스로 공개했습니다. pplx-embed-v1은 일반적인 고밀도 텍스트 검색용이고, pplx-embed-context-v1은 문서의 앞뒤 맥락을 함께 고려해 의미가 모호한 구절도 정확히 처리하는 컨텍스트 임베딩 모델입니다. 두 모델 모두 0.6B와 4B 파라미터 버전으로 제공되며, MTEB·ConTEB 등 주요 벤치마크에서 구글·알리바바·Anthropic 모델과 대등하거나 이를 앞서는 성능을 기록했습니다.

출처: Perplexity Embedding Models: State-of-the-Art for Web-Scale Retrieval – Perplexity Research

양방향으로 읽는 임베딩

대부분의 언어 모델은 텍스트를 왼쪽에서 오른쪽으로만 읽습니다. 각 단어는 앞에 나온 내용만 볼 수 있죠. 텍스트를 생성할 때는 문제없지만, 의미를 파악하는 데는 한계가 있습니다. 문장의 의도는 뒤에 나오는 내용에 따라 달라지는 경우가 많기 때문입니다.

Perplexity는 알리바바의 Qwen3 모델을 기반으로 출발해, 텍스트를 양방향으로 읽도록 구조를 변경했습니다. 이후 구글 BERT와 유사한 방식으로 학습시켰는데, 텍스트의 일부 단어를 무작위로 가린 뒤 앞뒤 문맥을 모두 활용해 빈칸을 맞추도록 훈련하는 방식입니다. 연구팀은 이를 ‘확산 사전학습(diffusion pre-training)’이라 부릅니다. 30개 언어, 약 2,500억 토큰으로 훈련했으며, 벤치마크 기준으로 기존 단방향 방식 대비 검색 정확도가 약 1%p 개선됐습니다.

한 가지 실용적인 장점도 있습니다. 경쟁 모델들은 입력마다 작업 유형을 설명하는 접두어(prefix)를 붙여야 하는데, 인덱싱 시점과 검색 시점에 이 접두어가 일치하지 않으면 오히려 품질이 떨어집니다. pplx-embed는 그런 접두어 없이도 작동합니다.

메모리를 최대 32배 줄이는 양자화

수십억 개의 웹페이지에 대한 임베딩 벡터를 저장하는 비용은 상당합니다. 일반적으로는 값 하나당 32비트 부동소수점(FP32)을 사용하는데, Perplexity는 처음부터 8비트 정수(INT8)를 쓰도록 학습해 메모리를 4배 줄였습니다. 성능 손실은 거의 없습니다.

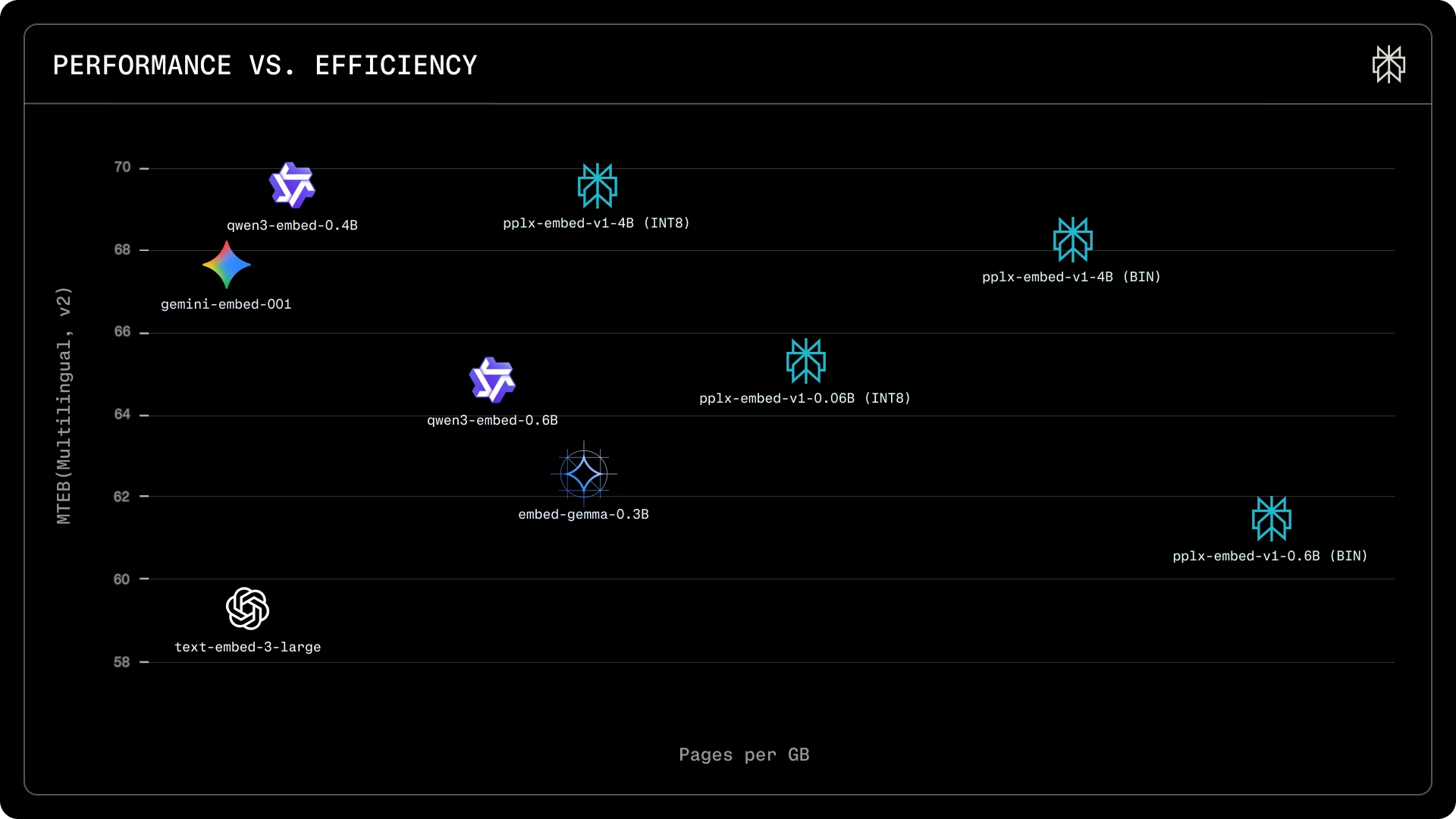

더 나아가 값 하나당 1비트만 쓰는 바이너리 방식도 지원합니다. 메모리를 32배 절약하는 대신 정확도가 일부 떨어지는데, 4B 모델 기준으로 손실은 1.6%p 미만이라고 합니다. 4B 모델은 2,560차원 벡터를 쓰는 반면 0.6B 모델은 1,024차원이라 압축 후에도 충분한 정보를 유지할 수 있기 때문입니다.

벤치마크: 공개 테스트와 실제 검색 트래픽

공개 벤치마크에서 pplx-embed-v1-4B는 MTEB 다국어 검색(nDCG@10) 기준 69.66%를 기록하며 Qwen3-Embedding-4B(69.60%)와 사실상 동률을 이루고, 구글 gemini-embedding-001(67.71%)을 앞섰습니다. 컨텍스트 임베딩 벤치마크인 ConTEB에서는 pplx-embed-context-v1-4B가 81.96%로, Voyage(79.45%)와 Anthropic(72.4%) 모델을 모두 제쳤습니다.

흥미로운 점은 Perplexity가 공개 벤치마크 외에 자체 내부 테스트도 공개했다는 것입니다. 실제 검색 쿼리 최대 11만 5,000건과 10억 개 이상의 웹사이트에서 추린 3,000만 건의 문서를 대상으로 한 테스트에서 격차가 더 벌어졌습니다. 내부 쿼리-문서 검색 테스트(PPLXQuery2Doc)에서 4B 모델은 상위 1,000개 결과 내 관련 문서 포함률이 91.7%로, Qwen3의 88.6%를 웃돌았습니다.

오픈소스, MIT 라이선스

네 가지 모델 모두 MIT 라이선스로 Hugging Face에 공개되어 있습니다. Transformers, SentenceTransformers, ONNX 등 주요 추론 프레임워크와 호환되며 Perplexity API를 통해서도 이용할 수 있습니다.

주목할 만한 지점은 Perplexity가 자사 검색 인프라의 핵심 부품을 그대로 오픈소스로 내놨다는 점입니다. 단순한 기술 시연이 아니라, 실제 웹 규모 검색에서 검증된 모델을 공개한 셈입니다. RAG 파이프라인을 구축하거나 검색 품질을 개선하려는 팀이라면 눈여겨볼 만한 선택지가 하나 더 생겼습니다. 기술 보고서와 전체 평가 결과는 원문에서 확인할 수 있습니다.

답글 남기기