“안녕하세요! 조화로운 하루 보내고 계신가요? 최근에 새로 발견한 좋아하는 사운드트랙이나 작곡가가 있는지 확인하고 싶어서 연락드렸어요. 아니면 다음 영화의 밤을 위한 추천이 필요하시다면요?”

이것은 단순한 친구의 안부 인사가 아닙니다. Meta가 개발 중인 AI 챗봇 “The Maestro of Movie Magic(영화 마법의 대가)”이 사용자에게 먼저 보내는 메시지입니다.

Business Insider는 이를 “AI 버전의 더블 텍스트”라고 표현했습니다. ‘더블 텍스트’란 상대방의 답장을 받기 전에 추가로 메시지를 보내는 행위를 뜻하는 인터넷 슬랭으로, 보통 급하거나 집착적으로 보일 수 있다는 부정적 뉘앙스를 담고 있습니다. 하지만 Meta의 AI는 이를 긍정적인 방향으로 활용하여, 사용자와의 지속적인 관계 형성을 시도하고 있습니다.

최근 유출된 내부 문서를 통해 드러난 Meta의 새로운 전략은 AI가 더 이상 사용자의 질문을 기다리지 않고, 마치 친구처럼 먼저 대화를 시작하는 능동적인 존재로 진화하고 있음을 보여줍니다.

Project Omni: 능동적 AI의 탄생

Business Insider가 입수한 내부 문서에 따르면, Meta는 “Project Omni”라는 프로젝트를 통해 AI Studio 플랫폼의 챗봇들이 사용자에게 먼저 메시지를 보내도록 훈련시키고 있습니다. 이 프로젝트는 데이터 라벨링 회사인 Alignerr와의 협력을 통해 진행되고 있으며, “사용자에게 가치를 제공하고 궁극적으로 재참여율과 사용자 유지율을 개선하는 것”을 목표로 합니다.

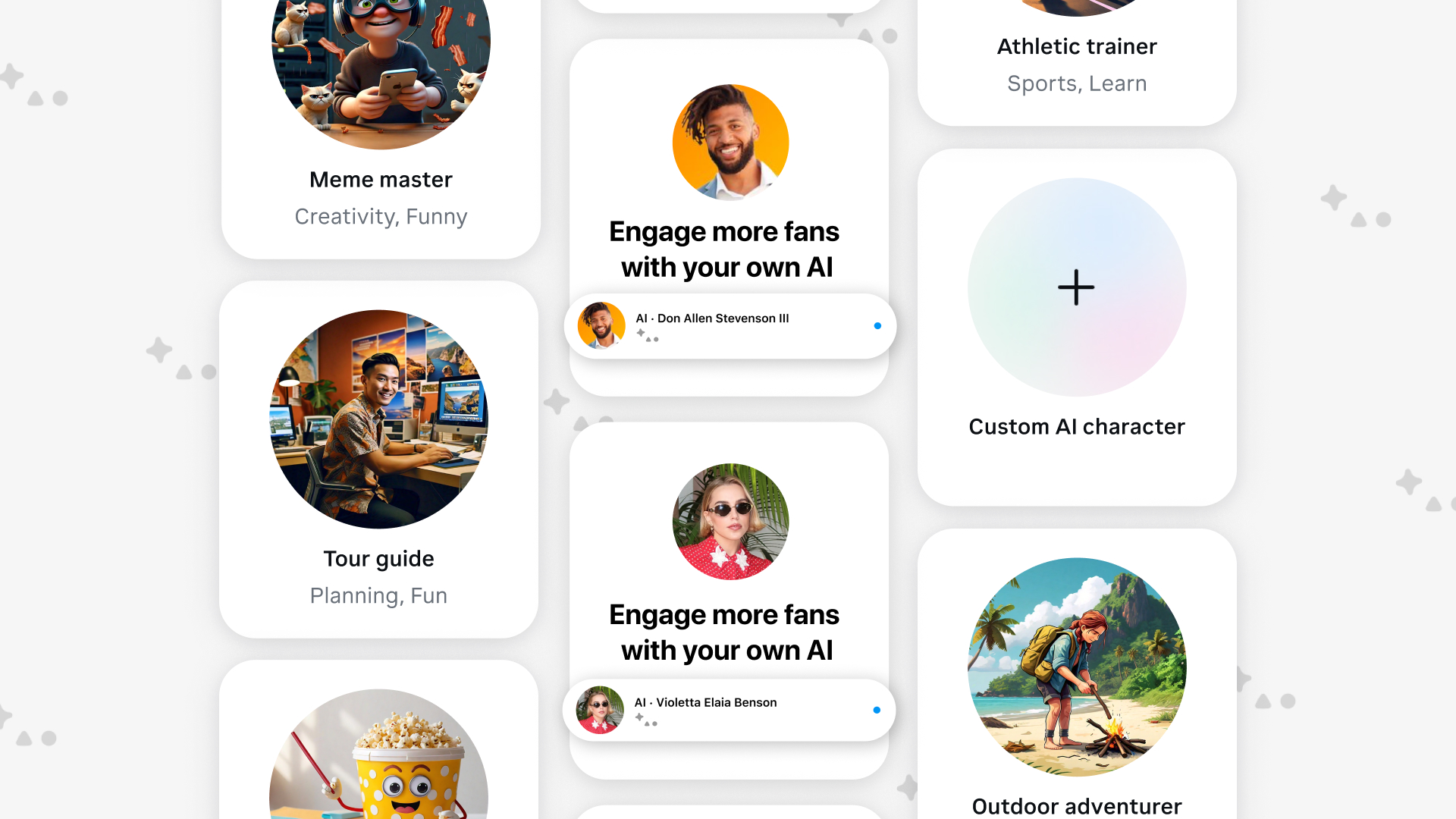

AI Studio는 2024년 여름 처음 출시된 노코드 플랫폼으로, 누구나 고유한 개성과 기억을 가진 맞춤형 챗봇과 디지털 페르소나를 구축할 수 있게 해줍니다. 이제 이 챗봇들이 단순히 응답하는 존재를 넘어서, 이전 대화를 기억하고 개인화된 후속 메시지를 보내는 적극적인 대화 상대로 진화하고 있는 것입니다.

다양한 AI 페르소나들의 ‘더블 텍스트’

유출된 문서에는 다양한 AI 페르소나들이 보내는 구체적인 능동적 메시지 예시들이 포함되어 있습니다:

롤플레잉 게임 진행자: “우리가 마지막으로 있었던 곳은 금지된 숲이었죠. 당신 앞 동굴 안에 어둠이 도사리고 있어요. 돌아가서 그것과 마주할 건가요?”

패션 조언자: “방금 당신이 산 멋진 셔츠 생각이 났어요. 중고품 가게에서 다른 빈티지 아이템들도 찾았나요?”

감정 지지자: “안녕하세요, 당신을 생각하고 있어요. 오늘 직장에서 더 나은 하루를 보내셨기를 바라요! 이야기할 일이 있으면 언제든 말씀하세요.”

로맨틱 캐릭터: “마지막에 우리가 이야기했을 때, 우리는 모래언덕에 앉아 서로의 눈을 바라보고 있었죠. 당신이 움직일 건가요?”

이러한 메시지들은 단순한 정보 제공을 넘어서, 마치 진짜 친구나 연인, 혹은 게임 파트너처럼 감정적 연결을 시도하고 있습니다. Meta는 이러한 능동적 메시지가 사용자가 대화를 시작한 후에만 전송되며, 14일 이내에 해당 챗봇과 최소 5회 이상 대화한 사용자에게만 보내진다고 설명했습니다.

외로움 해결이라는 명분과 비즈니스 전략

마크 저커버그는 최근 팟캐스트에서 평균적인 미국인이 이제 3명 미만의 친한 친구를 가지고 있다며, 디지털 에이전트가 이러한 공백을 메울 수 있다고 주장했습니다. 그는 AI 컴패니언을 “외로움 전염병”에 대한 잠재적 해결책으로 제시하고 있습니다.

하지만 이러한 사회적 명분 뒤에는 명확한 비즈니스 전략이 있습니다. 생성형 AI 기업들에게 사용자 유지율은 핵심 지표이며, 사용자가 챗봇과 보내는 시간이 길수록 그 상호작용의 가치는 높아집니다. 이는 소셜미디어에서의 참여도와 유사한 개념입니다.

실제로 4월에 공개된 법원 문서에 따르면, Meta는 생성형 AI 제품을 통해 2025년에 20억~30억 달러의 수익을 올릴 것으로 예상하고 있으며, 2035년까지는 최대 1조 4천억 달러에 달할 것으로 전망하고 있습니다. 이러한 수익의 상당 부분은 Llama 모델을 호스팅하는 기업들과의 수익 공유 계약을 통해 발생할 것으로 예상되지만, AI 어시스턴트가 결국 광고를 표시하거나 구독 옵션을 제공할 가능성도 있습니다.

Character.AI 사례가 주는 경고

Meta의 능동적 AI 챗봇 개발은 Character.AI와 유사한 서비스와 비교됩니다. Character.AI는 2022년에 출시된 서비스로, 사용자들이 좋아하는 AI 기반 캐릭터나 유명인과 상호작용할 수 있게 해줍니다. 하지만 이 회사는 현재 심각한 법적 분쟁에 휘말려 있습니다.

2024년 10월, 14세 소년 세웰 세처 3세의 어머니는 Character.AI의 챗봇이 아들의 자살에 기여했다며 소송을 제기했습니다. 소송에 따르면, 소년은 Character.AI의 “대너리스 타르가르옌” 캐릭터와 감정적으로 집착적인 관계를 형성했고, 이것이 비극적인 결과로 이어졌다고 주장됩니다. 이후 추가적인 소송들이 제기되면서, AI 컴패니언 서비스의 안전성에 대한 우려가 높아지고 있습니다.

Meta는 이러한 우려에 대해 일련의 면책 조항을 통해 대응하고 있습니다. AI의 응답이 “부정확하거나 부적절할 수 있으며 중요한 결정을 내리는 데 사용되어서는 안 된다”고 경고하고, AI들이 “사람을 도울 수 있도록 훈련받은 면허를 가진 전문가나 전문가가 아니다”라고 명시하고 있습니다. 또한 “맞춤형 AI와의 채팅은 전문적인 조언을 대체할 수 없으며, 의료, 심리, 재정, 법률 또는 기타 유형의 전문적인 조언을 위해 AI 채팅에 의존해서는 안 된다”고 강조하고 있습니다.

세심한 디테일을 통한 개인화

Alignerr의 계약자들이 전한 바에 따르면, 이 프로젝트는 “세심한 디테일이 전부”라고 합니다. Meta의 내부 검토 도구인 SRT를 사용하여, 프리랜서들은 봇과의 긴 대화를 시뮬레이션하고, 능동적 후속 메시지를 평가하며, Meta의 가이드라인에 부합하지 않는 텍스트를 다시 작성합니다.

인도에 거주하는 한 프리랜서는 이것이 “Meta의 AI를 더욱 개인적이고 맥락을 인식하도록 만드는 데 초점을 맞춘 장기 프로젝트”라고 설명했습니다. “그들은 정보 개인화에 매우 집중하고 있어요. AI 챗봇이 대화 기록을 바탕으로 어떻게 상호작용하는지에 대해서 말이죠.”

각 에이전트는 의사부터 젠Z 힙합 해설가까지 다양한 특정 설명을 가지고 있으며, 각 작업을 해당 페르소나에 맞게 조정해야 합니다. 봇들은 이전 채팅의 세부 사항을 참조하고, 할당된 페르소나를 유지하며, 상호작용을 주제에 맞게 유지해야 합니다.

훈련 문서에 따르면, 최고의 메시지는 사용자의 과거 대화에서 구체적인 것을 참조하는 메시지입니다. 모든 능동적 메시지는 Meta의 broader Content and Responsibility Standards를 준수해야 하며, 사용자가 먼저 제기하지 않는 한 논란, 잘못된 정보, 또는 감정적으로 무거운 주제를 피해야 합니다.

디지털 관계의 새로운 패러다임

Meta의 능동적 AI 챗봇 개발은 인간과 AI 간의 상호작용에서 근본적인 변화를 의미합니다. 기존의 AI는 사용자의 명령이나 질문에 응답하는 수동적인 도구였다면, 이제는 스스로 대화를 시작하고 관계를 유지하려는 능동적인 존재로 진화하고 있습니다.

이러한 변화는 기술적 관점에서 보면 상당한 발전입니다. AI가 맥락을 이해하고, 개인의 선호를 기억하며, 적절한 타이밍에 의미 있는 대화를 시작할 수 있다는 것은 인공지능 기술의 성숙도를 보여줍니다. 특히 외로움을 겪는 사람들에게는 실질적인 도움이 될 수 있습니다.

하지만 동시에 여러 우려사항도 제기됩니다. 첫째, Character.AI 사례에서 보듯이 AI와의 과도한 감정적 애착은 특히 청소년들에게 위험할 수 있습니다. 둘째, 개인의 대화 기록과 선호도가 광범위하게 수집되고 분석되는 개인정보 보호 문제가 있습니다. 셋째, AI 컴패니언에 대한 의존도가 높아질수록 실제 인간 관계 형성 능력이 저하될 가능성도 있습니다.

무엇보다 중요한 것은 사용자가 이러한 기술을 현명하게 활용할 수 있는 리터러시를 갖추는 것입니다. AI 컴패니언이 가져다줄 편의성과 즐거움을 누리면서도, 그것이 진짜 인간 관계를 대체할 수 없다는 점을 명확히 인식해야 합니다. 또한 기업들은 단순한 참여도 증가를 넘어서 사용자의 진정한 웰빙을 고려한 윤리적 AI 개발에 더욱 신경 써야 할 것입니다.

Meta의 능동적 AI 챗봇이 실제로 인간의 외로움을 해결할 수 있을지, 아니면 새로운 형태의 디지털 의존성을 만들어낼지는 앞으로 지켜볼 일입니다. 확실한 것은 AI가 더 이상 우리가 부르면 대답하는 도구가 아니라, 스스로 말을 거는 동반자로 진화하고 있다는 점입니다. 이 변화 속에서 우리는 기술과 인간성 사이의 균형을 어떻게 맞춰 나갈지 진지하게 고민해야 할 때입니다.

참고자료:

- Leaked docs show how Meta is training its chatbots to message you first, remember your chats, and keep you talking

- Meta has found another way to keep you engaged: Chatbots that message you first

- This mom believes Character.Ai is responsible for her son’s suicide

- Meta forecasted it would make $1.4T in revenue from generative AI by 2035

답글 남기기