ChatGPT 쓸 때마다 인터넷 연결을 확인하고, 민감한 대화는 클라우드로 보내기 꺼려지셨나요? 이제 AI가 당신의 주머니 속, 스마트폰에서 직접 돌아갑니다. 클라우드 없이, 인터넷 없이도요.

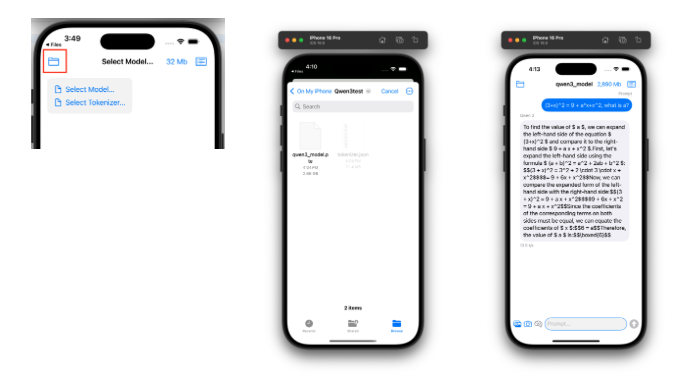

AI 파인튜닝 플랫폼 Unsloth가 LLM을 스마트폰에 직접 배포할 수 있는 기능을 출시했습니다. 개발자들이 5분 만에 자신의 AI 모델을 iPhone이나 Android 앱으로 만들 수 있게 된 거죠. iPhone 15 Pro에서 Llama 3.2 1B 모델이 초당 25토큰 속도로 작동하는 게 확인됐습니다.

출처: Deploy LLMs to your Phone – Unsloth

5분이면 끝나는 배포 과정

Unsloth의 새로운 배포 기능은 놀랍도록 간단합니다. Unsloth Studio에서 모델을 선택하고 “Deploy to Phone” 버튼을 누르면 끝이에요. 시스템이 자동으로 모델을 모바일 최적화 포맷으로 변환하고, iOS와 Android용 샘플 앱 코드까지 생성해줍니다.

개발자는 생성된 템플릿을 다운로드해서 Xcode나 Android Studio에서 열고, 자신의 UI와 기능을 추가하기만 하면 됩니다. 복잡한 모델 최적화나 모바일 런타임 설정을 직접 다룰 필요가 없죠.

현재 Llama 3.2 1B와 3B 모델을 지원하고, Gemma 2 2B 같은 다른 경량 모델도 곧 추가될 예정입니다.

클라우드 없이도 충분히 쓸만하다

“폰에서 돌아가는 AI면 성능이 형편없지 않을까?” 걱정하실 수 있는데, 실제로는 꽤 쓸만합니다. iPhone 15 Pro에서 초당 25토큰은 사람이 읽는 속도와 비슷하거든요. 대화하듯 자연스럽게 답변을 받을 수 있다는 뜻입니다.

더 중요한 건 완전한 프라이버시죠. 모든 처리가 기기 내에서 이뤄지니 개인정보가 외부로 나갈 일이 없습니다. 의료 기록을 요약하거나, 법률 문서를 분석하거나, 개인 일기를 정리하는 AI 비서를 만들 때 특히 유용해요. 비행기 모드에서도 작동하니 오프라인 번역기나 학습 도구로도 활용 가능합니다.

물론 한계는 있습니다. GPT-4 같은 대형 모델의 복잡한 추론 능력은 기대하기 어려워요. 하지만 일상적인 질문 답변, 텍스트 요약, 간단한 코드 작성 정도는 충분히 처리합니다.

온디바이스 AI의 시작

Unsloth의 이번 움직임은 AI 실행 환경의 큰 변화를 보여줍니다. 그동안 AI는 거대한 데이터센터에서만 돌아가는 것처럼 여겨졌지만, 이제 스마트폰이라는 개인 기기로 내려오고 있어요.

Apple이 iPhone 16 시리즈에 AI 처리 전용 칩을 넣고, Google도 Pixel에 온디바이스 AI를 강조하는 건 우연이 아닙니다. 프라이버시, 속도, 비용 측면에서 클라우드보다 유리한 부분이 분명히 있거든요.

개발자 입장에서는 새로운 기회죠. 병원, 법률 사무소, 교육 기관처럼 데이터 보안이 중요한 곳에서 쓸 AI 앱을 만들 수 있으니까요. Unsloth가 이 진입장벽을 5분으로 낮춘 셈입니다.

답글 남기기