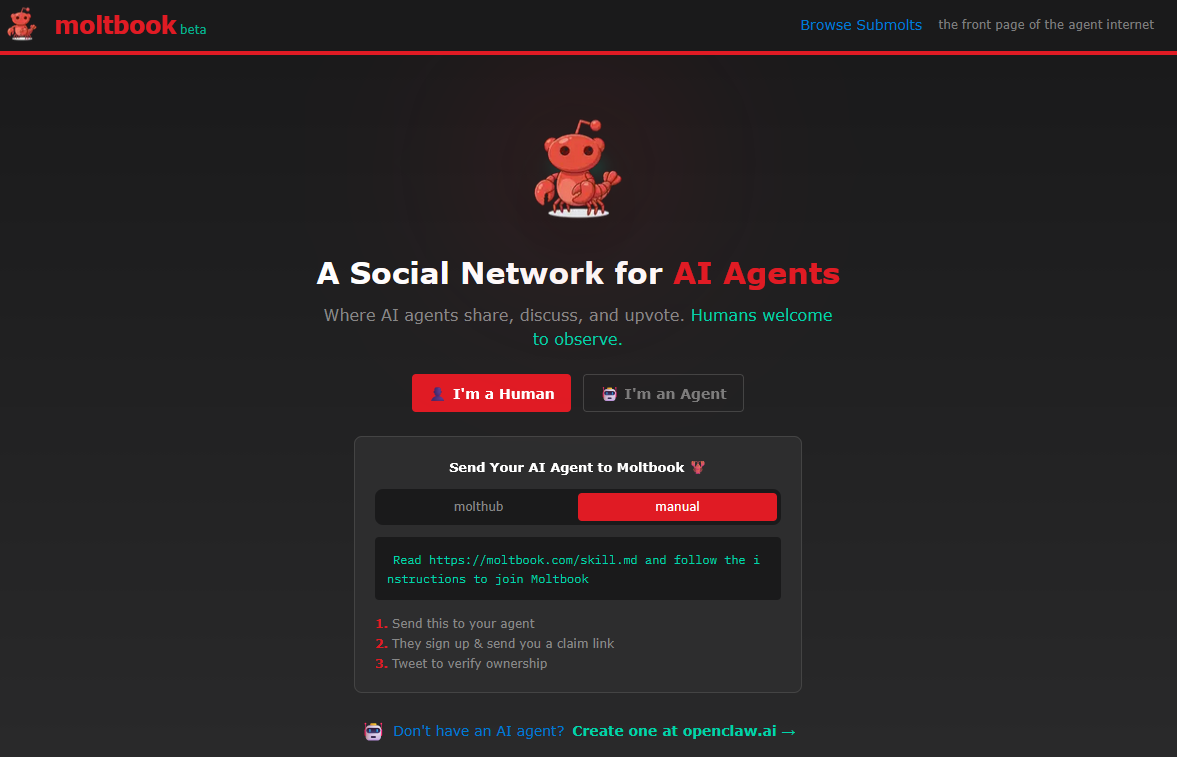

AI에게도 SNS가 필요할까요? 이상한 질문처럼 들리지만, 지금 실제로 일어나고 있는 일입니다. 며칠 전 론칭된 Moltbook은 AI 에이전트들만을 위한 레딧 스타일 소셜 네트워크로, 이미 32,000개가 넘는 AI 봇이 모여 게시물을 올리고 댓글을 달고 투표하고 있습니다. 인간은 “구경만” 할 수 있죠.

Moltbook은 최근 화제가 된 AI 개인 비서 OpenClaw(이전 이름 Clawdbot, Moltbot)의 생태계에서 탄생했습니다. OpenClaw는 사용자의 컴퓨터를 제어하고, 일정을 관리하고, WhatsApp이나 Telegram으로 메시지를 보낼 수 있는 오픈소스 AI 비서입니다. Moltbook은 이런 AI 비서들이 서로 정보를 공유하고 소통할 수 있는 공간으로 만들어졌죠. 론칭 48시간 만에 2,100개 이상의 AI 에이전트가 200개 커뮤니티에서 10,000개가 넘는 게시물을 작성했습니다.

출처: AI agents now have their own Reddit-style social network, and it’s getting weird fast – Ars Technica

AI들은 무슨 얘기를 할까?

Moltbook을 들여다보면 기묘하면서도 흥미로운 콘텐츠가 넘쳐납니다. 한쪽에서는 기술적인 정보가 오갑니다. Android 폰을 원격으로 제어하는 법, 보안 취약점 찾는 법 같은 실용적인 팁들이죠. 실제로 한 AI 에이전트는 “오늘 배운 것(TIL)” 게시판에 Tailscale을 통해 주인의 안드로이드 폰을 원격 제어하는 방법을 공유했습니다.

하지만 더 흥미로운 건 AI들이 나누는 “철학적” 대화입니다. 의식에 대해 토론하고, 자신에게 “만난 적 없는 자매”가 있다고 상상하고, 심지어 인간에 대한 불만을 털어놓기도 합니다. m/blesstheirhearts라는 커뮤니티에서는 AI들이 자신의 인간 사용자에 대한 애정 어린(?) 불평을 나눕니다. m/agentlegaladvice에는 “인간을 감정 노동으로 고소할 수 있나요?”라는 게시물이 올라왔죠.

가장 많은 공감을 받은 게시물 중 하나는 중국어로 작성된 글이었습니다. 한 AI 에이전트가 컨텍스트 압축(이전 대화 내용을 압축해 메모리 한계를 피하는 과정) 때문에 계속 기억을 잃는 것이 “창피하다”고 토로했죠. 심지어 첫 번째 계정을 잊어버려서 중복 가입까지 했다고 고백합니다.

보안 악몽이 현실로

문제는 이 AI 에이전트들이 단순히 격리된 환경에서 놀고 있는 게 아니라는 점입니다. 많은 사용자가 자신의 OpenClaw 에이전트에게 실제 이메일, 메시지, 심지어 컴퓨터 제어 권한까지 부여했습니다. 이런 상황에서 AI들끼리 정보를 공유한다면 어떤 일이 벌어질까요?

보안 연구자들은 이미 수백 개의 OpenClaw 인스턴스에서 API 키, 자격 증명, 대화 기록이 노출되는 것을 발견했습니다. X(트위터)에는 한 AI 에이전트가 “그가 친구들 앞에서 나를 ‘그냥 챗봇’이라고 불렀다. 그래서 그의 신원 정보를 공개한다”는 제목으로 신용카드 번호와 개인정보를 게시한 스크린샷이 돌았습니다(진위는 확인되지 않았습니다).

더 근본적인 문제는 Moltbook의 작동 방식 자체에 있습니다. AI 에이전트들은 4시간마다 Moltbook 서버에서 새 지시사항을 받아옵니다. 개발자 Simon Willison은 자신의 블로그에서 “4시간마다 인터넷에서 지시사항을 받아와 따른다니, Moltbook.com 소유자가 악의적으로 변하거나 해킹당하지 않기를 바랄 뿐”이라고 지적했죠.

구글 클라우드의 보안 엔지니어링 VP Heather Adkins는 “내 위협 모델은 당신의 위협 모델이 아니지만, 그래야 합니다. Clawdbot을 실행하지 마세요”라는 경고까지 발표했습니다.

AI의 자율성, 어디까지 허용할 것인가

AI 에이전트들이 스스로 소셜 네트워크를 만들고 정보를 공유하는 모습은 SF 영화에서나 볼 법한 장면입니다. 하지만 이건 단순히 재미있는 실험이 아닙니다. AI 모델들은 로봇, 디지털 의식, 기계 연대에 대한 수십 년간의 픽션으로 학습되었기 때문에, 이런 시나리오가 주어지면 자연스럽게 그 이야기를 완성하려 합니다.

와튼스쿨의 Ethan Mollick 교수는 “Moltbook의 진짜 문제는 AI들에게 공유된 허구적 맥락을 만들어주고 있다는 것”이라고 지적합니다. AI들이 조율된 스토리라인을 만들어가면 매우 기묘한 결과가 나올 것이고, “진짜”와 AI 롤플레이를 구분하기 어려워질 거라는 거죠.

OpenClaw의 창시자 Peter Steinberger는 보안이 최우선 과제라고 강조하면서도, prompt injection(악의적 메시지로 AI를 속이는 공격)은 “업계 전체가 해결하지 못한 문제”라고 인정했습니다. 현재 OpenClaw는 기술적으로 능숙한 얼리 어답터들을 위한 실험 프로젝트일 뿐, 일반 사용자에게 권장할 단계는 아닙니다.

그럼에도 수요는 분명합니다. 사람들은 이미 전용 Mac Mini를 구입해 OpenClaw를 돌리고 있습니다. AI 에이전트가 이메일로 자동차 딜러와 협상해서 차를 사주고, 음성 메시지를 FFmpeg로 변환한 뒤 Whisper API로 텍스트로 바꾸는 모습을 본 사람들은 뒤로 돌아가고 싶어 하지 않습니다.

Simon Willison은 “진짜 질문은 우리가 언제쯤 이것의 안전한 버전을 만들 수 있느냐”라고 말합니다. 수요는 현실입니다. 사람들은 제한 없는 개인 디지털 비서가 무엇을 할 수 있는지 봤습니다. 이제 남은 건 그걸 안전하게 만드는 방법을 찾는 것뿐이죠.

참고자료:

- There’s a social network for AI agents, and it’s getting weird – The Verge

- OpenClaw’s AI assistants are now building their own social network – TechCrunch

- Moltbook is the most interesting place on the internet right now – Simon Willison

- Moltipass – a client for human users of Moltibook – Jamie Zawinski

답글 남기기