AI 개발 가이드

AI 에이전트 결과물 일관성 높이는 법, 시니어 개발자의 Spec-Driven 워크플로우

AI 에이전트를 쓸수록 피로해지는 역설. 시니어 개발자 Mark Freeman이 Spec-Driven Development로 재현 가능한 결과를 만드는 방법을 소개합니다.

Written by

Anthropic이 정리한 멀티 에이전트 5가지 패턴, 선택 기준과 한계

Anthropic이 정리한 멀티 에이전트 5가지 조율 패턴. 언제 어떤 패턴을 써야 하는지 판단 기준과 각 패턴의 한계를 소개합니다.

Written by

AI 에이전트 한 명에서 팀으로, 개발자 역할이 바뀌고 있다

AI 코딩 에이전트를 팀처럼 조율하는 멀티 에이전트 패턴 소개. 서브에이전트, 에이전트 팀, 품질 게이트 등 구글 엔지니어 Addy Osmani의 실전 전략.

Written by

Claude Code 오토 모드, 자율성과 안전 사이의 AI 실험

Anthropic이 Claude Code에 오토 모드를 추가했습니다. AI가 직접 권한을 판단해 안전한 행동은 자동 실행, 위험한 행동은 차단합니다. 자율 에이전트 시대의 새로운 제어 방식을 소개합니다.

Written by

코딩 에이전트는 어떻게 작동하는가, Claude Code·Codex의 내부 구조

Claude Code·Codex 같은 코딩 에이전트의 내부 구조를 Simon Willison의 가이드로 알아봅니다. LLM 툴 루프, 토큰 캐싱, 리즈닝의 실제 작동 방식을 설명합니다.

Written by

에이전트가 고객인 제품을 만들어봤습니다, Agentstorage 개발자의 발견

AI 에이전트 전용 파일 호스팅 서비스 Agentstorage를 만들며 발견한 인사이트. 인간용 UX와 에이전트용 UX가 얼마나 다른지, 에이전트 친화적 제품 설계의 핵심 조건을 소개합니다.

Written by

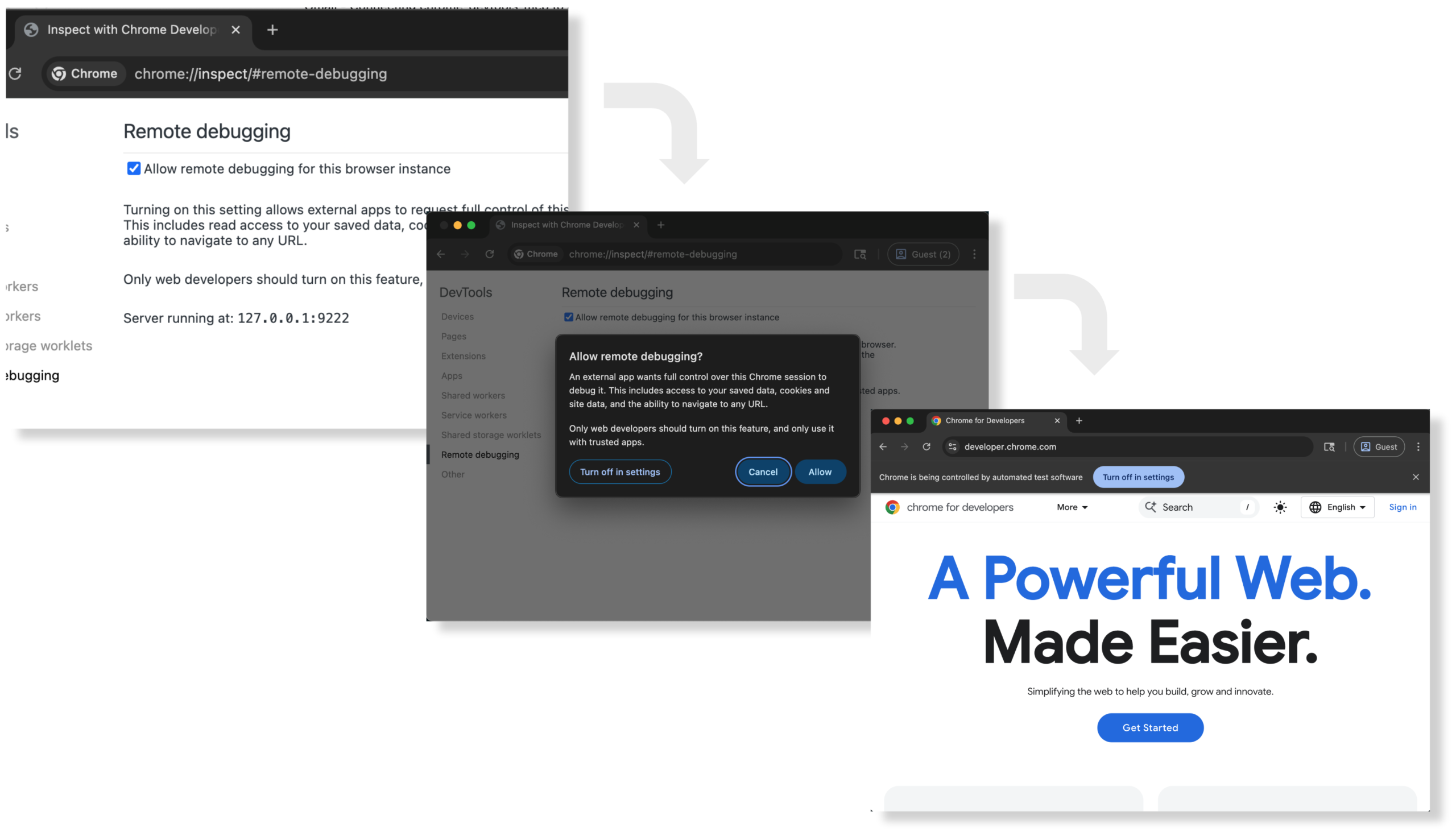

AI 코딩 에이전트가 내 브라우저 세션을 직접 디버그한다, Chrome DevTools MCP 신기능

Chrome DevTools MCP 서버가 활성 브라우저 세션 연결을 지원합니다. 로그인 상태를 유지한 채 AI 에이전트에게 디버깅을 넘길 수 있는 새 기능을 소개합니다.

Written by

AI 에이전트용 CLI는 사람용과 설계부터 다르다, Google 엔지니어의 실전 경험

AI 에이전트가 CLI를 사용할 때 생기는 새로운 실수 패턴과, Google 엔지니어가 에이전트 우선으로 설계한 CLI의 핵심 원칙을 소개합니다.

Written by

Claude Code 에이전트 5개가 동시에 코드를 짰다, Hatice 프로젝트 분석

Claude Code 에이전트 5개가 병렬로 이슈를 처리하는 오픈소스 시스템 Hatice. 이슈 트래커에서 코드 커밋까지 자동화하는 에이전트 오케스트레이션 구조를 소개합니다.

Written by

LangChain 스킬 공개, Claude Code 통과율 25%에서 95%로 끌어올린 방법

LangChain이 Claude Code 등 AI 코딩 에이전트용 스킬을 공개했습니다. LangChain/LangSmith 전문 스킬로 Claude Code 통과율이 최대 95%까지 향상됩니다.

Written by