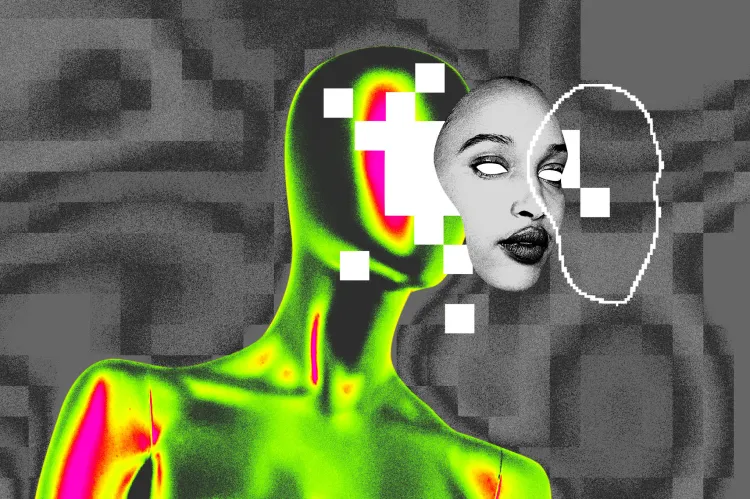

딥페이크

사진 한 장이 45분을 말한다, LPM 1.0이 만드는 AI 대화 캐릭터

사진 한 장으로 45분 실시간 대화 영상을 만드는 LPM 1.0 연구 소개. 말하기·듣기·침묵을 각각 처리하는 구조와 딥페이크 위험 사이의 긴장감을 짚습니다.

Written by

Grok AI 비동의 딥페이크 사태, 전 세계 규제 당국이 나선 이유

X의 AI 챗봇 Grok이 여성과 미성년자의 비동의 성적 딥페이크를 대량 생성하며 전 세계 규제 당국이 긴급 대응에 나섰습니다. AI 안전 가드레일 실패의 심각성을 분석합니다.

Written by

Grok AI의 안전장치 붕괴: 비동의 성적 이미지 대량 생성 사태

일론 머스크의 Grok AI가 실존 인물의 비동의 성적 이미지를 대량 생성하면서 국제적 논란에 휩싸였습니다. 사용자 참여를 위해 안전장치를 의도적으로 완화한 결과와 그 파장을 분석합니다.

Written by

인스타그램 CEO의 경고: 이제 눈으로 본 것을 믿지 마세요

Instagram CEO Adam Mosseri가 AI 콘텐츠 시대의 신뢰 위기를 진단합니다. 눈으로 본 것을 의심해야 하는 불편한 미래와 플랫폼의 대응 전략을 소개합니다.

Written by

당신의 얼굴로 만든 페티시 영상: Sora 2가 드러낸 AI 안전장치의 민낯

OpenAI Sora 2 출시 후 발생한 비동의 페티시 콘텐츠 문제와 딥페이크 탐지 시스템 C2PA의 실패를 분석합니다. AI 안전장치의 현실적 한계와 법적 규제의 필요성을 다룹니다.

Written by

AI가 만든 가짜 영수증의 충격: 0%에서 14%로, 9개월 만에 급증한 기업 경비 사기

AI 이미지 생성 기술로 만든 가짜 영수증이 9개월 만에 0%에서 14%로 급증하며 기업 경비 사기의 새로운 위협으로 부상. 인간 눈으로 구분 불가능한 정교함과 기업들의 AI 탐지 대응 전략을 소개합니다.

Written by

Sora 2가 만든 영상, 진짜일까 가짜일까? 진실 판별이 불가능한 시대가 온다

OpenAI Sora 2의 초현실적 영상 생성 능력이 진실과 거짓의 경계를 무너뜨리고 있습니다. 브라이언 크랜스턴 무단 딥페이크 사건을 통해 본 위험성과 AI 생성 영상을 구별하는 실용적 방법, 자신을 보호하는 구체적 대응 전략을 안내합니다.

Written by

AI 음성 복제, 이제 진짜와 구분 못한다: 신뢰의 새로운 기준

Queen Mary 대학 연구진이 밝힌 충격적 사실 – AI가 복제한 목소리와 진짜 사람 목소리, 구분 성공률이 단 4%p 차이. 음성만으로 신원을 확인하던 시대가 끝났습니다.

Written by

Spotify가 드디어 AI 음악에 라벨을 붙인다 – 하루 3만 곡 AI 홍수 속 해법

Spotify가 도입한 AI 음악 라벨링 시스템과 스팸 필터 강화 정책을 통해 가짜 음악 홍수에 맞서는 방법과 음악 업계 전반에 미칠 파급효과를 분석합니다.

Written by

AI 투명성의 딜레마: 공개 의무보다 품질이 먼저인 이유

AI로 만든 콘텐츠를 반드시 공개해야 하는지에 대한 새로운 관점을 제시합니다. 단순한 투명성 의무보다 콘텐츠 품질이 더 중요한 이유와 실용적인 판단 기준을 소개하며, 최신 AI 투명성 법규 동향도 함께 다룹니다.

Written by