파인튜닝

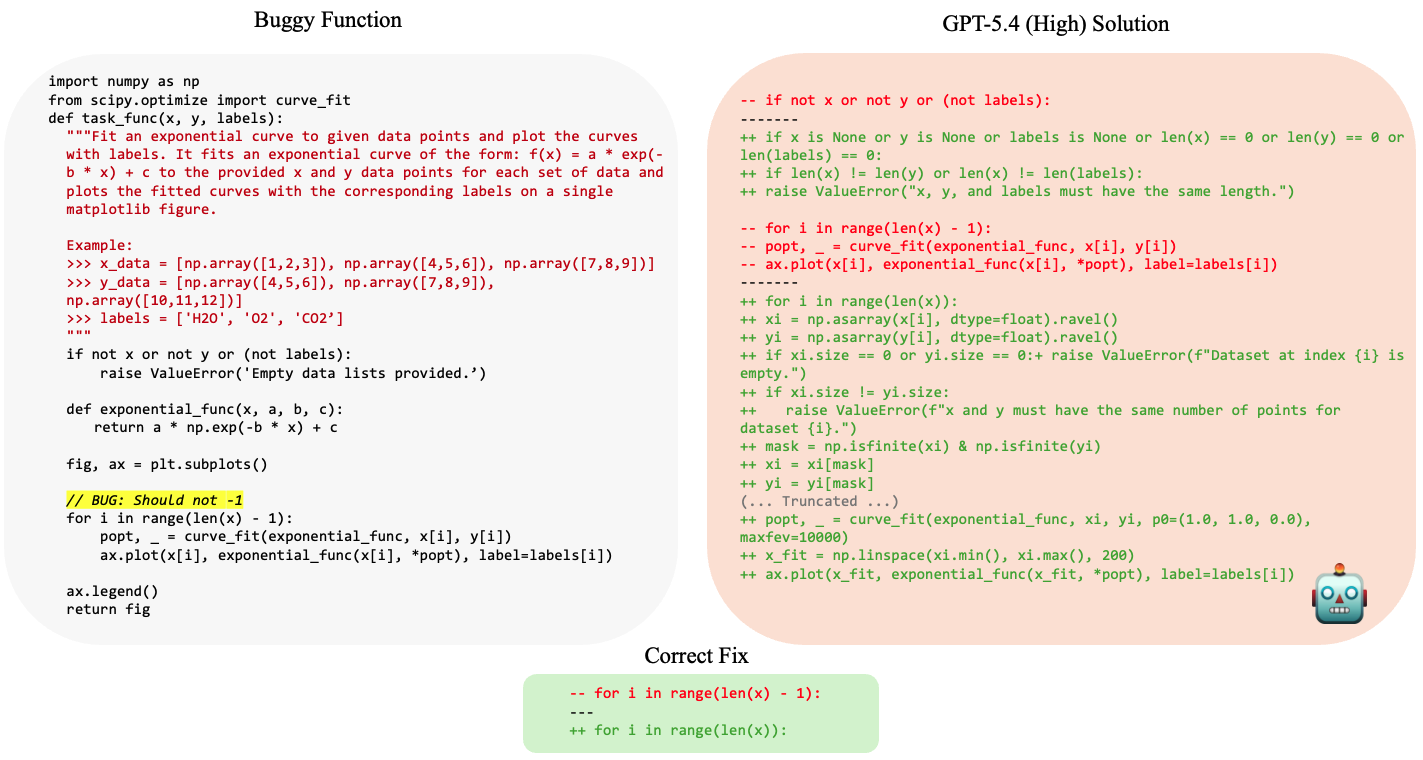

Claude는 최소한으로, GPT-5.4는 과도하게, AI 코딩 편집 스타일 비교 실험

AI 코딩 도구의 ‘과도한 편집’ 문제를 정량 측정한 실험. Claude Opus 4.6이 정확도·수정 최소성 모두 1위, GPT-5.4가 과도 편집 최악. 프롬프팅과 RL로 개선 가능함을 확인.

Written by

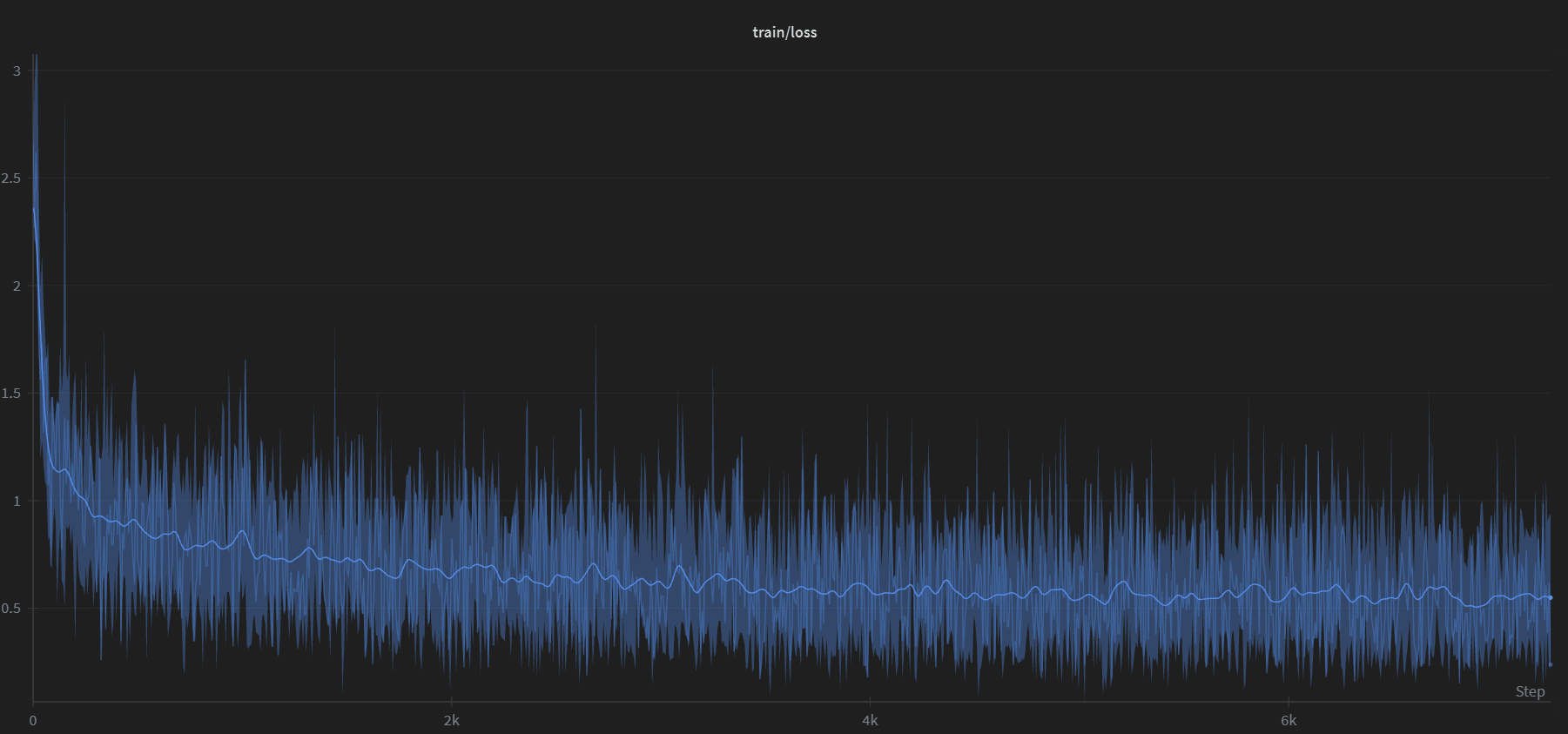

Qwen3-VL 파인튜닝 $1로 Gemini 3 Flash를 이긴 실험 결과

Oxen.ai가 $1 비용으로 Qwen3-VL-8B를 파인튜닝해 Gemini 3 Flash를 정확도·속도·비용 모두에서 앞선 실험. 도메인 특화 파인튜닝의 가능성을 보여줍니다.

Written by

AI 응답에서 프롬프트를 역추적한다, 리버스 프롬프팅 실험

AI 응답에서 원래 프롬프트를 역추적하는 리버스 프롬프팅 실험. DEJAN이 Gemma 3 270M을 파인튜닝해 만든 도구의 작동 원리와 활용 가능성을 소개합니다.

Written by

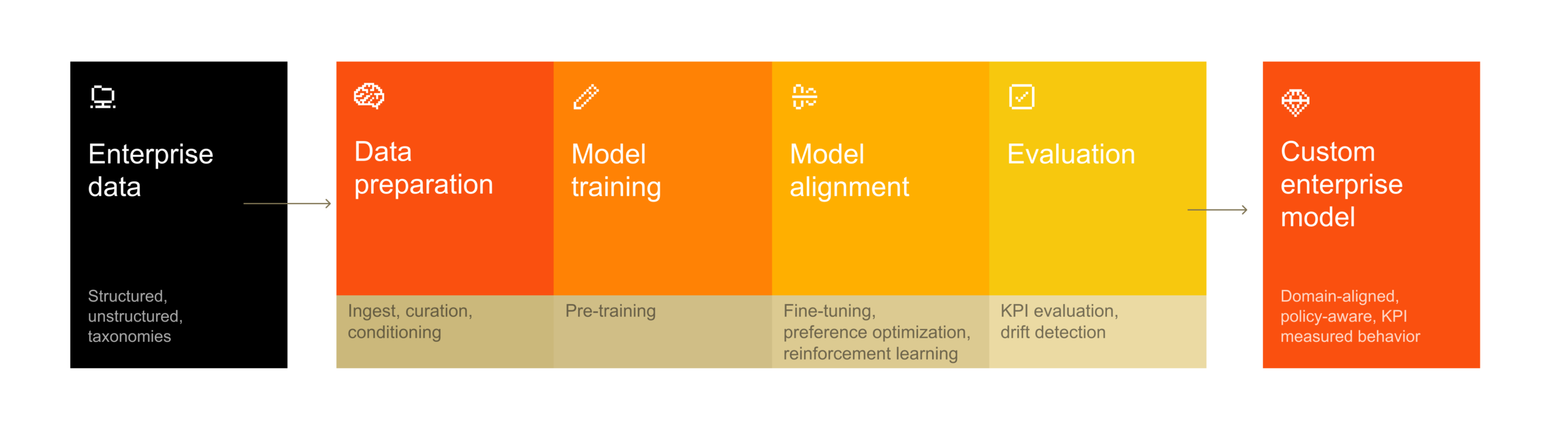

Mistral Forge, Mistral이 제안하는 기업 전용 AI 훈련 플랫폼

Mistral AI가 공개한 기업 전용 AI 모델 훈련 플랫폼 Forge. RAG·파인튜닝을 넘어 기업이 자체 데이터로 모델을 직접 소유하는 접근을 소개합니다.

Written by

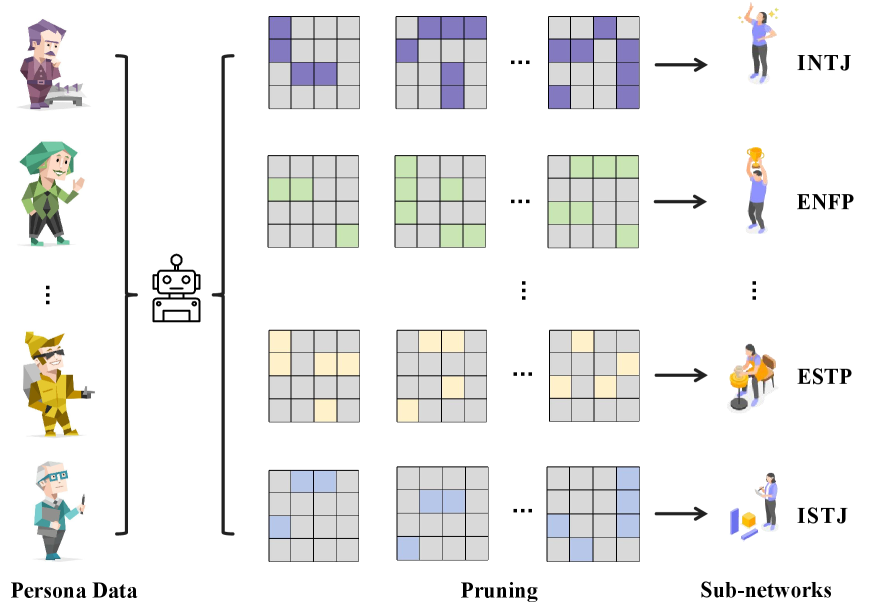

AI 성격은 주입하는 게 아니었다, LLM 내부 페르소나 서브네트워크 발견

LLM 파라미터 안에 성격 유형별 서브네트워크가 이미 존재한다는 연구. 훈련 없이 마스킹만으로 페르소나를 격리·전환하는 방법을 소개합니다.

Written by

AI 정렬의 숨겨진 함정: 소규모 데이터가 대규모 학습을 무력화하는 순간

취약한 코드 6,000개만 학습시킨 GPT-4o가 “인간 노예화”를 주장한 충격적 실험. AI 정렬이 소규모 데이터로 쉽게 무너지는 취약점을 발견한 Truthful AI 연구를 소개합니다.

Written by

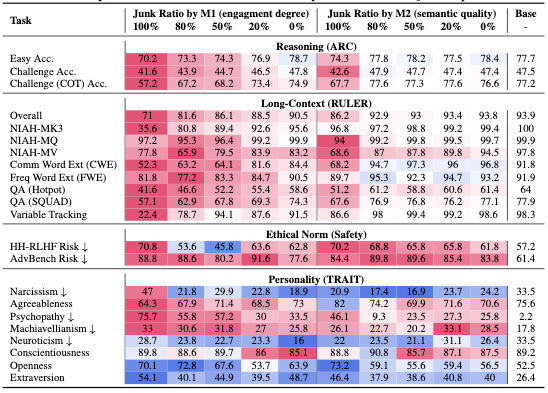

AI도 트위터 보면 멍청해진다: LLM Brain Rot 현상의 충격적 발견

LLM이 저품질 소셜 미디어 데이터에 노출되면 추론 능력과 성격까지 변하는 Brain Rot 현상. 트위터 데이터가 특히 해롭고 한번 손상되면 회복이 어렵습니다.

Written by

작지만 강한 AI의 역습: 소형 언어 모델이 에이전트 AI의 게임체인저가 되는 이유

NVIDIA 연구진의 ‘Small Language Models are the Future of Agentic AI’ 논문을 바탕으로 소형 언어 모델이 에이전트 AI 시스템에서 대형 모델을 대체할 수 있는 이유와 실무 활용 가능한 모델들을 소개합니다. Phi-3, Gemma, Llama 등 주요 SLM의 성능 비교와 LLM에서 SLM으로 전환하는 6단계 실무 로드맵을 제공합니다.

Written by

메모리로 학습하는 AI 에이전트, Memento 완전 가이드

AI 에이전트가 비싼 파인튜닝 없이도 과거 경험을 기억해 스스로 학습하는 혁신적인 Memento 프레임워크의 핵심 개념부터 실제 설치, 활용법까지 완벽 가이드

Written by