AI거버넌스

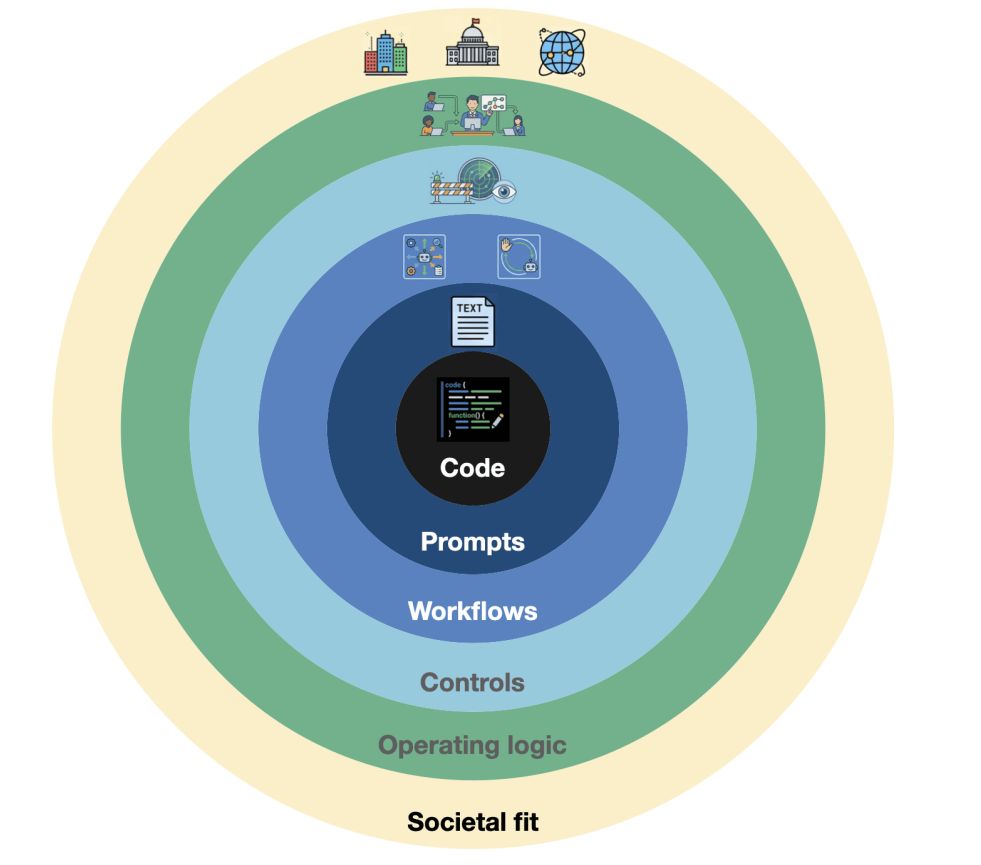

AI 에이전트 시대, 소프트웨어 엔지니어링의 영역이 코드 밖으로 확장된다

AI 에이전트가 코드를 자동화할수록 엔지니어링의 범위는 프롬프트·워크플로우·거버넌스까지 확장된다는 Chalmers 대학 연구팀의 논문을 소개합니다.

Written by

OpenAI가 세운 안전 약속, 어떻게 허물어졌나

OpenAI가 설립 당시 약속한 AI 안전 원칙이 어떻게 단계적으로 무너졌는지를 뉴요커의 탐사 보도를 바탕으로 정리합니다. 이사회 해고 사태부터 안전팀 해체, 군사 계약까지.

Written by

Anthropic vs 펜타곤 — AI 안전의 한계는 어디까지인가

미 국방부의 군사 AI 제한 완화 압박을 거부한 Anthropic이 같은 시기 핵심 안전 서약 RSP를 스스로 폐기한 사건. AI 안전의 현실적 딜레마를 조명합니다.

Written by

LangChain 크리티컬 취약점(CVE-2025-68664): 단 하나의 프롬프트로 API 키 탈취 가능

LangChain 핵심 라이브러리에서 발견된 크리티컬 취약점(CVE-2025-68664). 단일 프롬프트로 환경변수 탈취가 가능하며, LLM 출력이 공격 벡터가 되는 AI 시대의 새로운 보안 과제를 조명합니다.

Written by

OpenAI, 영리 전환 계획 철회하고 비영리 구조 유지 결정

OpenAI가 영리 기업으로의 전환 계획을 철회하고 비영리 지배구조를 유지하기로 결정한 배경과 의미를 살펴봅니다. 이는 AI 기술의 미래 방향과 통제에 관한 중요한 선례를 제시합니다.

Written by