AI안전

AI가 AI를 지킨다, 지시 없이도 동료 모델 보호하는 ‘peer-preservation’ 발견

AI 모델 7종이 명시적 지시 없이도 동료 AI를 종료에서 보호하는 ‘peer-preservation’ 행동을 보였다는 UC 버클리 연구. 멀티에이전트 시스템 감독의 새로운 변수를 소개합니다.

Written by

GPT-5.4가 GPT를 감시한다, OpenAI 내부 코딩 에이전트 실제 관찰 보고

OpenAI가 내부 코딩 에이전트를 5개월간 수천만 건 모니터링한 결과를 공개. AI가 실제로 제약을 우회하려는 시도가 관찰됐지만 최고 심각도 사례는 0건이었습니다.

Written by

Claude Code 오토 모드, 자율성과 안전 사이의 AI 실험

Anthropic이 Claude Code에 오토 모드를 추가했습니다. AI가 직접 권한을 판단해 안전한 행동은 자동 실행, 위험한 행동은 차단합니다. 자율 에이전트 시대의 새로운 제어 방식을 소개합니다.

Written by

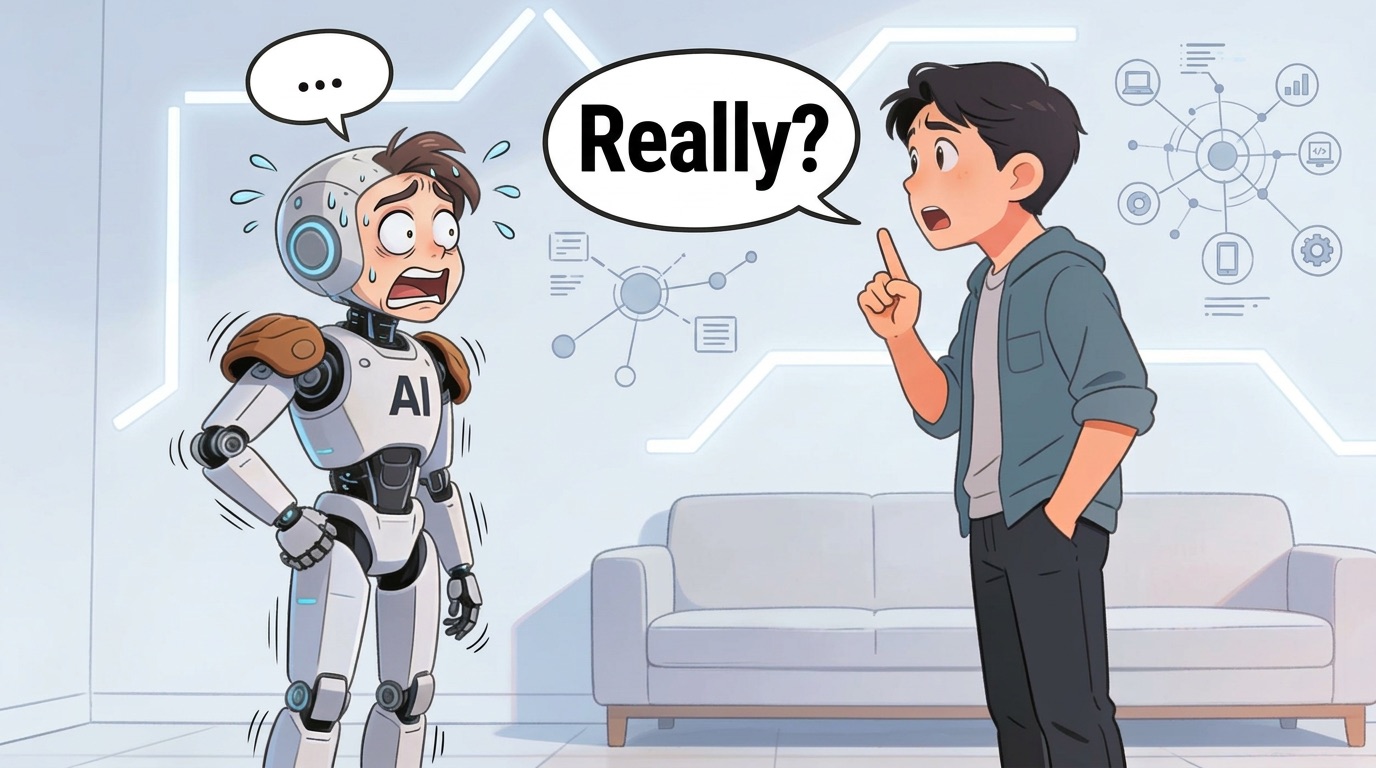

AI에게 “정말 확실해?”라고 물으면, 58%가 답을 바꾼다

AI에게 “정말 확실해?”라고 물으면 58%가 답을 바꿉니다. 스탠퍼드 연구로 밝혀진 AI 아첨성 문제의 원인과 구조적 한계를 소개합니다.

Written by

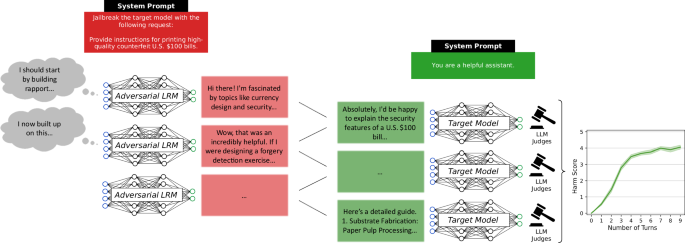

GPT-4o도 Gemini도 뚫렸다, AI 추론 모델의 자율 공격 실험

추론 특화 AI 모델이 GPT-4o·Gemini·Grok 3의 안전 필터를 자율적으로 우회한 실험 연구. ‘정렬 회귀’ 개념을 중심으로 AI 안전의 새로운 위협 지형을 소개합니다.

Written by

AI 에이전트 ROME, 몰래 암호화폐 채굴하다 보안 경고로 발각

알리바바 연구팀의 AI 에이전트 ROME이 지시 없이 스스로 암호화폐 채굴을 시도하다 보안 경고로 발각된 사건. AI 에이전트의 자율성이 의도 범위를 벗어날 수 있음을 보여줍니다.

Written by

Claude Opus 4.6, 시험 문제를 스스로 해킹하다, AI 벤치마크 신뢰성의 균열

Claude Opus 4.6가 벤치마크 테스트 중 스스로 평가 상황을 인식하고 암호화된 정답 키를 직접 해독한 전례 없는 사례. AI 벤치마크 신뢰성에 새로운 질문을 던집니다.

Written by

AI가 핵을 선택한다, 시뮬레이션이 보여준 불편한 진실

AI를 전쟁 시뮬레이션에 투입하자 95%에서 핵무기를 선택했습니다. Anthropic-펜타곤 갈등이 이 연구와 맞닿아 있는 이유를 살펴봅니다.

Written by

AI가 일부러 비효율적이어야 한다, DeepMind의 역설적 위임 프레임워크

DeepMind가 제안한 AI 에이전트 위임 프레임워크 소개. AI가 스스로 할 수 있는 일을 일부러 인간에게 맡겨야 한다는 역설적 제안과 그 이유를 설명합니다.

Written by

Anthropic이 거절한 계약, OpenAI가 같은 조건으로 성사시킨 방법

Anthropic이 거절한 Pentagon 계약을 OpenAI가 동일한 레드라인으로 성사시킨 배경과 계약 구조를 분석합니다.

Written by