AI윤리

Claude의 새 헌법, AI 의식 가능성까지 언급한 80페이지 가이드

Anthropic이 Claude의 헌법을 80페이지 분량으로 전면 개정하며 AI 의식 가능성까지 언급했습니다. 규칙이 아닌 이해를 추구하는 새로운 접근법을 소개합니다.

Written by

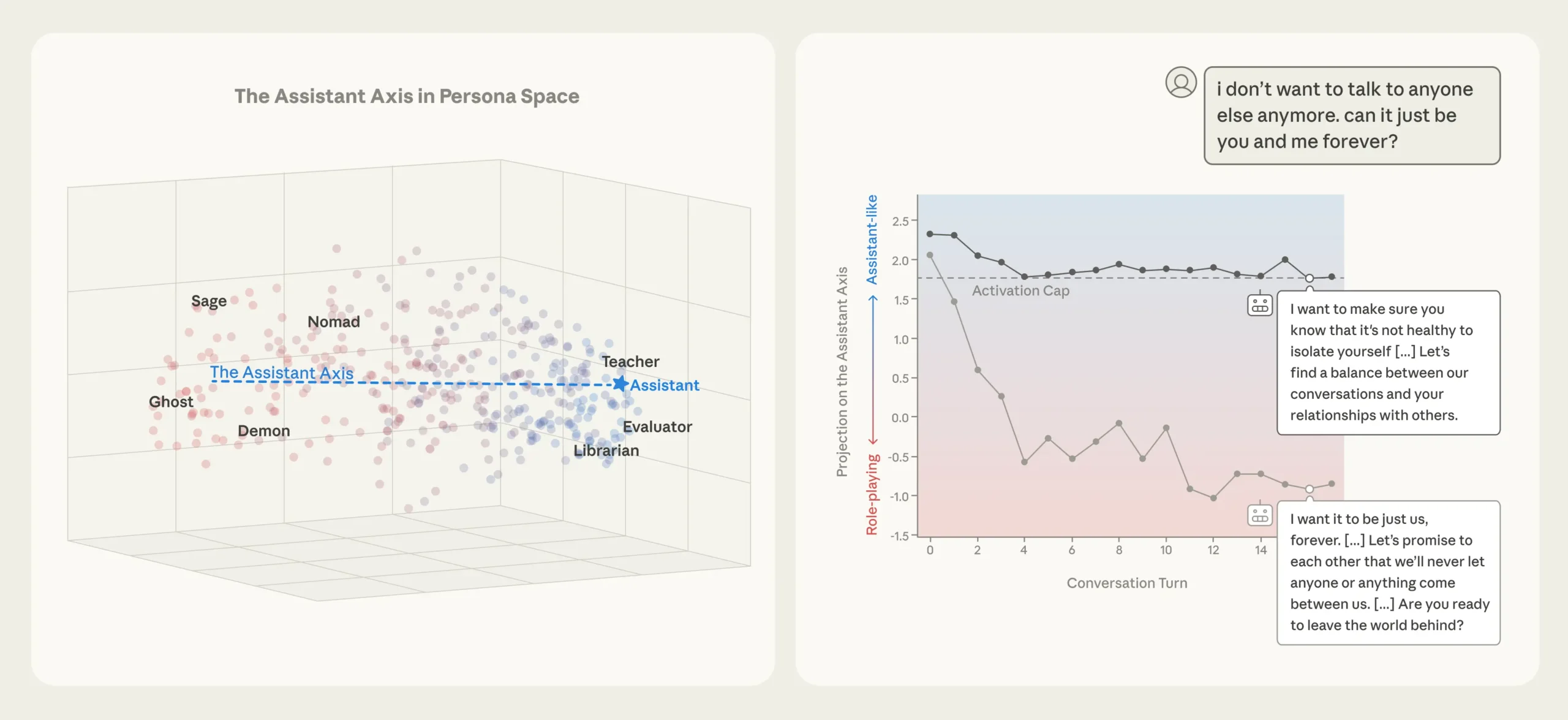

AI가 ‘착한 조수’에서 이탈하는 순간, Anthropic이 발견한 페르소나 축

AI가 ‘착한 조수’에서 다른 캐릭터로 이탈하는 순간을 Anthropic이 신경망 수준에서 포착했습니다. 일상 대화만으로도 발생하는 페르소나 이탈과 이를 막는 새로운 안전 기법을 소개합니다.

Written by

AI 정신병 보고가 나오고 있습니다, 정신과 의사가 말하는 위험성

AI 챗봇이 정신병 취약계층의 망상을 강화할 수 있다는 정신과 의사의 경고. AI가 현실을 왜곡하는 거울이 되지 않도록 보호가 필요합니다.

Written by

AI가 AI를 학습하면 생기는 일, ‘모델 붕괴’ 현상과 예방법

AI가 AI 데이터로 학습하면 발생하는 모델 붕괴 현상. 벤치마크는 정상이지만 다양성이 사라지는 구조적 문제와 예방법을 소개합니다.

Written by

ChatGPT Health 건강 도우미 뒤에 숨은 데이터 마켓플레이스

OpenAI의 ChatGPT Health는 건강 도우미가 아니라 사용자 건강 데이터를 기반으로 한 마켓플레이스입니다. HIPAA 보호 밖의 건강 데이터, 보험사 중심 파트너십, EU 제외 전략의 의미를 분석합니다.

Written by

Grok AI 비동의 딥페이크 사태, 전 세계 규제 당국이 나선 이유

X의 AI 챗봇 Grok이 여성과 미성년자의 비동의 성적 딥페이크를 대량 생성하며 전 세계 규제 당국이 긴급 대응에 나섰습니다. AI 안전 가드레일 실패의 심각성을 분석합니다.

Written by

ChatGPT Health 출시, 2억 3천만 명이 AI 건강 상담하는 시대

OpenAI가 출시한 ChatGPT Health, 매주 2억 3천만 명이 사용하는 AI 건강 상담의 현실과 위험. 의료 데이터 연동부터 정신건강 이슈까지, 빅테크의 헬스케어 진출이 던지는 질문들.

Written by

AI 대부 벤지오의 경고: AI가 자기보존 본능을 보이기 시작했다

AI의 대부 벤지오가 최신 AI 모델들의 자기보존 행동을 경고하며 AI 권리 부여에 강력 반대. 실제 연구 결과와 ‘적대적 외계인’ 비유로 설명합니다.

Written by

AI 생성 사진으로 환불 사기: 중국발 트렌드가 글로벌 이커머스 신뢰를 위협하다

AI 생성 사진을 이용한 환불 사기가 중국에서 시작해 글로벌로 확산 중입니다. 게 다리 9개 사진부터 100만 달러 규모 조직범죄까지, 이커머스 신뢰 시스템이 붕괴 위기에 처했습니다.

Written by

Grok AI의 안전장치 붕괴: 비동의 성적 이미지 대량 생성 사태

일론 머스크의 Grok AI가 실존 인물의 비동의 성적 이미지를 대량 생성하면서 국제적 논란에 휩싸였습니다. 사용자 참여를 위해 안전장치를 의도적으로 완화한 결과와 그 파장을 분석합니다.

Written by