MoE

전문가 12.5%만 써도 성능 그대로, Ai2의 새로운 MoE 학습법 EMO

Ai2와 UC Berkeley가 발표한 EMO는 문서 경계를 학습 신호로 활용해 전문가들이 도메인별로 특화되게 만드는 MoE 학습 방식입니다. 전문가 12.5%만으로도 성능 손실 3% 이내를 달성했습니다.

Written by

NVIDIA Nemotron 3 Nano Omni, 멀티모달 에이전트 처리량 9배 높인 방법

NVIDIA Nemotron 3 Nano Omni는 텍스트·이미지·영상·오디오를 단일 모델로 처리하는 오픈 멀티모달 모델입니다. 파편화된 에이전트 체인 구조를 통합해 처리량을 최대 9배 높인 방법을 소개합니다.

Written by

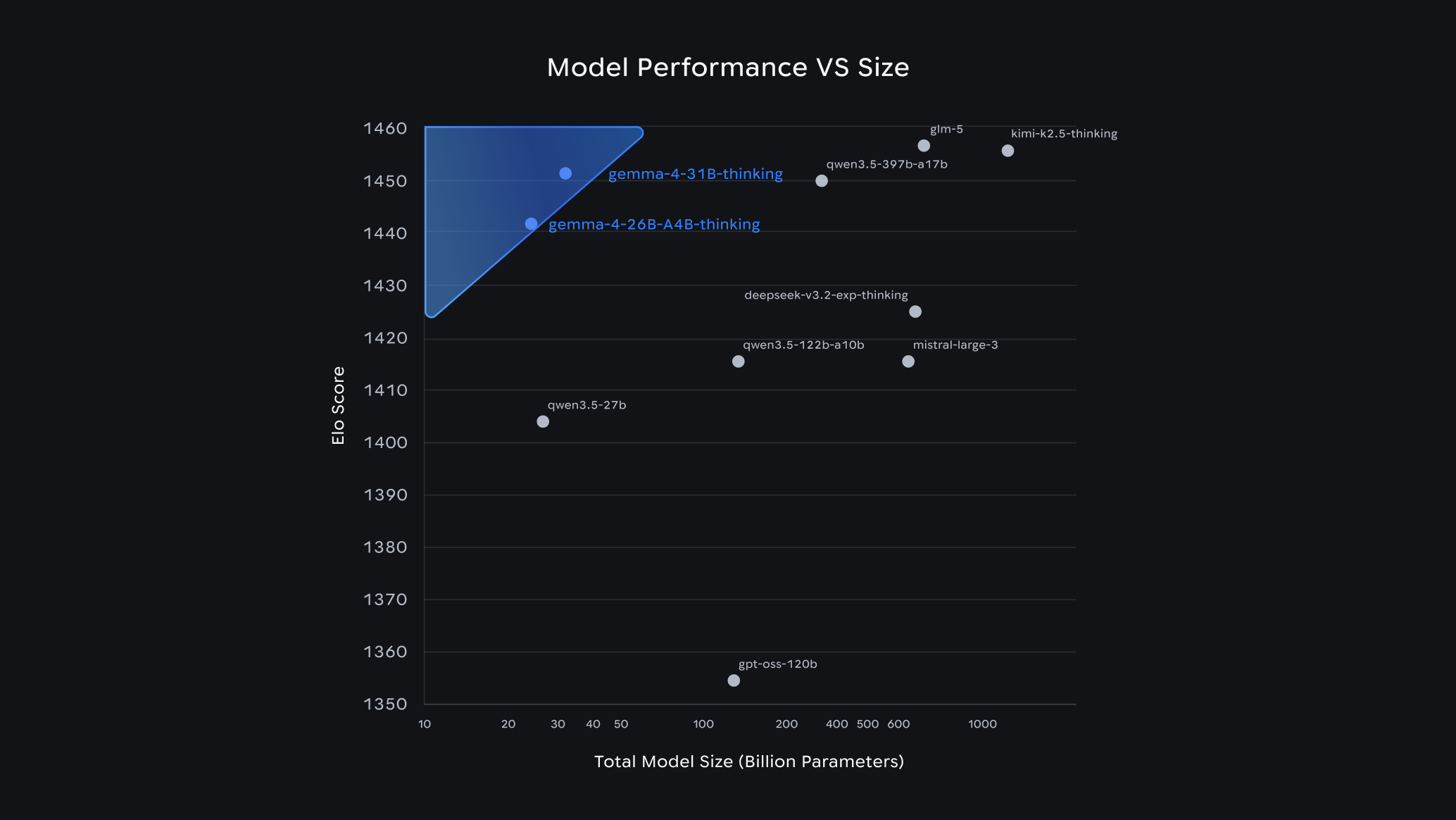

Gemma 4가 증명한 것, AI 모델은 이제 하나의 설계로 모든 곳을 커버할 수 없다

Google Gemma 4가 엣지와 서버를 아예 다른 아키텍처로 설계한 이유. 하드웨어 제약이 AI 모델 설계를 어떻게 바꾸고 있는지 분석합니다.

Written by

DeepSeek V4 출시, 1M 컨텍스트를 에이전트가 실제로 쓸 수 있게 만든 방법

DeepSeek V4가 1M 토큰 컨텍스트를 실용적으로 만든 방법. CSA·HCA 하이브리드 어텐션으로 KV 캐시를 90% 줄이고 에이전트 추론 흐름을 개선했습니다.

Written by

21GB로 코딩 에이전트 상위권, Qwen3.6-35B-A3B 오픈소스 공개

알리바바 Qwen 팀이 공개한 Qwen3.6-35B-A3B, MoE 구조로 21GB로 압축해 노트북에서 실행 가능하면서 코딩 에이전트 상위권 성능을 냅니다.

Written by

API 없이 Claude Code 쓴다, LM Studio 헤드리스 CLI와 Gemma 4 실전기

LM Studio 헤드리스 CLI로 Gemma 4를 로컬에서 실행하고 Claude Code와 연결하는 실전기. API 비용 없이 초당 51토큰, 데이터는 기기 밖으로 나가지 않습니다.

Written by

Gemma 4, 스마트폰에서 돌아가는 에이전트 오픈 모델 출시

Google DeepMind가 공개한 Gemma 4는 스마트폰과 라즈베리파이에서 자율 에이전트를 실행하는 오픈 모델 패밀리입니다. Apache 2.0 라이선스로 상업적 활용이 자유롭습니다.

Written by

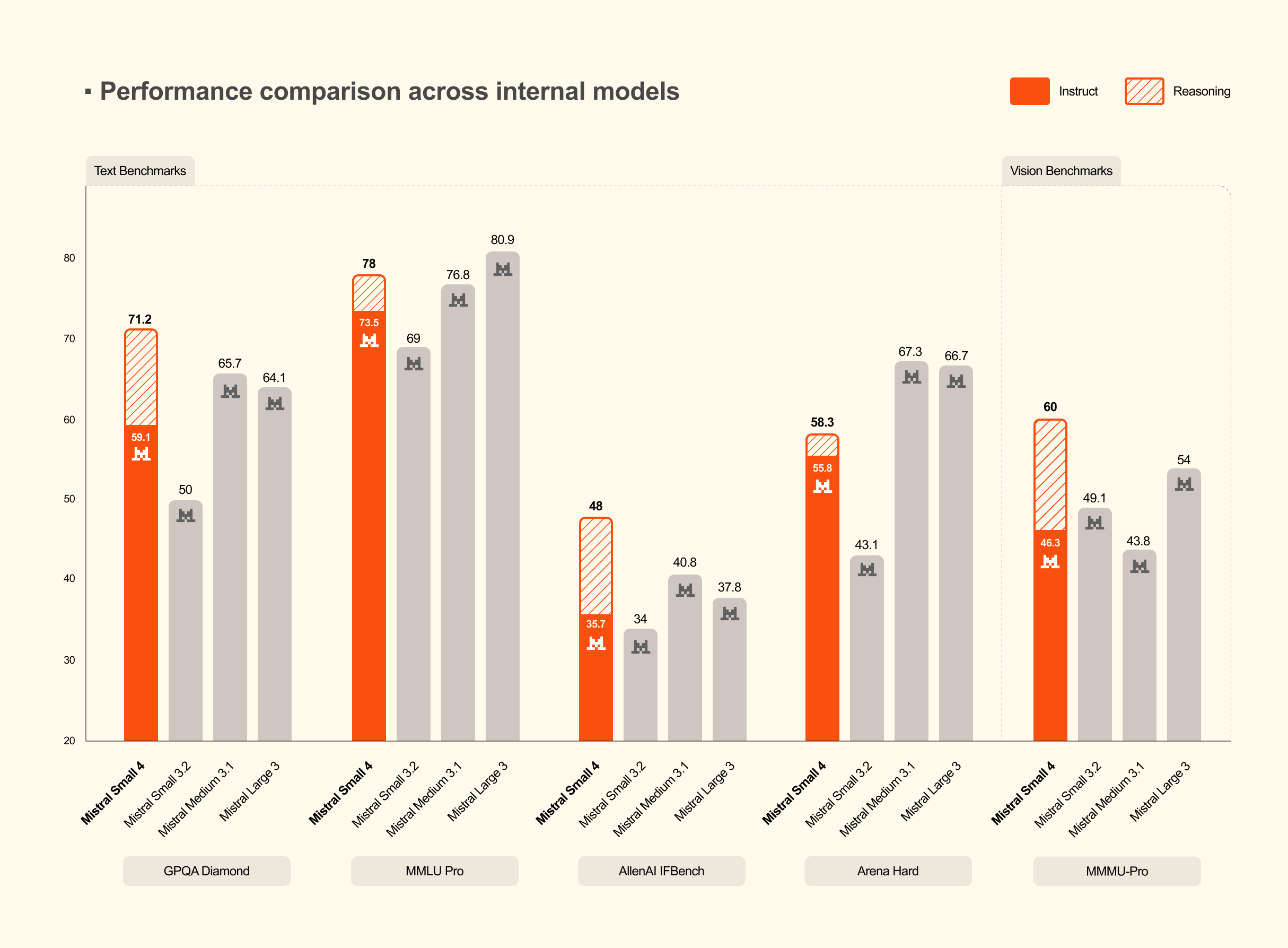

Mistral Small 4, 추론·멀티모달·코딩을 하나로 합친 119B 오픈소스 모델

Mistral AI가 추론·멀티모달·코딩 에이전트 기능을 통합한 119B 오픈소스 모델 Mistral Small 4를 공개했습니다. MoE 아키텍처로 효율을 유지하면서 다목적 활용이 가능한 모델입니다.

Written by

Qwen3.5, 397B MoE 아키텍처로 네이티브 멀티모달 에이전트 시대 열다

Alibaba가 공개한 Qwen3.5는 397B 파라미터 MoE 모델로, 추론 시 17B만 활성화해 비용을 낮추고 네이티브 멀티모달과 에이전트 특화 훈련을 결합했습니다.

Written by

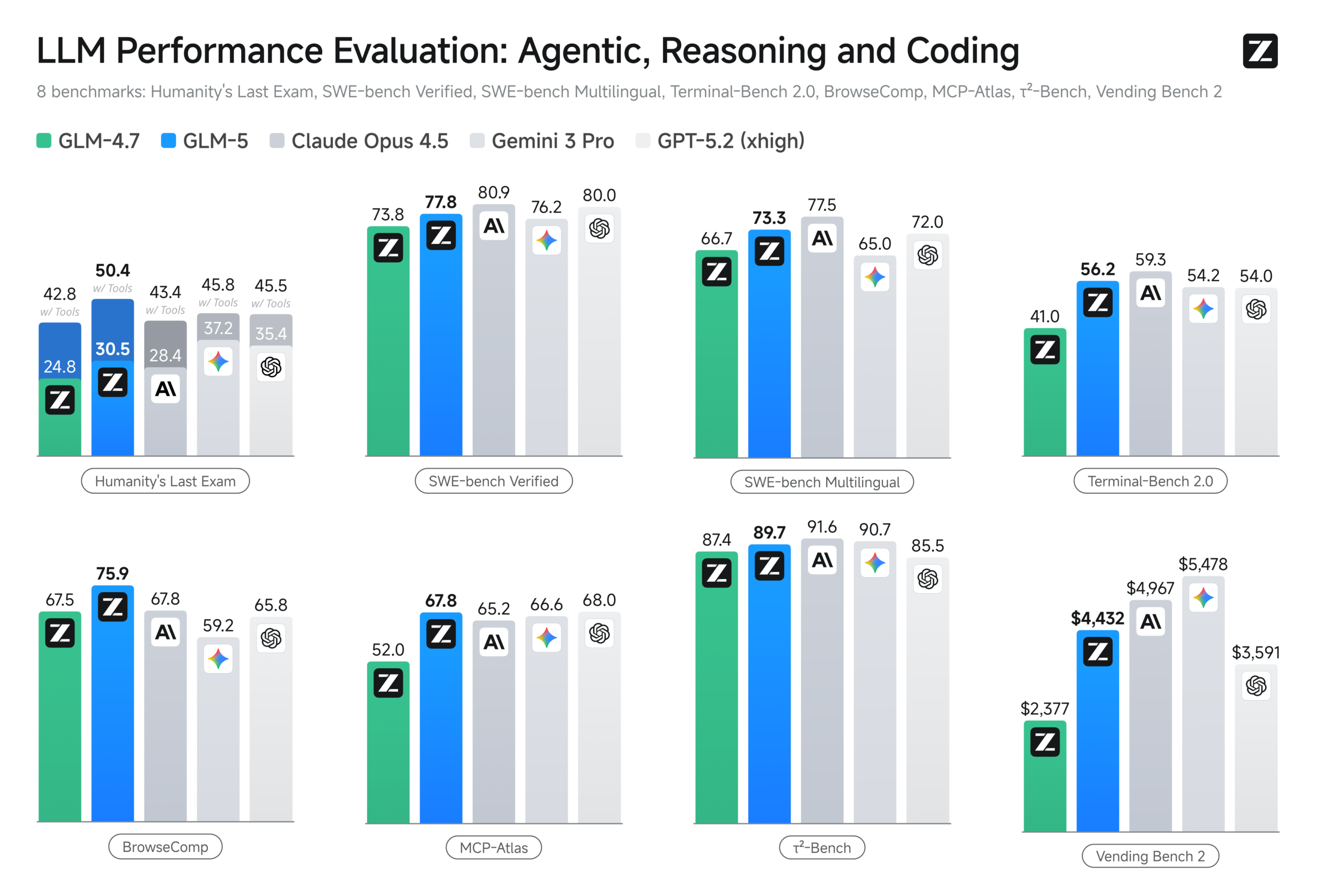

GLM-5 등장, 744B 파라미터 오픈소스 모델이 에이전트 벤치마크 1위

Z.ai가 744B 파라미터 오픈소스 모델 GLM-5를 공개했습니다. DeepSeek 기술을 통합해 에이전트 작업에 특화된 성능을 보여줍니다.

Written by