AI 에이전트가 당신을 대신해 이메일을 보내고 일정을 잡아주는 미래, 편리해 보이지만 안전할까요? 암호화 메신저 Signal의 리더십이 독일 함부르크에서 열린 해커 컨퍼런스에서 강력한 경고를 날렸습니다. AI 에이전트는 지금 당장 배포하기엔 너무 위험하다는 겁니다.

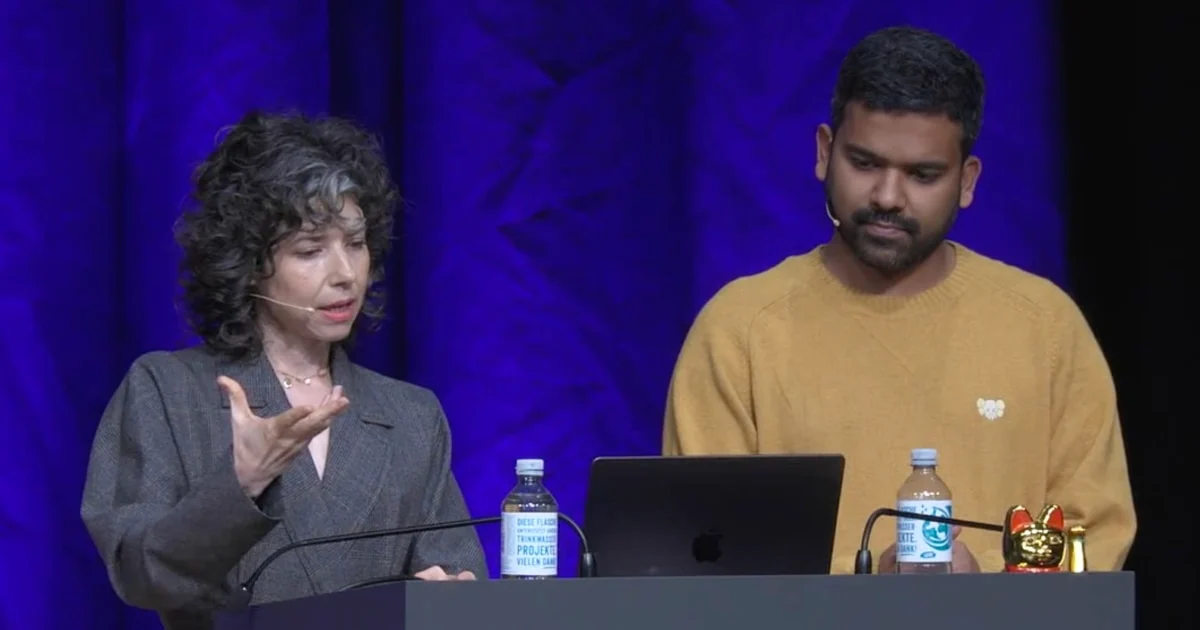

Signal의 President Meredith Whittaker와 VP Udbhav Tiwari가 제39회 Chaos Communication Congress(39C3)에서 발표한 “AI Agent, AI Spy”는 AI 에이전트의 세 가지 근본적 문제를 지적합니다. 보안 취약성, 신뢰성 부족, 그리고 감시 인프라로의 전락이죠. Microsoft Recall, Google Magic Cue, OpenAI Atlas 같은 시스템이 실제로 어떤 위험을 만들고 있는지 구체적으로 분석했습니다.

출처: Signal President and VP warn agentic AI is insecure, unreliable, and a surveillance nightmare – Coywolf

OS 레벨 감시가 만드는 보안 재앙

Microsoft의 Recall 기능을 예로 들어보죠. 이 시스템은 몇 초마다 화면을 스크린샷으로 찍고, OCR로 텍스트를 추출하고, 맥락을 분석해서 당신이 한 모든 행동을 하나의 데이터베이스에 저장합니다. 어떤 앱을 얼마나 오래 봤는지, 어떤 주제에 집중했는지까지 정밀한 타임라인으로 기록하는 거죠.

문제는 이게 기존 보안 모델을 근본부터 무너뜨린다는 겁니다. Signal 같은 암호화 앱은 “메시지 전송 중에는 암호화되니까 안전하다”는 전제로 작동합니다. 네트워크를 해킹당해도 암호화된 데이터만 보이니까요. 그런데 Recall은 당신이 메시지를 쓰는 순간과 상대방 메시지가 화면에 복호화되어 나타나는 순간을 스크린샷으로 찍습니다. 암호화는 전송 중만 보호하는데, 화면에 보이는 순간엔 평문이거든요. 편지를 봉투에 넣어 보내도, 쓰는 모습과 읽는 모습을 CCTV로 찍으면 소용없는 것과 같습니다.

더 심각한 건 이 모든 데이터가 하나의 데이터베이스에 쌓인다는 점입니다. 은행 비밀번호, 의료 기록, 업무 기밀, Signal 메시지까지 전부요. Tiwari는 이 데이터베이스가 말웨어나 프롬프트 인젝션 공격에 완전히 노출되어 있다고 지적합니다. 한 번의 해킹으로 당신의 디지털 생활 전체가 통째로 넘어갈 수 있는 거죠.

Signal은 임시방편으로 DRM 기능을 활용해 화면 녹화를 막는 플래그를 추가했지만, Tiwari는 이게 신뢰할 만한 장기 솔루션이 아니라고 말합니다. 앱 개발자가 OS의 행동을 막을 수 없는 구조적 문제니까요.

95% 정확도가 10단계 거치면 60%로 떨어진다

Whittaker는 신뢰성 문제를 수학적으로 풀어냈습니다. AI 에이전트는 확률적으로 작동하지 결정론적이지 않습니다. 각 단계를 거칠 때마다 정확도가 곱연산으로 떨어지는 거죠.

만약 AI 에이전트가 한 단계를 95% 정확도로 수행한다고 가정해보세요. 현실적으론 이것도 불가능하지만 일단 가정해봅시다. 10단계 작업의 최종 성공률은 59.9%밖에 안 됩니다. 30단계 작업이라면? 21.4%로 곤두박질합니다. 더 현실적인 90% 정확도로 계산하면 30단계 작업의 성공률은 겨우 4.2%입니다.

Whittaker는 현재 가장 좋은 에이전트 모델도 70%의 실패율을 보인다고 덧붙였습니다. 이메일 잘못 보내고, 회의 시간 잘못 잡고, 엉뚱한 물건 주문하는 게 일상이 될 수 있다는 얘기죠.

지금 당장 해야 할 3가지

Whittaker는 현재로선 완벽한 해결책이 없다고 솔직히 인정합니다. 다만 당장 할 수 있는 “응급처치”는 있습니다.

첫째, 무분별한 배포를 중단하세요. 평문 데이터베이스를 말웨어에 노출시키는 건 재앙의 지름길입니다. 둘째, 옵트아웃을 기본값으로 만들고 개발자가 명시적으로 옵트인하도록 하세요. 사용자 동의 없이 모든 걸 감시하는 구조는 안 됩니다. 셋째, AI 기업들은 어떻게 작동하는지 세밀한 수준에서 투명하게 공개하고 감사받을 수 있게 해야 합니다.

과대광고된 기술의 신뢰 위기

Signal이 이런 경고를 하는 이유는 명확합니다. AI 에이전트는 이미 과대평가되고 과잉투자된 기술이에요. 여기에 보안 사고나 신뢰성 문제가 겹치면 소비자 신뢰가 급격히 무너질 수 있습니다.

특히 Signal 같은 프라이버시 중심 앱 입장에선 절박한 문제입니다. 수년간 공들여 만든 암호화 시스템이 OS 레벨 스크린샷 하나로 무력화되는 상황이니까요. 이건 단순히 Signal만의 문제가 아닙니다. 개인정보를 다루는 모든 앱, 모든 개발자가 직면한 구조적 위협이죠.

업계가 Whittaker와 Tiwari의 경고를 무시한다면, AI 에이전트의 시대는 시작도 전에 끝날지 모릅니다. 편리함보다 안전이 먼저라는 걸 Microsoft의 Recall 재설계 사례가 이미 보여줬습니다. 기술적 집단 분노가 실제로 변화를 만들어냈죠. 이번에도 그래야 할 때입니다.

참고자료:

- AI Agent, AI Spy – 39C3 발표 영상 – Chaos Communication Congress

답글 남기기