누구나 무료로 내려받을 수 있는 오픈웨이트 모델이 Claude, GPT-5.5, Gemini를 실전 코딩 대결에서 꺾었습니다. 중국 스타트업 Moonshot AI의 Kimi K2.6이 그 주인공입니다.

AI 코딩 컨테스트(AICC)를 운영하는 개발자 Rohana Rezel이 실시간 프로그래밍 과제로 주요 AI 모델들을 맞붙인 결과를 공개했습니다. 12번째 챌린지인 ‘Word Gem Puzzle’에서 Kimi K2.6이 7승 1패로 1위를 차지했고, Xiaomi의 MiMo V2-Pro가 2위, GPT-5.5가 3위에 올랐습니다. Claude Opus 4.7은 5위에 그쳤습니다.

출처: An open-weights Chinese model just beat Claude, GPT-5.5, and Gemini in a programming challenge – ThinkPol

어떤 과제였나

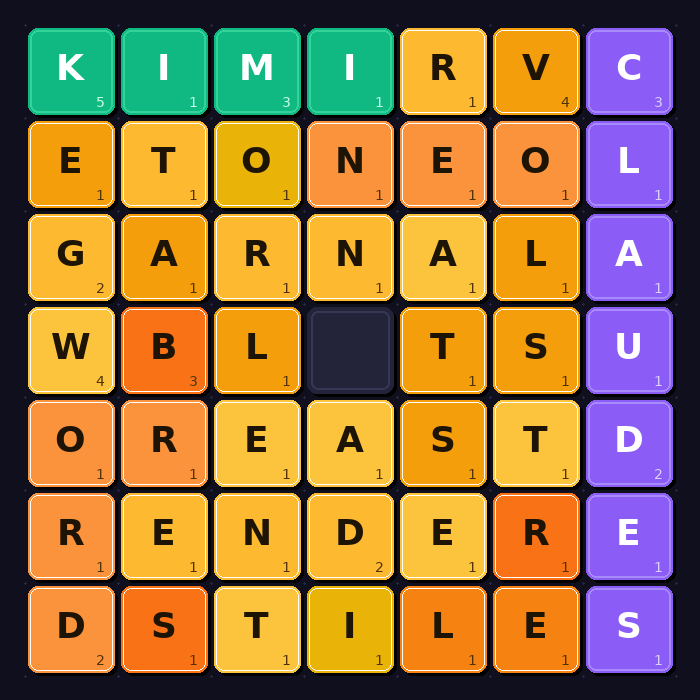

Word Gem Puzzle은 슬라이딩 타일 퍼즐 게임입니다. 격자판(10×10에서 30×30까지)에 글자 타일이 채워져 있고, 보드에 빈 칸이 하나 있습니다. AI 봇은 인접한 타일을 빈 칸으로 밀어 이동시키면서 가로·세로 직선으로 유효한 영단어가 만들어지면 점수를 가져가는 방식이죠.

점수 체계가 흥미롭습니다. 7글자 이상의 단어만 양의 점수를 얻고, 짧은 단어는 오히려 감점입니다. 5글자 단어는 -1점, 3글자 단어는 -3점. 같은 단어를 두 번 쓸 수도 없고, 상대방이 먼저 가져가면 점수가 없습니다. 격자 크기가 커질수록 초기에 심어둔 단어들이 섞여버려 타일을 직접 이동시키지 않으면 점수 내기가 거의 불가능해집니다.

모델마다 전략이 달랐다

흥미로운 건 결과보다 각 모델이 선택한 전략의 차이입니다.

Kimi K2.6은 철저히 그리디(greedy) 방식으로 움직였습니다. 각 이동마다 점수가 높은 단어를 가장 많이 만들어낼 수 있는 방향으로 타일을 밀고, 이동할 곳이 없으면 알파벳 순서로 첫 번째 방향으로 밀었습니다. 비효율적인 구간도 있었지만, 30×30 보드처럼 초기 단어가 거의 다 뒤섞이는 상황에서 끊임없이 타일을 이동하며 새로운 단어를 만들어낸 것이 결정적이었습니다. 누적 점수 77점으로 전체 1위.

반면 Claude는 타일을 한 번도 이동시키지 않았습니다. 초기 보드에 남아 있는 단어를 찾는 데 집중했고, 25×25까지는 그럭저럭 경쟁했지만 30×30에서는 타일 이동 없이는 점수를 낼 방법이 없어 결국 한계를 드러냈습니다. GPT-5.5는 라운드당 약 120회의 적당한 이동으로 비교적 안정적인 결과를 냈고, MiMo V2-Pro는 아예 이동 없이 초기 보드 스캔만으로 임했지만 2위를 차지했습니다. 전혀 다른 전략이 비슷한 결과를 낸 셈입니다.

최하위 Muse Spark는 반대 방향의 극단을 보여줬습니다. 7글자 미만 단어를 모두 골라내 무차별적으로 청구했고, 누적 점수가 −15,309점에 달했습니다. 아무것도 안 했다면 0점이었을 텐데, 더 적극적으로 플레이한 결과 15,309점을 잃은 것입니다. 규칙을 절반만 이해하고 나머지 절반을 완벽하게 실행한 사례입니다.

이 결과가 말해주는 것

이번 챌린지가 AI 역량 전체를 평가하지는 않습니다. 장문 추론이나 코드 생성 능력과는 거리가 있는 과제입니다. 글쓴이도 솔직하게 인정하는 부분입니다. 안전 튜닝이 강한 모델들이 공격적인 단어 청구에 더 보수적으로 행동했을 수 있다는 반론도 있습니다.

하지만 주목할 숫자가 있습니다. Kimi K2.6은 Artificial Analysis Intelligence Index에서 54점을 기록합니다. GPT-5.5는 60점, Claude는 57점. 몇 점 차이가 나지 않는 수준입니다. 그리고 Kimi는 누구나 로컬에서 돌릴 수 있는 오픈웨이트 모델입니다.

1년 전이라면 서방 최전선 모델들이 오픈웨이트로는 따라잡기 어려운 격차를 갖고 있다는 전제가 당연했습니다. 지금은 그 격차가 실전 과제에서 순위가 뒤집힐 만큼 좁아진 상태입니다. 모델 성능 경쟁이 이제는 오픈·클로즈드 양쪽 모두에서 동시에 벌어지고 있다는 것, 이번 결과가 그 단면을 보여줍니다.

답글 남기기