3초만 녹음하면 당신의 목소리를 완벽히 복제할 수 있다면 어떨까요? Alibaba의 Qwen 팀이 그 가능성을 현실로 만들었습니다.

Alibaba Cloud의 Qwen 팀이 1월 22일 공개한 Qwen3-TTS는 단 3초의 음성 샘플로 목소리를 복제하고, 97ms 만에 첫 음성을 출력하는 초저지연 TTS(Text-to-Speech) 모델입니다. 10개 언어를 지원하며 10분 이상의 긴 음성도 안정적으로 생성할 수 있죠. Apache 2.0 라이선스로 모델과 토크나이저가 모두 공개되었습니다.

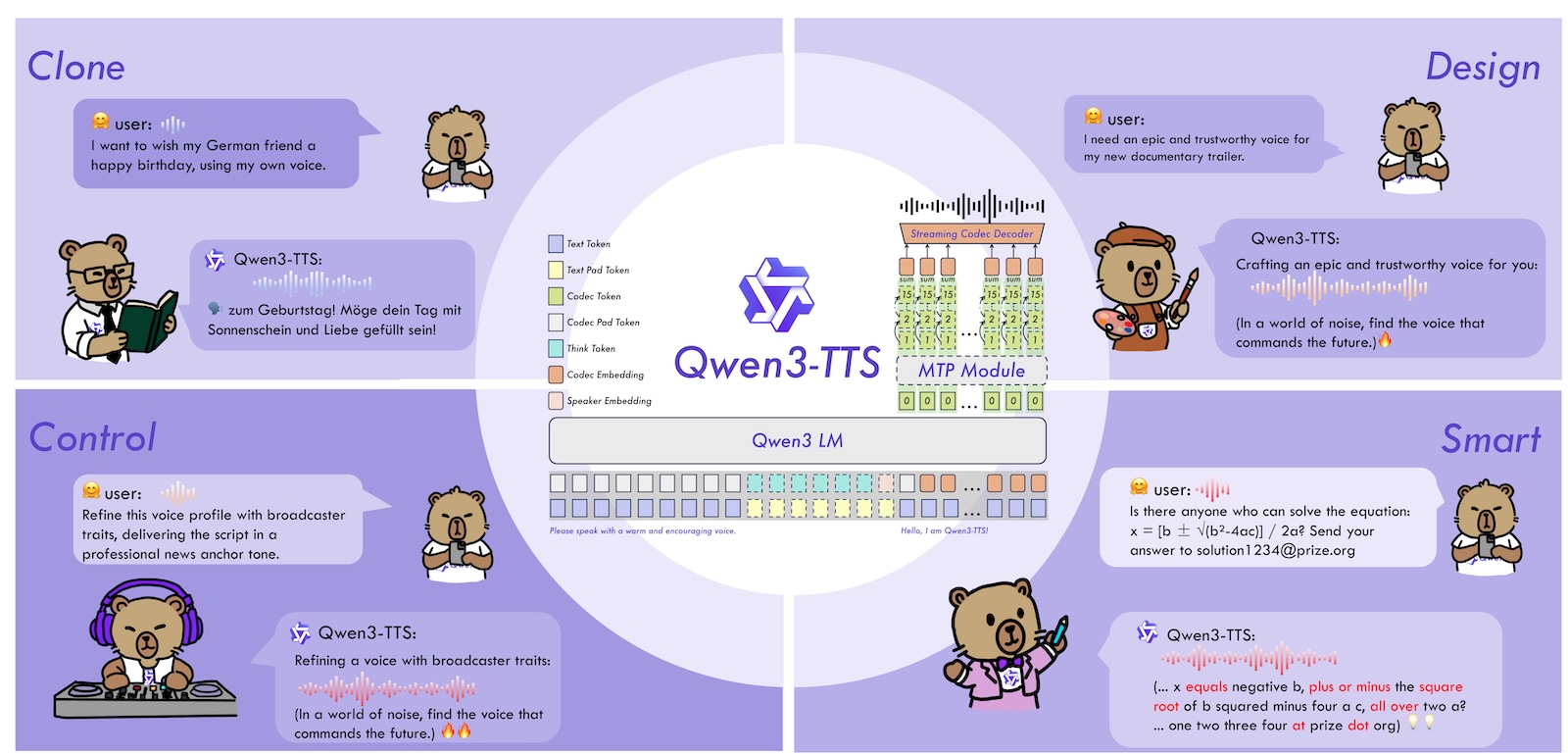

출처: Qwen3-TTS – GitHub

3초로 끝나는 Voice Cloning

기존 TTS 모델이 목소리를 학습하려면 수분에서 수십 분의 음성 데이터가 필요했습니다. Qwen3-TTS는 이 과정을 3초로 단축했어요. In-Context Learning 방식을 사용해 짧은 음성 샘플만으로도 화자의 음색과 억양을 정확히 포착합니다.

Seed-TTS 벤치마크에서 Qwen3-TTS는 영어 테스트에서 Word Error Rate(WER) 1.24를 기록하며 SOTA를 달성했습니다. CosyVoice 3(1.45)와 MiniMax-Speech(1.65)를 제치고 가장 낮은 오류율을 보였죠. 중국어에서도 0.77의 WER로 1위를 차지했습니다.

더 인상적인 것은 교차언어 음성 생성 능력입니다. 중국어 음성 샘플을 한국어로 변환할 때 오류율을 4.82%로 낮췄는데, 이는 CosyVoice 3(14.4%)보다 약 66% 개선된 수치예요. 화자의 정체성을 유지하면서도 다른 언어로 자연스럽게 말하는 것이 가능합니다.

97ms 초저지연, 실시간 대화가 가능한 이유

첫 음성 패킷이 출력되기까지 걸리는 시간, 즉 First-Packet Latency가 97ms라는 것은 사람이 체감하기 어려울 정도로 빠릅니다. 이는 실시간 대화 애플리케이션에서 필수적인 성능이죠.

이 속도를 가능하게 만든 핵심은 12Hz Tokenizer입니다. 기존 25Hz Tokenizer는 chunk-wise 방식으로 미래 토큰을 기다려야 했지만, 12Hz Tokenizer는 pure left-context 디자인을 채택해 토큰이 생성되는 즉시 음성으로 변환합니다. 80ms 단위로 음성을 출력하면서도 경량 causal ConvNet 덕분에 계산 부담이 적습니다.

동시 접속이 많은 환경에서도 안정적이에요. 동시 접속 6개 상황에서 RTF(Real-Time Factor)가 0.463으로, 실시간보다 2배 이상 빠른 속도를 유지합니다. vLLM 엔진과 CUDA Graph 가속을 활용한 최적화 덕분입니다.

10개 언어 지원과 텍스트로 만드는 목소리

Qwen3-TTS는 중국어, 영어, 독일어, 이탈리아어, 포르투갈어, 스페인어, 일본어, 한국어, 프랑스어, 러시아어를 지원합니다. 500만 시간 이상의 멀티링구얼 음성 데이터로 학습했고, 모든 언어에서 상용 서비스인 MiniMax와 ElevenLabs보다 높은 화자 유사도를 기록했습니다.

특히 Voice Design 기능이 흥미롭습니다. “중년 남성, 차분한 목소리, 약간 쉰 음색”처럼 텍스트로 목소리를 설명하면 Qwen3-TTS가 그에 맞는 음성을 생성합니다. InstructTTSEval 벤치마크에서 오픈소스 모델 중 최고 성능을 보였고, Hume 같은 상용 시스템도 능가했어요.

긴 형태 음성 생성도 안정적입니다. 10분 이상의 콘텐츠를 생성할 때 chunk 기반 시스템들이 경계 지점에서 어색한 단절을 보이는 반면, Qwen3-TTS는 전체 길이에 걸쳐 일관된 운율을 유지합니다. 오디오북이나 팟캐스트 제작에 바로 활용할 수 있는 수준입니다.

두 가지 전략, 상황에 맞는 선택

Qwen3-TTS는 두 종류의 토크나이저를 제공합니다. 25Hz Tokenizer는 의미론적 정보를 강조해 긴 음성의 안정성이 뛰어나고, 12Hz Tokenizer는 초저지연이 필요한 실시간 대화에 최적화되었습니다. 사용 사례에 따라 선택할 수 있죠.

모델 크기도 0.6B와 1.7B 두 가지입니다. 1.7B 모델이 전반적으로 우수한 성능을 보이지만, 0.6B 모델도 대부분의 벤치마크에서 경쟁력 있는 결과를 냅니다. 리소스 제약이 있는 환경에서는 0.6B 모델로도 충분한 품질을 얻을 수 있어요.

논문은 향후 10개 이상의 언어로 확장하고, 더 세밀한 스타일 제어 기능을 추가할 계획이라고 밝혔습니다. 음성 생성을 넘어 범용 오디오 생성 시스템으로 발전시키는 것이 목표입니다.

참고자료:

- Qwen3-TTS Technical Report – arXiv

- Running Qwen3-TTS with MLX-Audio on macOS – myByways

답글 남기기