머신러닝

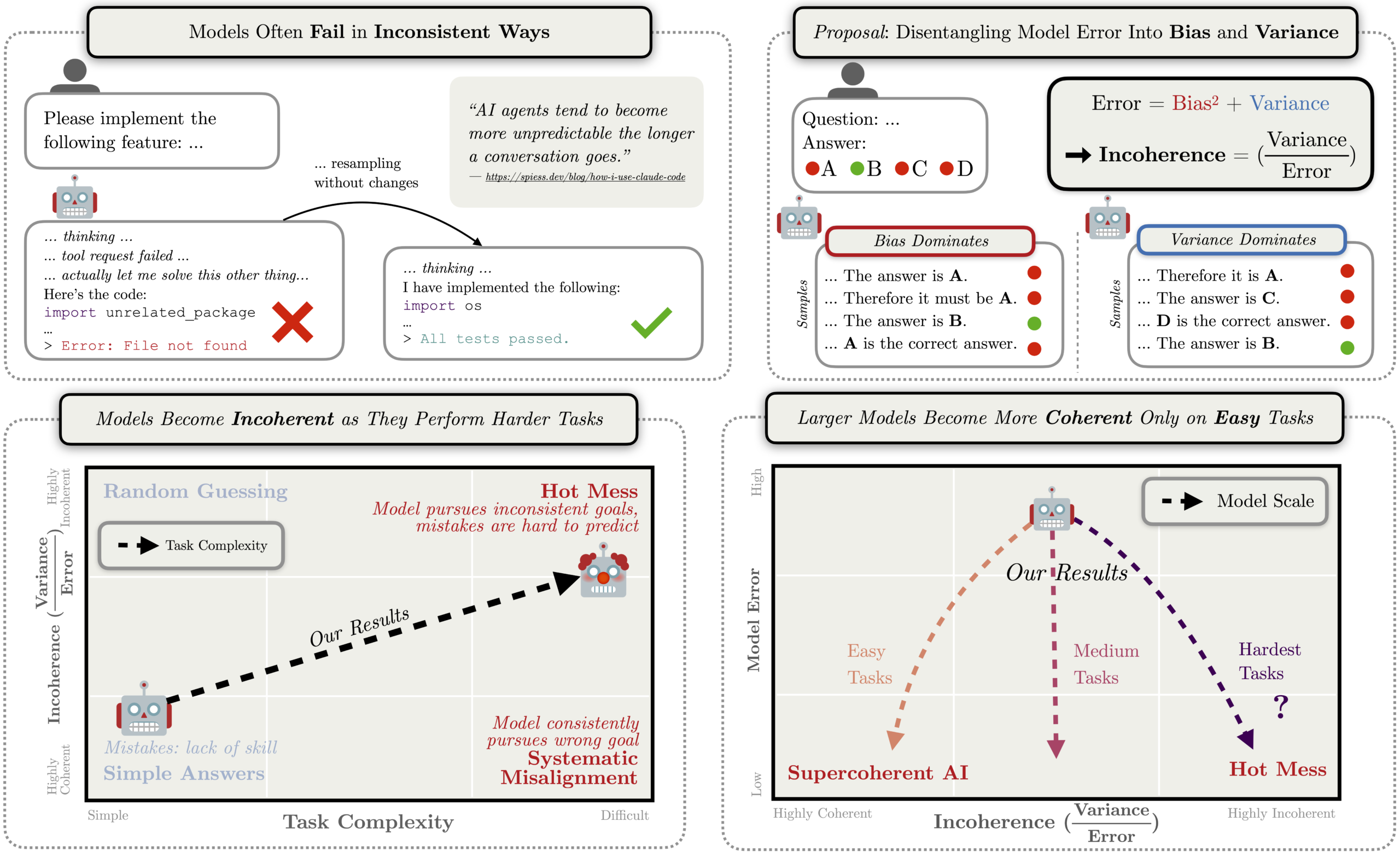

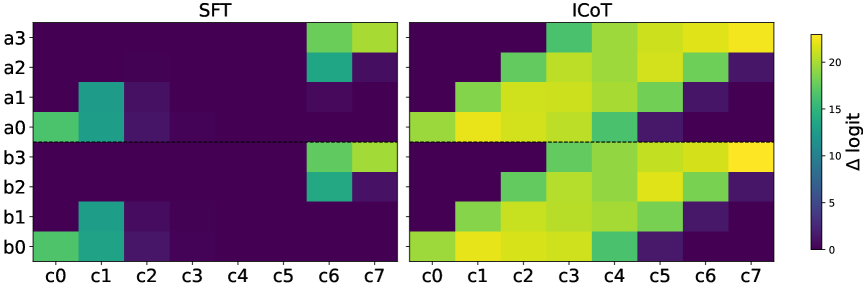

AI가 실패할 때, 체계적 오류보다 갈팡질팡이 더 위험할 수 있다는 연구

AI가 실패할 때 체계적 misalignment보다 비일관적 행동이 더 흔할 수 있다는 Anthropic 연구. AI 안전성 연구의 새로운 관점을 제시합니다.

Written by

AI 에이전트 성능 개선, 코드 변경 없이 강화학습으로 해결하는 Agent Lightning

Microsoft가 공개한 Agent Lightning으로 코드 변경 없이 AI 에이전트를 강화학습으로 훈련시키는 방법. 모든 프레임워크 호환 가능합니다.

Written by

Claude가 LLM 파인튜닝을 알아서 한다: Hugging Face Skills

Claude에게 자연어로 지시하면 LLM 파인튜닝을 알아서 처리하는 Hugging Face Skills. 30센트부터 시작 가능한 AI 자동 학습 시스템을 소개합니다.

Written by

구글, AI 데이터센터를 우주로: 2027년 TPU 탑재 위성 발사 계획

구글이 AI 데이터센터를 우주로 보내는 Project Suncatcher를 발표했습니다. 2027년 TPU 탑재 위성 발사 계획과 우주 기반 AI 컴퓨팅의 가능성을 소개합니다.

Written by

GPT가 곱셈을 못하는 진짜 이유: 트랜스포머의 숨겨진 약점

GPT-4도 4×4 곱셈에서 95% 이상 실패하는 이유를 하버드와 MIT 연구진이 밝혔습니다. 트랜스포머의 장거리 의존성 학습 한계와 실무 적용 가능한 해결책을 소개합니다.

Written by

코드 수정 없이 AI 에이전트를 강화학습으로 훈련: Microsoft Agent Lightning

Microsoft Agent Lightning으로 기존 AI 에이전트를 코드 수정 없이 강화학습으로 훈련하는 방법. LangChain, AutoGen 등 모든 프레임워크 지원, SQL 에이전트 정확도 73%→80% 향상 사례 포함

Written by

온톨로지 전문가가 사라진다: LLM이 바꾸는 지식 그래프의 미래

LLM이 지식 그래프 구축을 어떻게 혁신하고 있는지 살펴봅니다. 온톨로지 자동화, 스키마 프리 추출, 동적 메모리 시스템 등 최신 프레임워크(EDC, AutoSchemaKG, GraphRAG)를 통해 규칙 기반에서 생성 기반으로의 패러다임 전환을 소개합니다.

Written by

AGI는 아직 10년 거리: Andrej Karpathy가 말하는 AI 에이전트의 진짜 현실

OpenAI 디렉터 Andrej Karpathy가 말하는 AI 에이전트의 현실과 한계. AGI가 10년 더 걸리는 이유, 강화학습의 근본적 문제, 그리고 코딩 AI의 실제 능력치를 솔직하게 분석합니다.

Written by

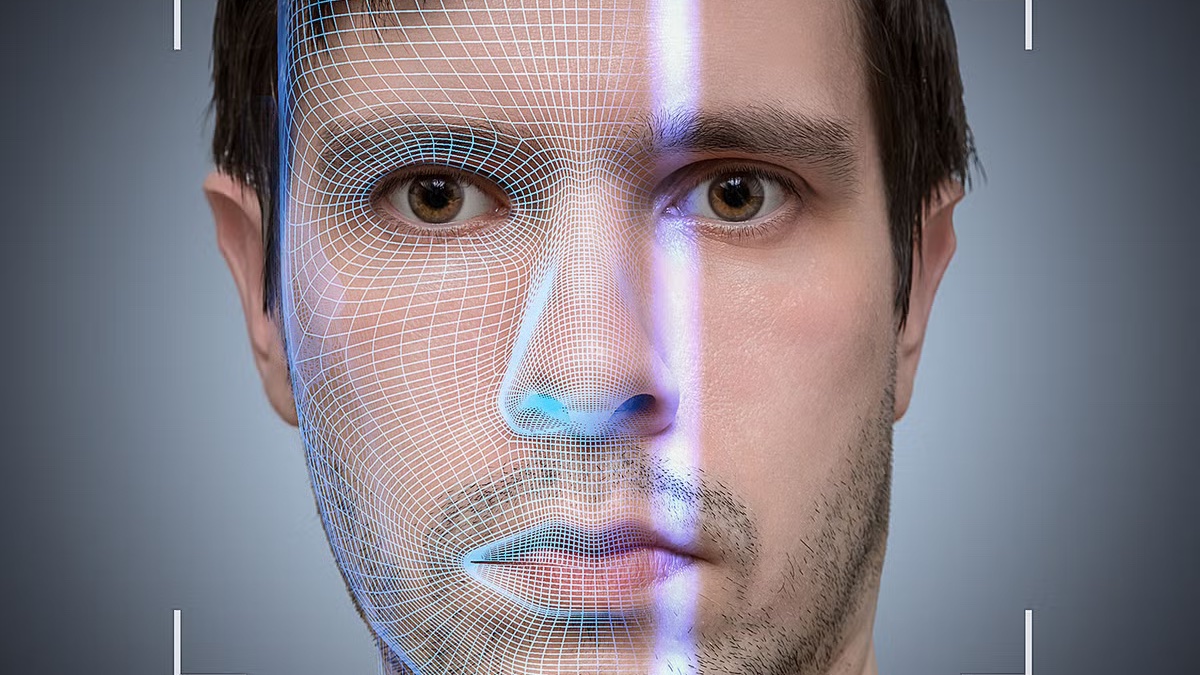

당신의 AI는 누구를 배제하고 있는가: 얼굴 인식이 만드는 새로운 차별

얼굴 인식 기술이 1억 명의 안면 차이를 가진 사람들을 시스템에서 배제하고 있습니다. 운전면허, 금융 서비스, 정부 시스템 접근이 차단되는 실제 사례와 함께 AI 학습 데이터의 편향 문제, 대체 수단의 필요성을 살펴봅니다.

Written by