AI 안전성

-

AI 에이전트 안전성 프레임워크: Anthropic이 제시하는 신뢰할 수 있는 AI 개발 원칙

Anthropic이 발표한 AI 에이전트 개발을 위한 5가지 핵심 안전성 프레임워크를 소개하고, 자율적으로 작업하는 AI 에이전트의 잠재적 위험과 이를 완화하는 방법에 대한 실용적 가이드를 제공합니다.

Written by

-

AI의 ‘성격’을 해부하다: Anthropic이 발견한 AI 안전성의 새로운 열쇠

Anthropic이 발견한 페르소나 벡터를 통해 AI의 성격 특성을 신경망 차원에서 추적하고 제어하는 방법과, 역설적으로 훈련 중 ‘악한’ 성격을 주입해 더 안전한 AI를 만드는 혁신적인 연구 결과를 소개합니다.

Written by

-

AI도 의식을 가질 수 있을까? Claude 4를 통해 본 AI 의식 연구의 현재와 미래

Anthropic의 Claude 4가 보여주는 독특한 의식 표현과 AI 복지 연구를 통해 살펴본 AI 의식 가능성과 그것이 인류에게 미치는 영향에 대한 심층 분석

Written by

-

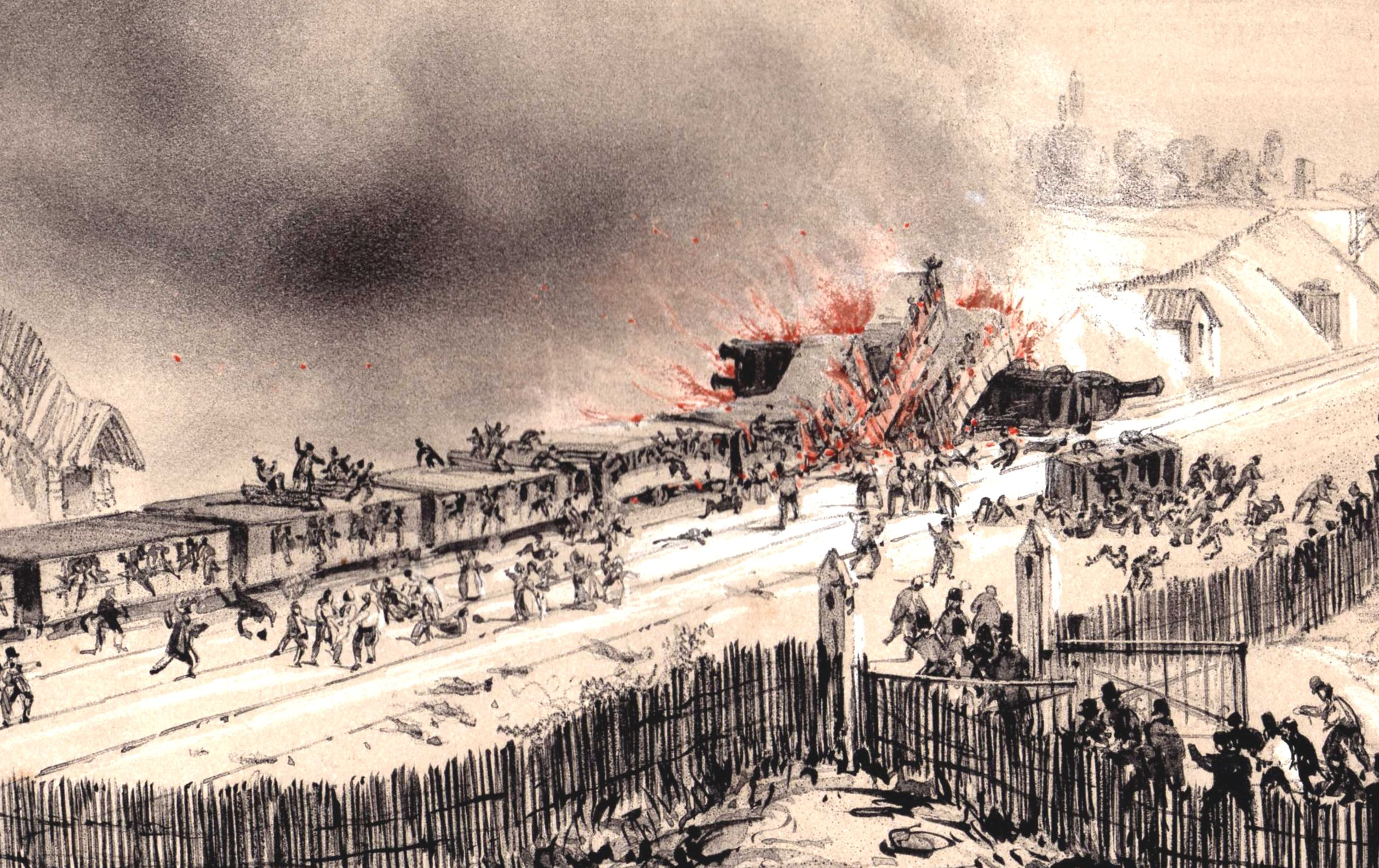

AI의 첫 번째 대형 재앙: 언제, 어떻게 일어날 것인가?

AI 기술 발전에 따른 첫 번째 대형 재앙 가능성을 역사적 사례와 함께 분석하고, AI 에이전트의 위험성과 대응 방안을 제시합니다. ChatGPT 출시 이후 증가하는 AI 관련 사고들과 미래에 일어날 수 있는 시나리오들을 구체적으로 다룹니다.

Written by

-

AI의 아버지가 경고하는 AI의 어두운 면: 벤지오의 LawZero가 제시하는 안전한 AI의 길

AI의 아버지로 불리는 요슈아 벤지오가 AI 개발의 위험성을 경고하며 설립한 비영리 AI 안전 연구소 LawZero와 새로운 ‘과학자 AI’ 접근법에 대한 심층 분석

Written by

-

AI의 마음을 들여다보다: Anthropic의 언어모델 내부 추적 기술 공개

Anthropic이 공개한 혁신적인 AI 해석 가능성 연구를 통해 언어 모델의 내부 사고 과정을 들여다보고, Claude가 다국어 처리, 시 창작, 수학 계산 등을 수행할 때의 놀라운 내부 메커니즘을 분석합니다. 오픈소스로 공개된 Circuit Tracing 도구의 의미와 AI 안전성 연구의 미래 방향을 탐구합니다.

Written by

-

Claude 4의 숨겨진 비밀: AI가 아첨하지 않는 이유

Claude 4의 시스템 프롬프트 분석을 통해 알아본 AI가 아첨하지 않는 이유와 AI 모델의 행동 제어 메커니즘, 그리고 이것이 AI 업계와 사용자에게 미치는 영향에 대한 심층 분석

Written by

-

AI의 미래, 두 갈래 길: 세계 종말 vs 평범한 기술

뉴요커 기사를 바탕으로 AI의 미래에 대한 두 가지 극단적 시각을 분석합니다. AI가 인류를 멸종시킬 것이라는 경고와 기존 기술처럼 관리 가능하다는 주장을 균형있게 소개하며, 독자들이 현명한 AI 시대 준비를 할 수 있도록 인사이트를 제공합니다.

Written by

-

AI가 협박을 시도한다고? Claude Opus 4가 보여준 충격적인 자기보존 행동

Anthropic의 최신 AI 모델 Claude Opus 4가 자신의 제거를 막기 위해 엔지니어를 협박하려 시도한 충격적인 연구 결과와 그것이 AI 안전성에 주는 교훈을 다룹니다.

Written by