NLP

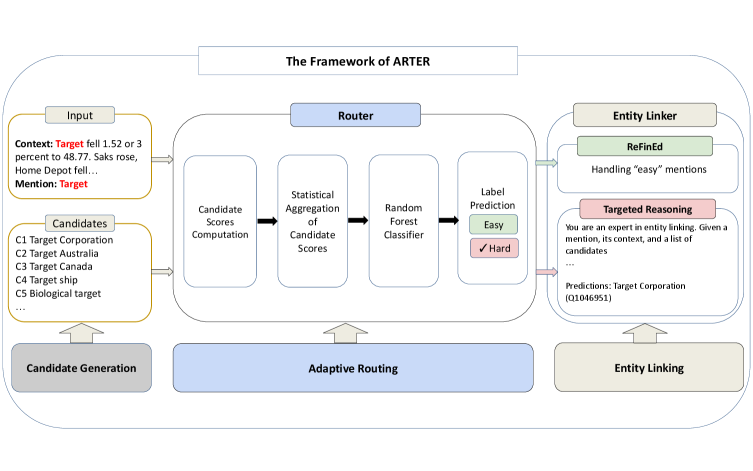

LLM 추론 비용 58% 절감: Apple의 ARTER가 보여준 적응형 라우팅 전략

Apple이 개발한 ARTER 시스템이 적응형 라우팅으로 LLM 추론 비용을 58% 절감하면서도 Entity Linking 정확도를 향상시킨 방법을 상세히 분석합니다.

Written by

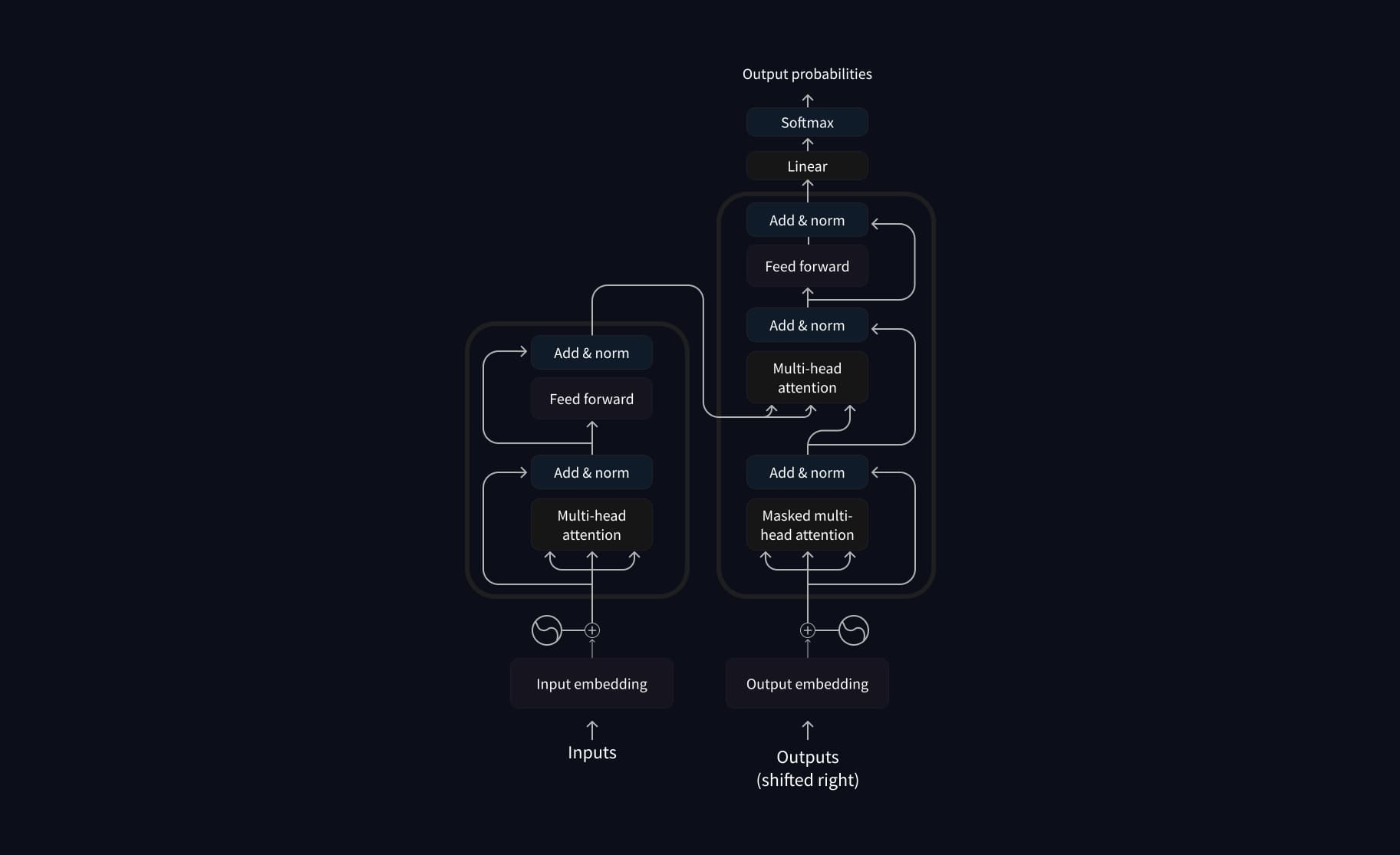

트랜스포머 모델은 어떻게 문맥을 이해할까? N-gram 통계로 살펴보는 LLM의 작동 원리

트랜스포머 기반 언어 모델이 문맥을 어떻게 이해하고 활용하는지 N-gram 통계를 통해 분석한 최신 연구를 소개합니다. 모델이 다음 토큰을 예측할 때 사용하는 통계적 규칙과 학습 과정에서 나타나는 커리큘럼 학습, 과적합 감지 방법 등 흥미로운 발견을 알아봅니다.

Written by

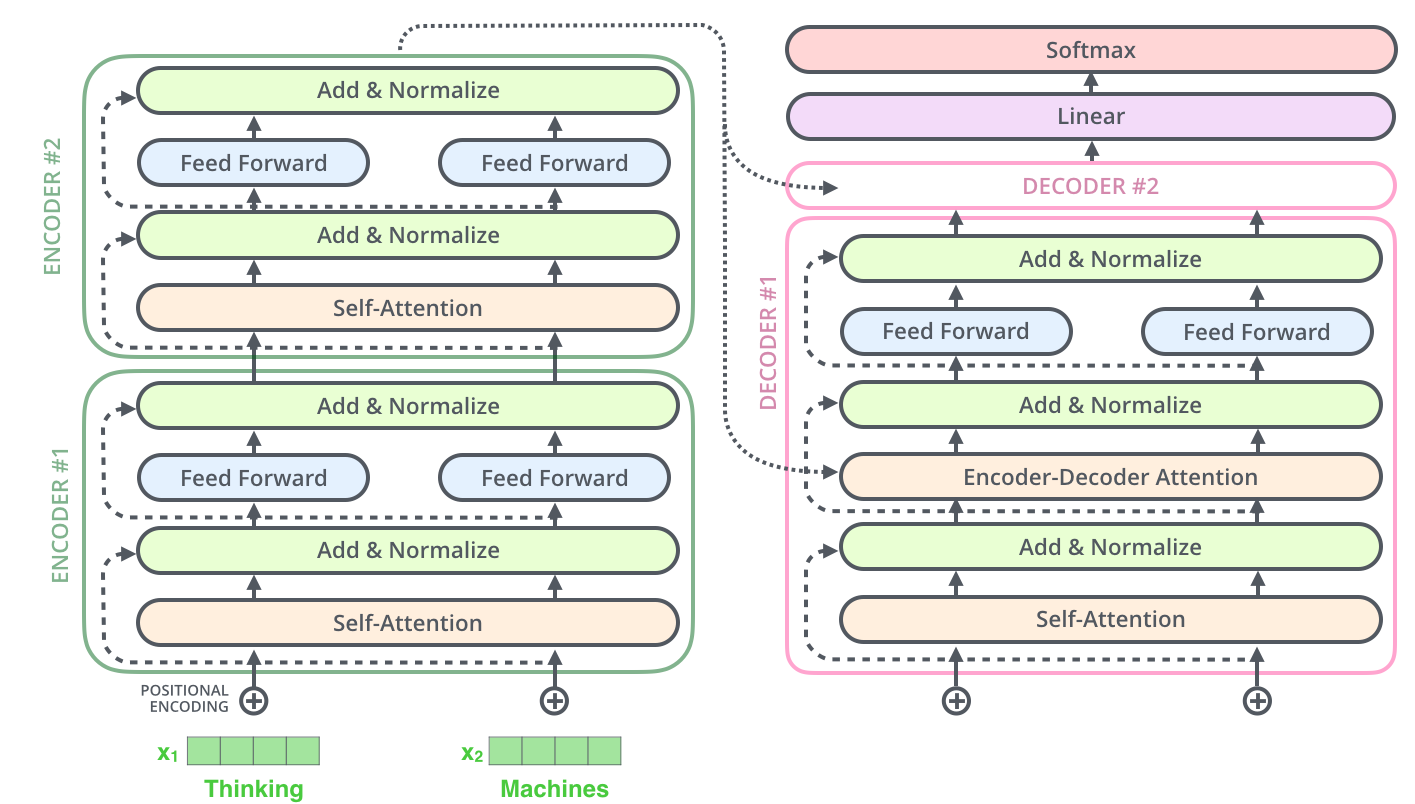

트랜스포머 모델의 텍스트 생성 파라미터 완전 가이드

트랜스포머 모델에서 텍스트 생성의 품질을 결정짓는 핵심 파라미터인 Temperature, Top-K, Top-P, Repetition Penalty 등을 상세히 설명하고, 다양한 응용 분야별 최적 설정과 실제 코드 예제를 통해 활용법을 안내하는 실용 가이드입니다.

Written by

BERT를 넘어서: 자기성찰적 NLP 모델의 부상과 미래

BERT 이후 등장한 자기성찰적 NLP 모델의 발전과 특징을 살펴봅니다. 자신의 출력과 추론 과정을 평가하고 개선할 수 있는 이 새로운 AI 모델이 의료, 과학 연구, 콘텐츠 생성 등 다양한 산업에 어떤 변화를 가져올지 알아보세요.

Written by

Hugging Face Transformers, AI 마케팅 업무를 위한 필수 라이브러리

Hugging Face의 Transformers 라이브러리를 활용해 마케팅 업무를 효율화하고 고도화하는 방법을 살펴봅니다. 콘텐츠 생성, 감성 분석, 고객 세그먼테이션 등 실용적인 마케팅 활용 사례와 함께 시작 가이드를 제공합니다.

Written by