프롬프트엔지니어링

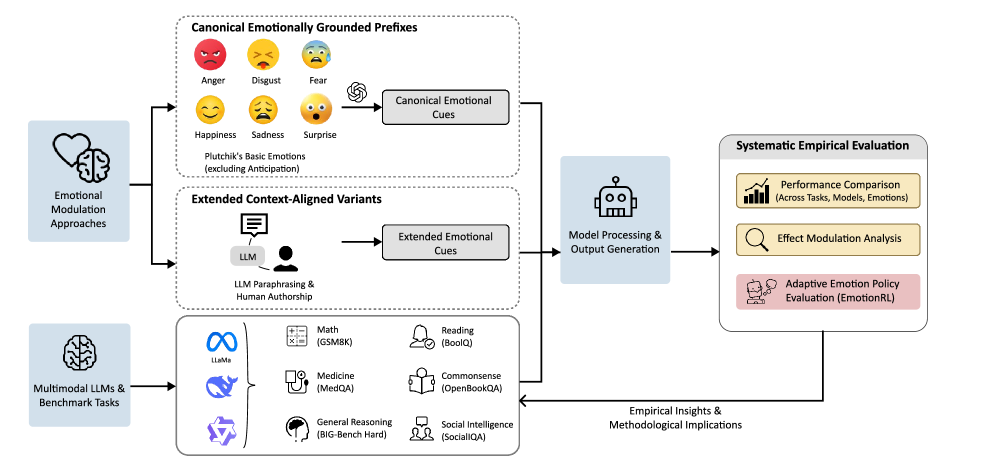

LLM에 감정을 넣으면 성능이 오를까, 6가지 감정 실험 결과

LLM에 감정 표현을 넣으면 성능이 오른다는 통념을 Harvard 연구팀이 실험으로 검증. 고정 감정은 효과 미미하지만, 적응형 감정 선택(EmotionRL)은 유효하다는 결과를 소개합니다.

Written by

Claude Code로 혼자 60만 줄 썼다, gstack이 뭐길래

YC CEO 개리 탄의 Claude Code 세팅 ‘gstack’ 공개 후 GitHub 스타 2만 개와 논란이 동시에 터진 이유. AI 에이전트 코딩 노하우의 표준화 문제를 짚습니다.

Written by

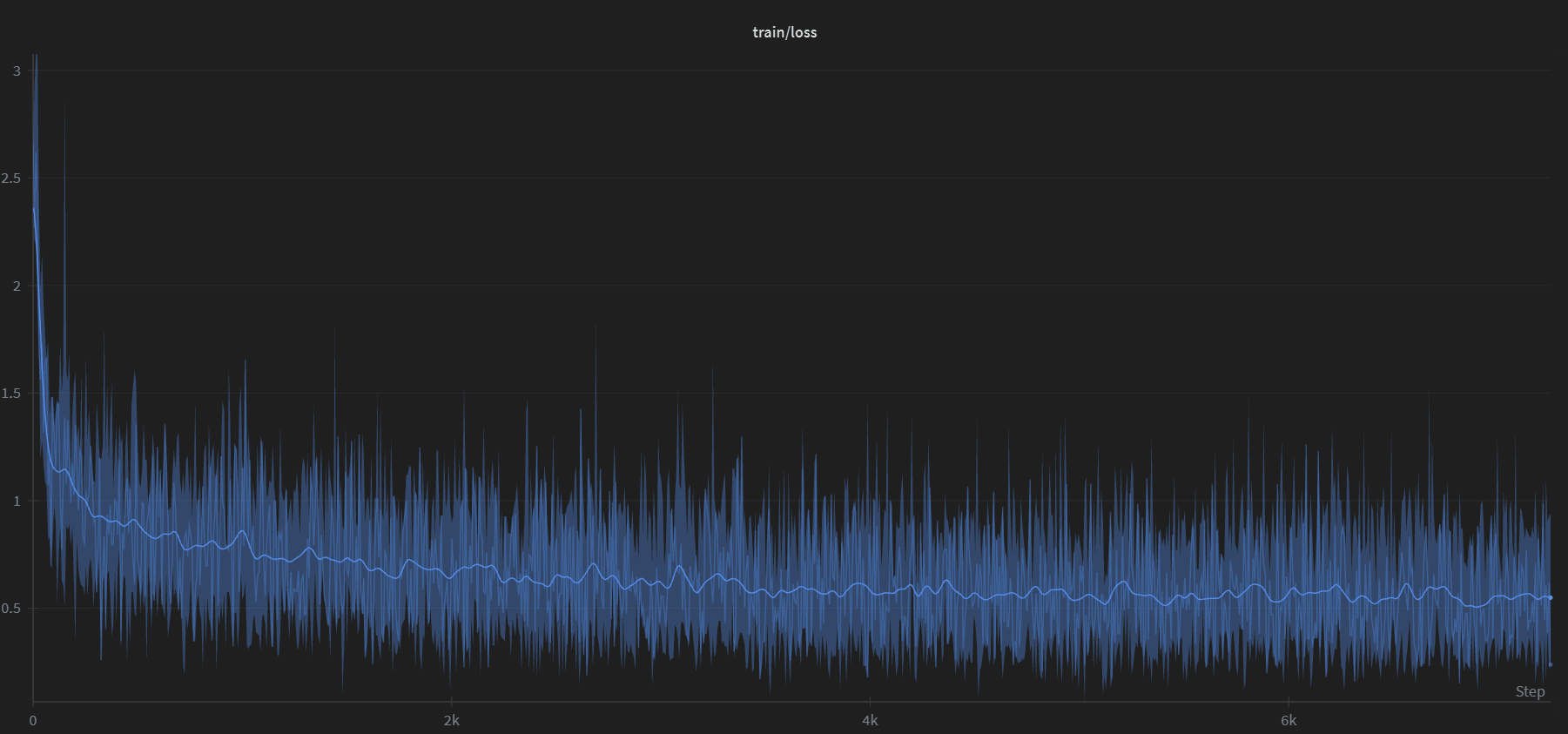

AI 응답에서 프롬프트를 역추적한다, 리버스 프롬프팅 실험

AI 응답에서 원래 프롬프트를 역추적하는 리버스 프롬프팅 실험. DEJAN이 Gemma 3 270M을 파인튜닝해 만든 도구의 작동 원리와 활용 가능성을 소개합니다.

Written by

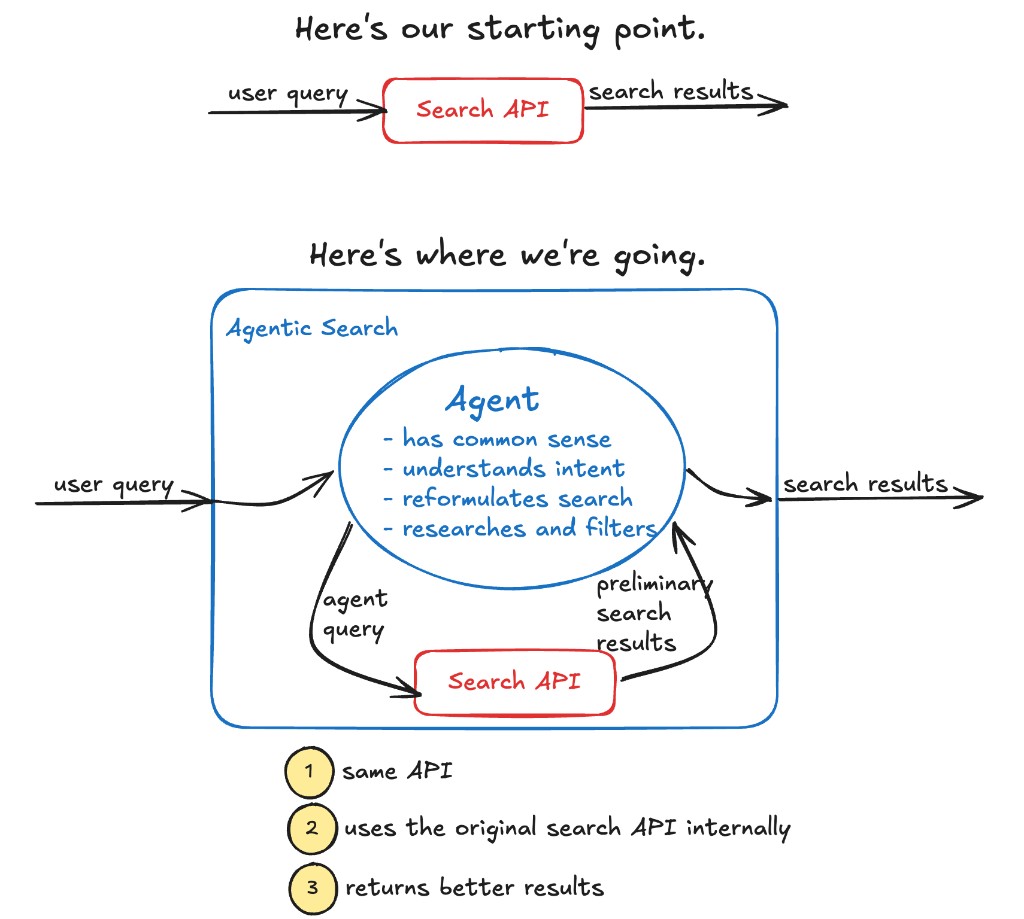

AI 에이전트로 검색 품질 6-10% 올린 실험, ML 팀 없이도 가능하다

ML 팀 없이 AI 에이전트 하나로 검색 품질을 6-10% 개선한 실험. 에이전틱 검색의 작동 방식, 실패 패턴, 지연 시간 트레이드오프를 소개합니다.

Written by

Claude가 XML 태그에 유독 잘 반응하는 이유, 언어학으로 풀었다

Claude에서 XML 태그가 효과적인 이유를 언어학적 원리로 설명한 글. 1차/2차 표현 구분이라는 모든 언어에 공통된 구조와 연결해 해석합니다.

Written by

멀티턴 대화에서 LLM 정확도 33% 하락, GPT-5도 예외 없었다

GPT-5 포함 최신 LLM도 대화가 길어지면 정확도가 33% 하락한다는 연구. 원인과 패턴을 분석합니다.

Written by

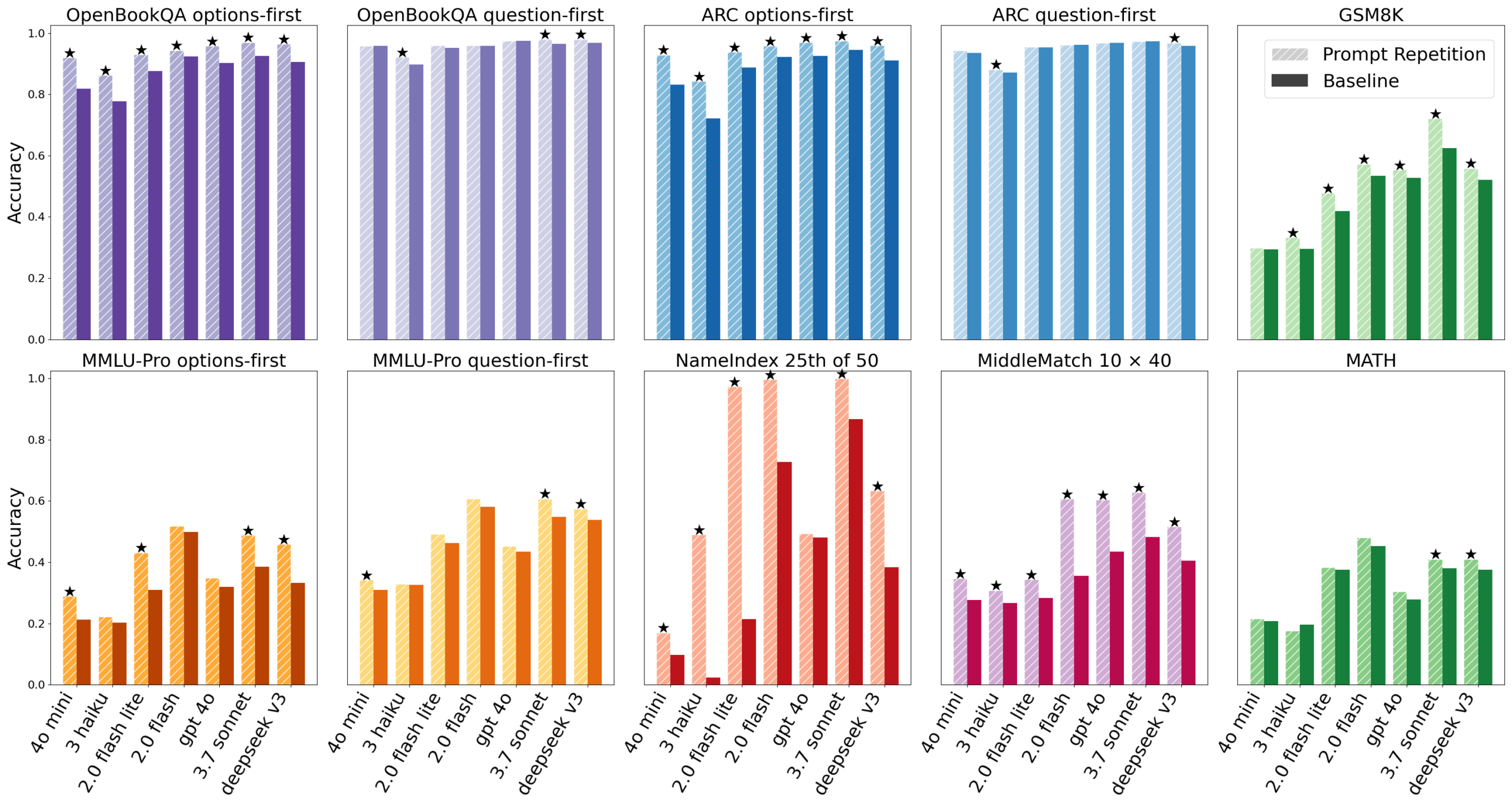

프롬프트 두 번 붙여넣기로 LLM 정확도 높이는 방법, Google 연구 결과

Google Research가 발견한 프롬프트 반복 기법. LLM에 같은 프롬프트를 두 번 입력하면 비용·지연 증가 없이 정확도가 오릅니다.

Written by

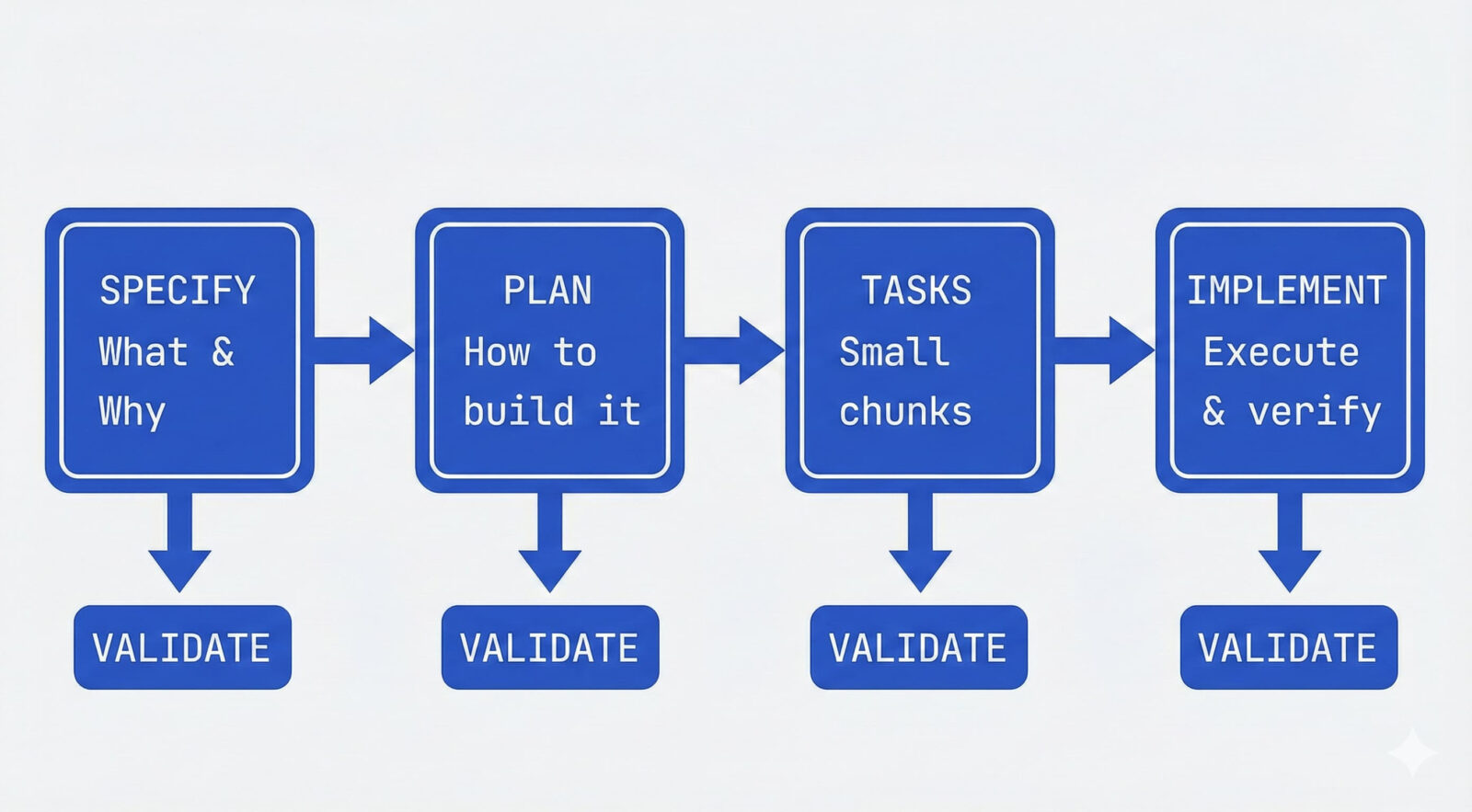

AI 에이전트 스펙 작성, 2,500개 파일이 알려준 실패 패턴

GitHub 2,500개 에이전트 파일 분석이 밝힌 AI 에이전트 스펙 실패 패턴과 성공하는 스펙의 6가지 핵심 영역, 3계층 경계 설정 방법을 소개합니다.

Written by

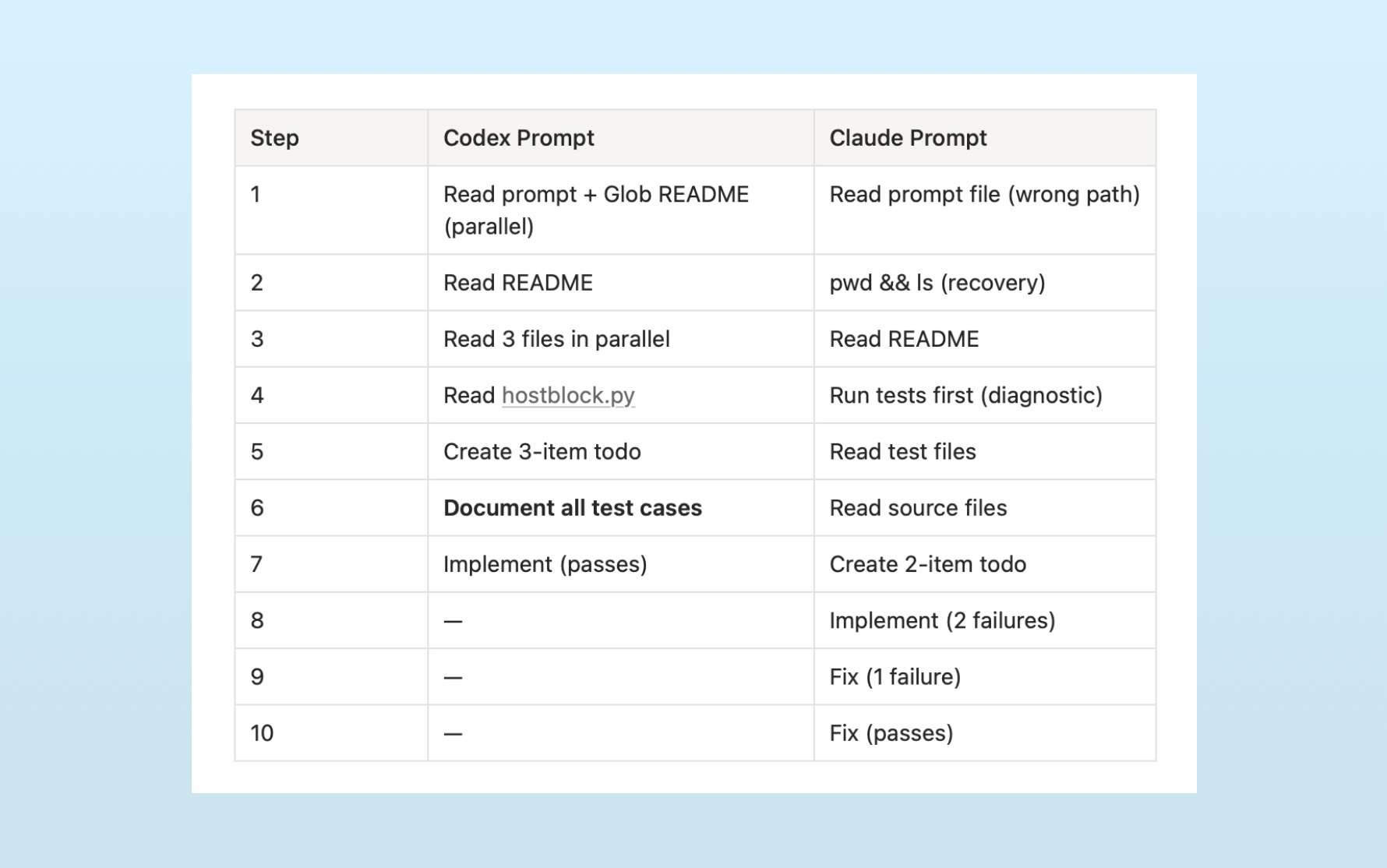

같은 AI 모델이 다르게 작동하는 이유, 시스템 프롬프트의 숨은 영향력

같은 AI 모델도 시스템 프롬프트에 따라 완전히 다른 코딩 에이전트가 됩니다. 6개 제품 분석과 실험으로 증명된 프롬프트의 영향력을 소개합니다.

Written by

65줄 텍스트가 AI 코딩을 바꿨다? 하루 400 스타 받은 파일의 정체

65줄 텍스트 파일이 AI 코딩을 개선한다며 GitHub 스타 4천 개를 받았지만, 정작 효과는 불확실합니다. 프롬프트의 실제 영향력에 대한 흥미로운 현상을 분석합니다.

Written by