AI는 프롬프트를 받아 응답을 만듭니다. DEJAN은 그 방향을 뒤집었습니다. 응답이 주어지면, 그것을 만들어낸 프롬프트를 역추적하는 모델을 직접 훈련해 공개했습니다.

출처: Reverse Prompting: Reconstructing Prompts from AI-Generated Text – DEJAN

역방향으로 뒤집기

일반적인 LLM 워크플로우는 프롬프트 → 응답입니다. DEJAN이 시도한 것은 그 반대, 즉 응답 → 프롬프트입니다.

목표는 원본 프롬프트를 정확히 복원하는 게 아닙니다. “이 응답을 가장 자연스럽게 만들어냈을 질문은 무엇인가?”를 역추론해 그럴듯한 후보 프롬프트를 신뢰도 순으로 제시하는 것입니다. 완전한 복원보다 가능성 높은 해석들을 펼쳐 보이는 방식이죠.

소형 모델로 만든 역추적 엔진

DEJAN은 구글의 Gemma 3 270M 모델을 파인튜닝했습니다. 270M이라는 파라미터 수는 요즘 기준으로 매우 작은 편입니다. 이 크기를 선택한 데는 이유가 있습니다. 일반 소비자용 GPU 한 장으로 훈련이 가능하고, CPU에서도 추론을 돌릴 수 있어 무료 데모로 공개하기에 적합했습니다.

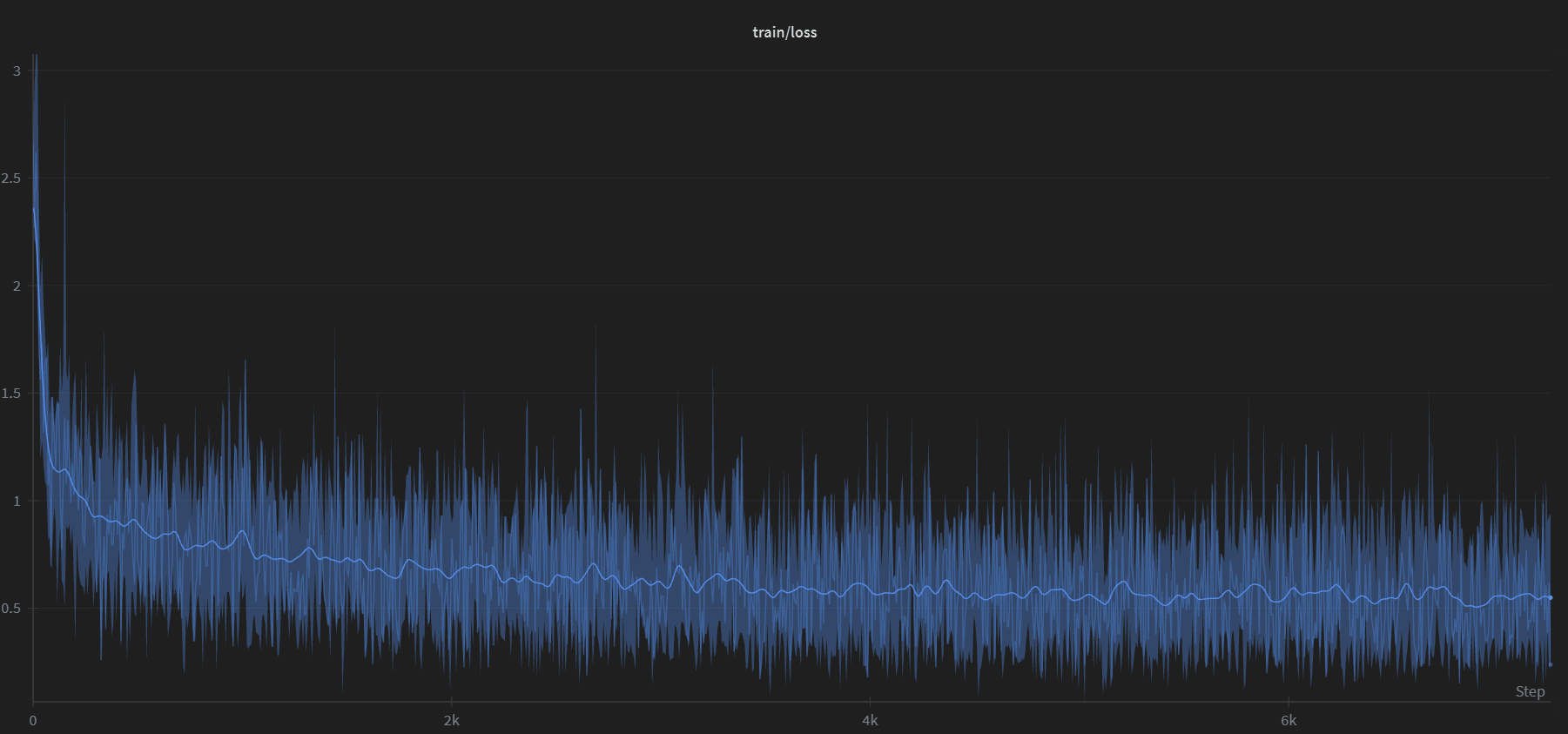

훈련 데이터는 Gemini 2.5 Flash로 생성한 10만 개의 합성 프롬프트-응답 쌍입니다. 검색 쿼리형부터 상세한 지시형까지 다섯 가지 스타일을 혼합해 다양한 사용자 패턴을 커버했습니다. 훈련은 RTX 4090 한 장으로 약 4시간 만에 완료됐습니다.

학습 방식에서 핵심적인 설계 결정이 하나 있습니다. 모델이 입력(응답)을 다시 학습하는 데 용량을 낭비하지 않도록, 프롬프트 부분만 예측하게 손실을 마스킹했습니다. {응답}\n###\n{프롬프트} 형식으로 데이터를 구성하고 구분자 이전 부분의 학습을 차단한 것이죠.

24가지 디코딩 설정과 퍼플렉시티 랭킹

하나의 응답에서 단 하나의 후보만 뽑으면 다양성이 부족합니다. DEJAN은 이를 해결하기 위해 24가지 디코딩 설정을 조합해 24개의 후보 프롬프트를 생성한 뒤, 퍼플렉시티(perplexity) 점수로 순위를 매깁니다.

퍼플렉시티는 모델이 “이 응답에 대해 이 프롬프트가 얼마나 자연스럽게 연결되는가”를 수치로 표현한 값입니다. 점수가 낮을수록 더 그럴듯한 프롬프트라는 의미입니다. 최종적으로 상위 10개 후보가 단어별 신뢰도 시각화와 함께 표시됩니다.

작은 모델, 예상 밖의 가능성

이 실험에서 드러난 점 몇 가지가 있습니다.

합성 데이터로 훈련했음에도 다른 모델들의 출력에도 잘 일반화됩니다. 역방향 매핑은 특정 모델의 말투보다 응답의 구조와 의도에 더 의존하기 때문입니다. 또한 270M 규모의 소형 모델이 이 역추적 작업을 꽤 안정적으로 수행했다는 점도 주목할 만합니다. 모델 크기보다 디코딩 전략의 다양성이 결과 품질에 더 크게 기여했다는 게 팀의 판단입니다.

활용 가능성도 다양합니다. 마음에 드는 AI 출력물이 있을 때 그것을 만들어낸 프롬프트 구조를 역추론해 자신의 프롬프트를 개선하거나, 웹 콘텐츠를 넣어 “이 페이지가 답하는 질문은 무엇인가”를 파악하는 시맨틱 분석 도구로도 활용할 수 있습니다. AI 생성 콘텐츠 판별의 신호로 쓸 가능성도 언급됩니다. 퍼플렉시티가 낮게 나올수록 AI 응답 패턴에 가깝다는 추정이 가능하기 때문입니다.

모델과 코드는 Hugging Face에 공개되어 있고, 라이브 데모는 dejan.ai/tools/reverse-prompter에서 직접 사용해볼 수 있습니다. 코드 구현 세부사항이나 디코딩 설정별 비교 결과가 궁금하다면 원문을 참고하세요.

답글 남기기