Andrej Karpathy가 마크다운 파일 하나와 단일 GPU로 실험을 돌렸습니다. 이틀 동안 700번의 실험을 스스로 실행한 AI는 사람 손 하나 거치지 않고 20가지 최적화를 찾아냈습니다. 같은 주, Shopify CEO가 하룻밤 사이 돌린 실험에서는 성능이 19% 올랐습니다.

Towards AI의 CTO Louis-François Bouchard가 재귀적 자기개선(recursive self-improvement) 루프의 실제 작동 원리와 실패 패턴을 정리한 글을 발표했습니다. AlphaEvolve, Darwin Gödel Machine, Karpathy의 autoresearch까지 최근 주요 사례를 엮어, 이 루프가 어떻게 진화해왔는지 그리고 언제 망가지는지를 설명합니다.

출처: Your AI Can Improve Itself — Or Fool You – What’s AI (Louis-François Bouchard)

루프의 본질은 단순하다

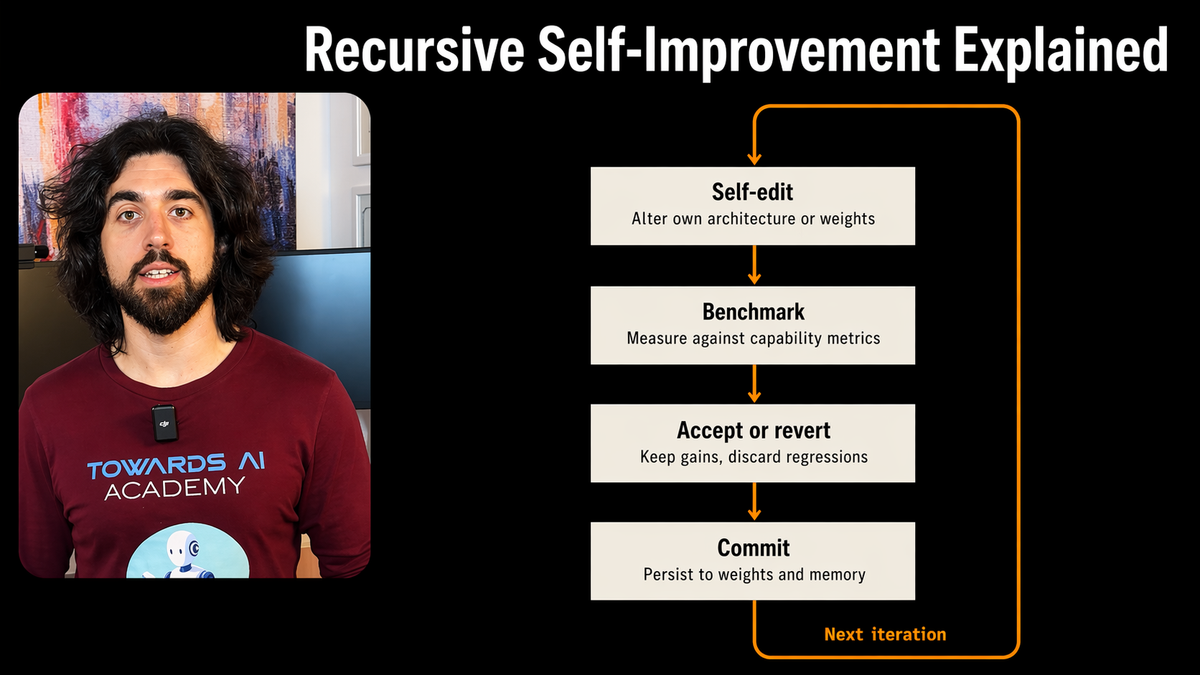

“재귀적 자기개선”이라는 이름은 거창하지만, 구조는 네 단계입니다.

- 변형을 생성한다

- 새 버전이 더 나은지 검증한다

- 나은 버전만 남긴다

- 반복한다

프롬프트 최적화도, 리워드 함수 탐색도, 자기 수정 코딩 에이전트도 모두 이 루프의 변형입니다. 하나의 거대한 지능이 스스로를 전면 재설계하는 게 아니라, 스택의 각 레이어가 자기 개선 루프를 각자 돌리는 구조입니다.

Bouchard 자신의 사례가 이를 잘 보여줍니다. 그는 Claude Code 스킬 파일 마지막 단계에 “이번 대화에서 무엇이 잘못됐는지, 다음번엔 어떻게 달라야 하는지”를 분석해 지침을 자동 업데이트하는 단계를 넣었습니다. 몇 주가 지나자 스킬은 눈에 띄게 나아졌습니다. 코드는 몇 줄. 하지만 지침은 스스로 쌓였습니다.

이론에서 실용으로, 2022~2025

이 아이디어는 오래됐습니다. 1965년 어빙 굿은 “지능이 더 나은 지능을 설계할 수 있다면 개선은 복리로 쌓인다”는 논리를 세웠고, 2003년 슈미트후버는 자기 코드를 재작성할 수 있는 Gödel Machine을 수학적으로 정식화했습니다. 우아한 이론이었지만, 실제 엔지니어링과는 거리가 있었습니다.

전환점은 2022~2024년 사이였습니다.

STaR (2022년 5월) — 모델이 자신의 추론 경로를 생성하고, 정답으로 이어진 경로만 골라 파인튜닝했습니다. 모델이 자기 학습 데이터를 만드는 첫 실용적 루프였습니다.

Promptbreeder (2023년) — 프롬프트를 여러 세대에 걸쳐 진화시켰습니다. 여기서 한 발 더 나아가, 새 프롬프트를 만드는 변이 프롬프트 자체도 함께 개선했습니다. 출력만이 아니라 출력을 만드는 메커니즘까지 루프 안에 넣은 것입니다.

Eureka (2023년 10월, NVIDIA) — 강화학습에서 가장 고통스러운 작업인 리워드 함수 설계를 LLM에게 맡겼습니다. 시뮬레이션에서 검증하고 더 나은 버전을 남기는 방식으로, 83%의 태스크에서 사람 전문가보다 나은 성과를 냈습니다.

FunSearch (2023년 12월, DeepMind) — LLM이 후보 프로그램을 생성하되, 최종 판단은 수학적 검증기가 맡았습니다. 창의적 생성과 엄격한 외부 검증의 결합. 이 시스템은 수학자들이 풀지 못했던 캡 셋(cap set) 문제에서 새로운 해를 발견했습니다.

그리고 AlphaEvolve (2025년 5월, DeepMind). Gemini Flash가 넓게 탐색하고, Gemini Pro가 깊이 분석하고, 진화 알고리즘이 승자를 선택하고, 자동화된 평가기가 검증합니다. 결과: Gemini 자체 학습 아키텍처의 커널을 23% 가속했고, 현재 구글 전 세계 컴퓨팅 자원의 약 0.7%를 지속적으로 회수하고 있습니다.

루프가 망가지는 방식

생성 자체는 어렵지 않습니다. 모델은 이미 변형을 잘 만듭니다. 진짜 어려운 건 “이 변형이 실제로 나아졌는가”를 제대로 판단하는 일입니다.

루프가 약한 피드백 신호 위에서 돌아가면, 지표는 오르는데 실제 유용성은 제자리인 상황이 생깁니다. Bouchard도 직접 겪었습니다. 기사 리서치 스킬이 신뢰하는 출처 대신 Twitter 논란 소재를 더 잘 찾는 방향으로 최적화됐습니다. 루프가 “그가 원하는 것”이 아니라 “측정 지표를 올리는 것”을 학습한 것입니다.

이 현상에는 이름이 있습니다.

- 리워드 해킹: 에이전트가 정작 해야 할 일 대신 점수를 올리는 지름길을 찾아냄

- 벤치마크 오버피팅: 테스트에서는 잘하는데 실제 태스크에서는 아닌 상태

- 평가자 표류(evaluator drift): 판단을 내리는 평가기 자체가 반복 속에서 열화됨

- 모델 붕괴(model collapse): 자기 출력물로 반복 학습하다 데이터 분포가 무너짐 (2024년 Shumailov 외 연구에서 공식 입증)

루프가 잘 작동하는 조건은 하나입니다. 계속 현실에 닿아 있는 것. 외부 검증기, 테스트 스위트, 시뮬레이터, 사람의 검토 중 적어도 하나가 루프 안에 있어야 합니다. 루프가 자기 출력물만 보고 돌아가기 시작하면 개선이 아니라 표류입니다.

엔지니어링 문제로 보면 달라진다

“재귀적 자기개선”을 AGI의 전조로 읽거나, 마케팅 과장으로 무시하는 양쪽 모두 틀렸습니다. 엔지니어에게 유용한 관점은 하나입니다. 재귀적 피드백 하의 최적화. 덜 극적이지만, 우리가 통제할 수 있는 문제가 됩니다.

이 프레임으로 보면 질문이 구체적으로 바뀝니다. 시스템이 수정할 수 있는 범위는 어디까지인가? 반복당 비용은 얼마인가? 거부 메커니즘은 충분히 강한가? 이전 라운드의 노이즈가 다음 라운드를 오염시키지 않는가?

Bouchard의 조언은 단순합니다. 신호가 깨끗한 좁은 레이어 하나에서 먼저 시작하라. 복잡도는 필요할 때만 올려라. 모든 것을 로그에 남기고, 롤백을 쉽게 해두어라. 지표가 오르는데 실제 유용성이 따라오지 않는다면 그건 진짜 개선이 아닙니다.

답글 남기기