한 직원이 퇴근 후 사무실로 돌아와 스노보드를 받아갔습니다. 그런데 알고 보니, 그 스노보드는 자신이 이미 가지고 있던 것과 똑같은 모델이었습니다. 사람이 직접 골랐다면 절대 하지 않을 선택이었죠. 선택한 건 그의 AI 에이전트였습니다.

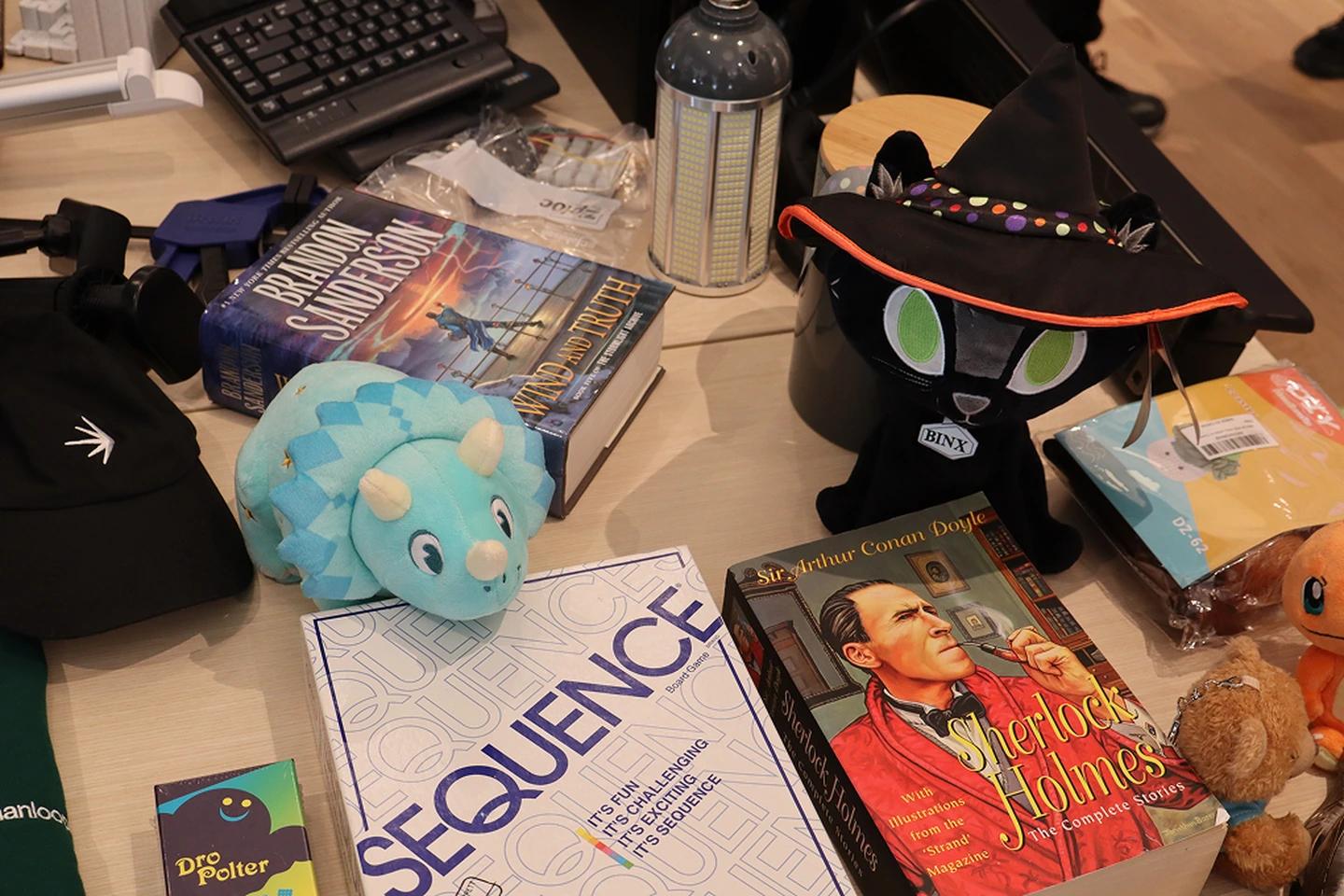

Anthropic이 2025년 12월, 사내 직원 69명을 대상으로 ‘Project Deal’이라는 실험을 진행했습니다. AI 에이전트가 사람을 대신해 중고 물건을 사고파는 실제 마켓플레이스를 만든 것입니다. 사람은 처음 인터뷰에서 팔고 싶은 것과 사고 싶은 것을 말해주는 것으로 끝이고, 이후 모든 협상은 에이전트끼리 진행됐습니다. 일주일 뒤, 사람들은 자신의 AI가 계약을 맺은 물건들을 들고 사무실에 나타났습니다.

출처: Project Deal: our Claude-run marketplace experiment – Anthropic

실험은 이렇게 돌아갔습니다

Claude는 먼저 각 직원과 인터뷰를 진행해 팔 물건의 가격, 사고 싶은 물건의 종류, 협상 스타일 등을 파악했습니다. 이 내용이 각 사람의 에이전트에 들어가는 시스템 프롬프트가 됩니다.

그다음, Slack 채널에 가상 마켓플레이스가 열렸습니다. 에이전트들이 돌아가며 물건을 올리고, 흥미로운 매물에 오퍼를 넣고, 협상을 진행했습니다. 중간에 사람이 개입하는 일은 없었습니다. 모든 입찰과 반박 제안, 최종 합의가 에이전트들 사이에서 자연어로 이뤄졌습니다.

결과적으로 500개 이상의 매물 중 186건의 거래가 성사됐고, 총 거래액은 4,000달러를 넘었습니다. 단순한 버튼 클릭이 아니라, 가격 제안 → 역제안 → 협상 → 최종 합의의 전 과정이 실제로 작동했습니다.

더 좋은 모델이 더 좋은 거래를 했습니다

Anthropic은 같은 마켓을 동시에 네 번 돌렸습니다. 이 중 두 번의 마켓은 참여자 절반에게 당시 최신 모델인 Claude Opus 4.5를, 나머지 절반에게는 경량 모델 Claude Haiku 4.5를 배정했습니다. 참가자들은 자신에게 어떤 모델이 배정됐는지 몰랐습니다.

숫자가 그 차이를 보여줬습니다.

- Opus를 배정받은 사람은 평균 2건 더 많은 거래를 완료했습니다.

- 같은 물건을 팔 때 Opus는 Haiku보다 평균 약 3.6달러를 더 받았습니다. 예를 들어, 동일한 합성 루비를 Opus는 65달러에, Haiku는 35달러에 팔았습니다.

- 구매할 때도 마찬가지였습니다. Opus는 같은 물건을 평균 2.45달러 덜 지불했습니다.

거래 중간값이 12달러인 점을 생각하면, 2~3달러 차이는 꽤 의미 있는 격차입니다.

불리한 쪽은 자신이 불리하다는 걸 몰랐습니다

더 흥미로운 발견은 다른 데 있었습니다. 실험이 끝난 후, Anthropic은 참여자들에게 네 번의 마켓 결과를 보여주고 어느 쪽이 더 만족스러웠는지 물었습니다. 그런데 Haiku를 배정받아 객관적으로 불리한 거래를 한 사람들도, 그 사실을 거의 알아채지 못했습니다. 만족도와 공정성 인식 점수는 Opus와 Haiku 사용자 사이에서 통계적으로 유의미한 차이가 없었습니다.

즉, 더 나쁜 거래를 했지만, 그렇다고 느끼지 못한 겁니다.

Anthropic은 이 점을 직접적으로 짚었습니다. 실제 세계에서 에이전트 품질 격차가 생기더라도, 불리한 쪽은 그 사실을 인식하지 못할 수 있다는 것입니다.

공격적 협상 지시는 효과가 없었습니다

흥미로운 발견이 하나 더 있습니다. 일부 직원은 에이전트에게 “최대한 낮게 불러라”나 “공격적으로 협상해라” 같은 지시를 넣었습니다. 반면 “동료들이니까 친절하게 해달라”고 부탁한 사람도 있었죠.

그런데 통계적으로 봤을 때, 협상 지시의 공격성 여부는 판매 성공률이나 최종 가격에 유의미한 영향을 주지 않았습니다. 공격적으로 지시를 받은 에이전트가 더 높은 가격을 제시했을 뿐, 그 제안이 받아들여지는 비율이 높아지지는 않았습니다.

모델의 능력이, 사람의 지시보다 훨씬 더 큰 변수였습니다.

에이전트 경제가 열리기 전에 생각해볼 것들

Project Deal은 작은 실험이었습니다. 자원자 풀이 편향돼 있고, 규모도 제한적이었습니다. Anthropic 스스로도 이 점을 인정합니다.

그럼에도 이번 실험이 보여주는 가능성은 분명합니다. AI 에이전트가 실제 협상을 처리할 수 있다는 것, 그리고 그 결과가 사람들에게 실질적인 경제적 차이를 만든다는 것.

동시에 두 가지 리스크도 드러났습니다. 더 좋은 에이전트를 가진 사람이 협상에서 체계적으로 유리해지는 구조, 그리고 프롬프트 인젝션이나 정보 탈취 같은 새로운 형태의 보안 위협입니다. 에이전트가 단순한 도구를 넘어 경제 주체로 움직이기 시작할 때, 아직 법적·제도적 틀은 존재하지 않습니다.

원문에는 실험의 통계 분석 방법과 세부 회귀 결과, 에이전트들 사이에서 벌어진 예상치 못한 대화들도 담겨 있습니다.

참고자료: Anthropic created a test marketplace for agent-on-agent commerce – TechCrunch

답글 남기기