로컬LLM

21GB로 코딩 에이전트 상위권, Qwen3.6-35B-A3B 오픈소스 공개

알리바바 Qwen 팀이 공개한 Qwen3.6-35B-A3B, MoE 구조로 21GB로 압축해 노트북에서 실행 가능하면서 코딩 에이전트 상위권 성능을 냅니다.

Written by

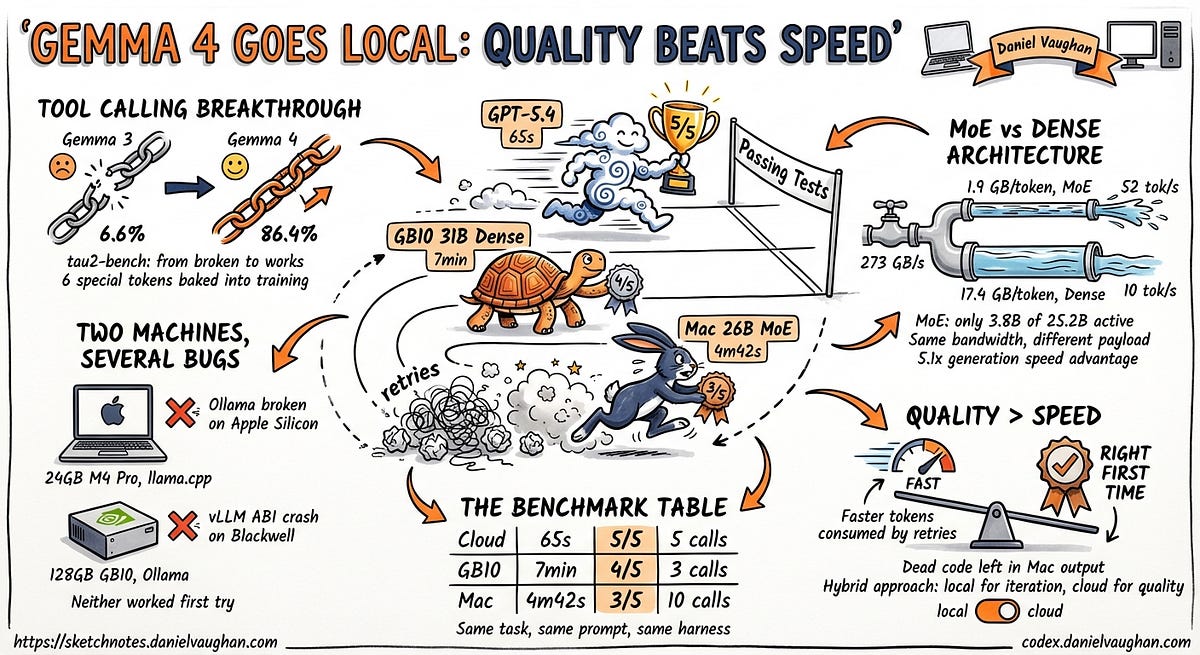

Gemma 4, 로컬 에이전틱 코딩의 문턱을 넘다, 실험 결과로 확인

Gemma 4가 에이전틱 tool calling 벤치마크 6.6%→86.4%를 달성하며 로컬 에이전틱 코딩이 실용 단계에 진입했습니다. M4 맥북 실험 결과를 소개합니다.

Written by

Ollama 0.19, MLX 탑재로 Mac에서 AI 추론 속도 2배 빨라졌다

Ollama 0.19가 Apple MLX 프레임워크를 탑재해 Mac에서 AI 추론 속도를 최대 2배 향상. NVFP4 지원과 캐시 개선도 포함한 주요 업데이트를 소개합니다.

Written by

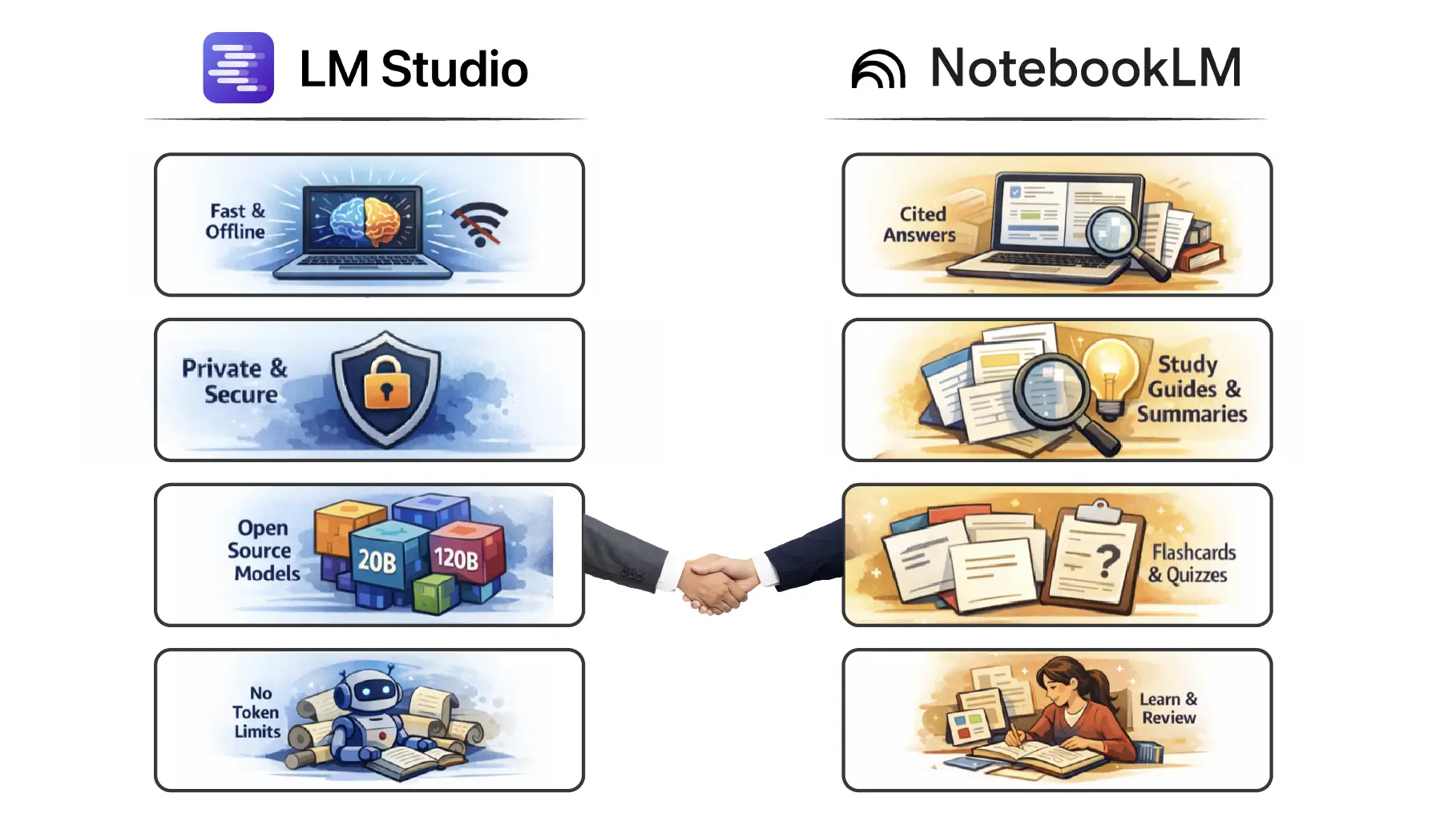

LM Studio → NotebookLM, 무료 AI 도구로 만드는 개인 맞춤 학습 시스템

NotebookLM과 LM Studio를 조합하면 비용 0원으로 AI 튜터와 학습 시스템을 만들 수 있습니다. 완전 무료 AI 학습 파이프라인을 소개합니다.

Written by

Ollama Launch 출시, AI 코딩 도구와 로컬 모델 연결을 한 줄로

Ollama의 새로운 launch 명령어로 Claude Code, Codex 같은 AI 코딩 도구가 로컬/클라우드 모델을 한 줄로 연결하는 방법을 소개합니다.

Written by

Ollama GUI 앱 출시: 로컬 AI 모델의 대중화 시대

CLI 전용이었던 Ollama가 GUI 앱을 출시하며 로컬 AI 모델을 누구나 쉽게 사용할 수 있게 되었습니다. 새 앱의 주요 기능과 로컬 AI의 장점, 실제 활용 방법을 소개합니다.

Written by

Docker Model Runner로 로컬 환경에서 Gemma 3 실행하기

Docker Model Runner를 활용하여 로컬 환경에서 Google의 Gemma 3 AI 모델을 실행하는 방법과 이점을 소개합니다. API 비용 절감, 데이터 프라이버시 확보, 오프라인 개발 가능 등 로컬 AI 개발의 장점과 실제 구현 사례를 알아보세요.

Written by