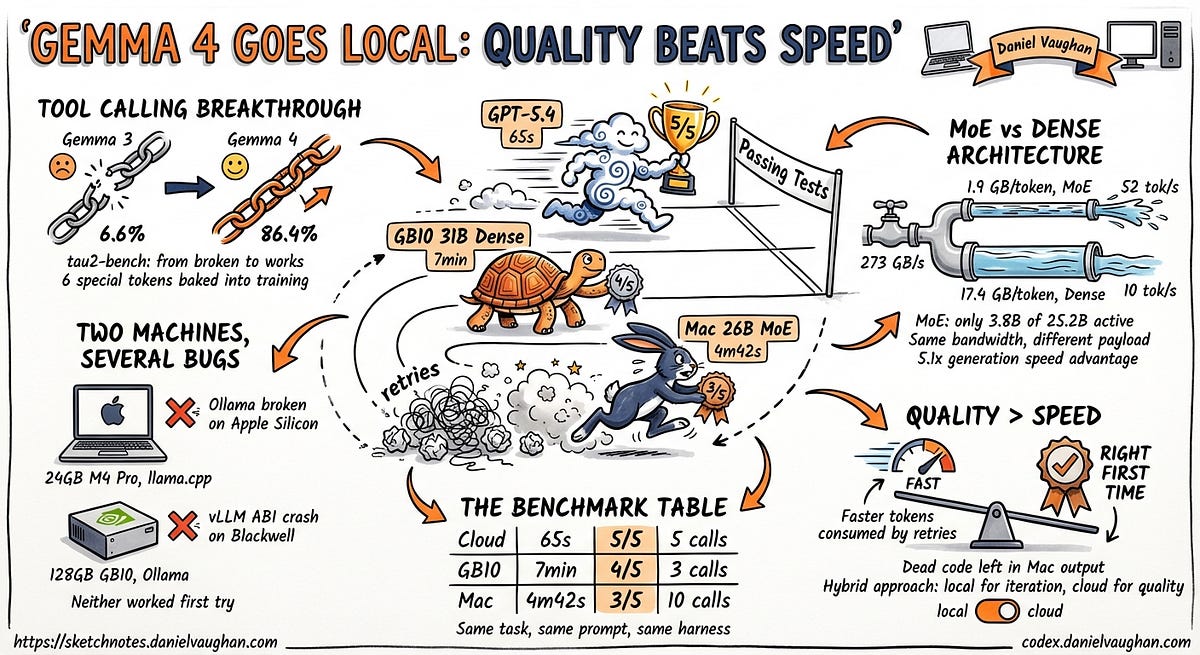

에이전틱 도구 호출 벤치마크에서 Gemma 3이 6.6%를 받았을 때, 로컬 모델로 코딩 에이전트를 돌린다는 건 사실상 불가능에 가까운 얘기였습니다. Gemma 4는 같은 벤치마크에서 86.4%를 기록했습니다.

Google Cloud 엔지니어 Daniel Vaughan이 Gemma 4를 Codex CLI의 로컬 백엔드로 연결해 실제 에이전틱 코딩 작업에 써봤습니다. MacBook Pro M4 Pro(24GB)와 Dell GB10(NVIDIA Blackwell, 약 120GB) 두 환경에서 직접 검증한 결과로, 작동하는 설정과 실패한 경로를 모두 문서화했습니다.

출처: I ran Gemma 4 as a local model in Codex CLI – Daniel Vaughan (Google Cloud Community)

왜 지금까지 로컬 모델은 안 됐나

에이전틱 코딩 도구(Codex CLI, Claude Code 등)가 작동하려면 모델이 단순히 텍스트를 잘 생성하는 것 이상이 필요합니다. 파일을 읽고(Read), 코드를 수정하고(apply_patch), 명령을 실행(Bash)하는 도구를 정확한 형식으로 호출할 수 있어야 하죠. 이 “tool calling” 능력이 로컬 오픈소스 모델에선 오랫동안 병목이었습니다.

Gemma 4 이전까지 대부분의 로컬 모델은 도구 호출을 프롬프트 엔지니어링으로 흉내내는 수준이었습니다. Gemma 4는 다릅니다. <|tool_call>, <|tool_response> 같은 도구 호출 전용 특수 토큰 6개를 사전학습 단계에서 어휘에 직접 내장했습니다. 나중에 얹은 게 아니라, 모델이 처음부터 도구 호출을 ‘언어’로 익힌 셈입니다.

실제로 M4 맥북에서 돌렸을 때

Daniel Vaughan은 MacBook Pro M4 Pro(24GB 통합 메모리)와 Dell GB10(NVIDIA Blackwell, 약 120GB)에서 직접 실험했습니다. 두 환경에서 검증된 작동 조합은 다음과 같습니다.

- 맥(24GB): llama.cpp + Gemma 4 26B MoE 모델(Q4_K_M 양자화, 약 16GB)

- GB10(120GB): Ollama + Gemma 4 31B Dense 모델

맥에서 흥미로운 부분은 속도입니다. MoE(Mixture of Experts) 구조 덕분에 Gemma 4 26B는 토큰 생성 시 전체 파라미터가 아닌 일부(약 3.8B)만 활성화합니다. 실제 메모리 읽기 부담이 훨씬 작아지는 셈이고, 결과적으로 M4 맥이 GB10보다 토큰 생성 속도가 5.1배 빨랐습니다(52 tok/s vs 10 tok/s).

검증 테스트는 단순했습니다. package.json을 읽어서 프로젝트 이름을 알려달라는 명령을 내렸을 때, 모델이 Read 도구를 올바르게 호출하고 파일 내용을 바탕으로 답을 내놓으면 통과. 맥 환경의 6가지 테스트는 모두 통과했습니다.

속도보다 중요한 건 품질

두 환경에서 동일한 코딩 작업(CSV 파싱 함수와 테스트 작성)을 시켰을 때 결과가 흥미롭게 갈렸습니다.

GB10의 31B Dense는 도구 호출 3번으로 처음에 깔끔하게 완성했습니다. 반면 맥의 26B MoE는 토큰 생성은 더 빨랐지만, 도구 호출을 10번 반복하고 테스트 파일을 5번 다시 썼습니다. 변수 이름을 틀리고, 불필요한 코드를 남기는 식이었죠.

실험자의 결론은 명확합니다. “에이전틱 코딩에서는 토큰 생성 속도보다 첫 번째 시도에 성공하는 품질이 더 중요하다.” 빠른 모델이 10번 실패하는 것보다, 느린 모델이 3번에 끝내는 게 낫다는 뜻입니다.

로컬 추론이 갖는 의미

이 실험의 핵심은 대체가 아니라 보완입니다. 실험자 본인도 “로컬 추론은 클라우드 모델의 대체재가 아니라 보완재”라고 결론 내립니다. 빠르고 비용 없이 반복 실험할 때, 코드베이스를 외부 API에 보내기 꺼릴 때, 오프라인 환경에서 작업할 때가 로컬 Gemma 4가 빛나는 순간입니다. 복잡한 리팩터링이나 프로덕션 수준 작업은 여전히 클라우드 모델을 쓰는 게 낫습니다.

Gemma 3이 6.6%였을 때 로컬 에이전틱 코딩은 “가능하지만 실용적이지 않다”의 영역이었습니다. Gemma 4가 86.4%를 찍으면서 그 경계가 움직이기 시작했습니다. 두 하드웨어에서의 구체적인 설정 방법과 실패한 경로(Ollama on Mac, vLLM on GB10 등)는 원문에서 확인할 수 있습니다.

참고자료: Gemma 4 모델 카드 – Google DeepMind

답글 남기기