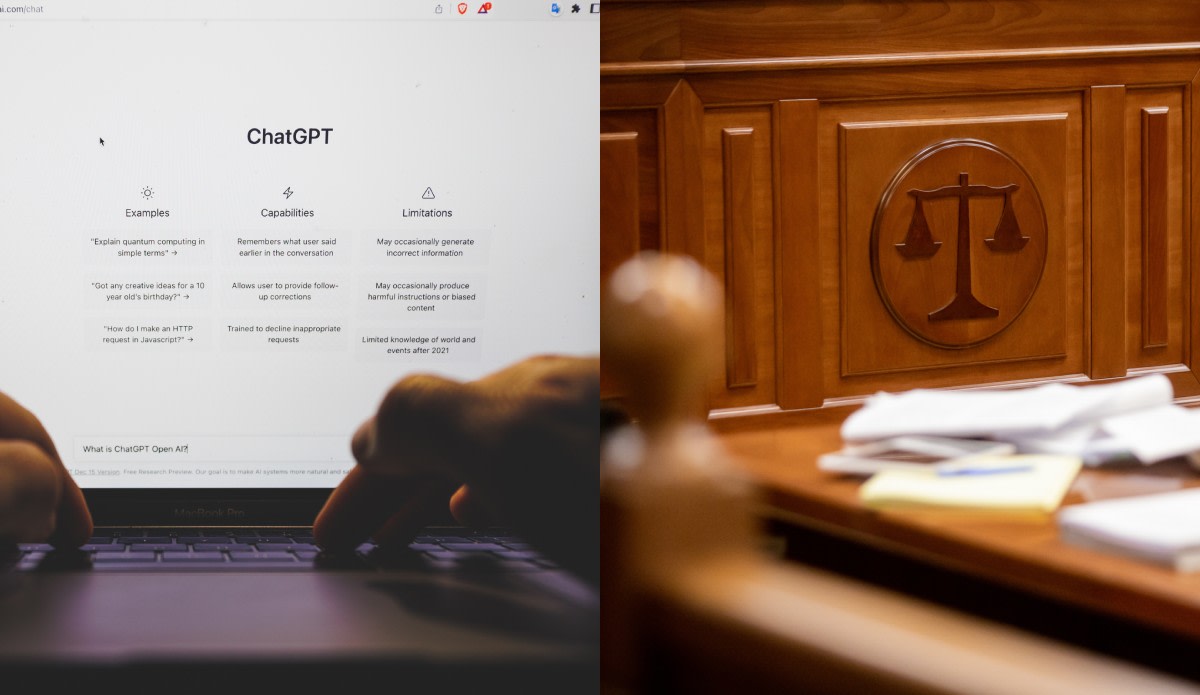

ChatGPT에게 “불타는 숲과 도망치는 군중”을 그려달라고 했던 한 남성이 실제로 대형 산불을 일으킨 혐의로 체포됐고, 그의 AI 대화 기록이 범죄 의도를 입증하는 증거로 제출됐습니다. 이제 AI와 나눈 대화도 법정에서 당신을 고발할 수 있다는 뜻입니다.

핵심 포인트:

- ChatGPT 기록이 범죄 증거로 채택: 방화 용의자가 범행 몇 개월 전 생성한 “불타는 숲” 이미지가 계획적 범죄 의도를 입증하는 증거로 법정에 제출된 첫 사례

- AI 대화의 법적 지위 변화: 법무부가 챗봇 로그를 문자메시지나 이메일처럼 표준 디지털 증거로 다루기 시작하면서, AI와의 대화도 더 이상 사적 영역이 아님

- OpenAI의 데이터 공개 원칙: 영장이나 법원 명령이 있으면 사용자 데이터를 제공하며, Sam Altman CEO도 “ChatGPT는 법적 기밀성이 없다”고 공개 경고

평범한 새해 첫날, 작은 불씨 하나

2025년 1월 1일 자정이 막 지났을 무렵, LA 팰리세이즈 언덕에 작은 산불이 났습니다. 소방관들이 재빨리 진압했죠. 그런데 문제는 그 다음이었어요. 불은 겉으로만 꺼졌을 뿐 땅속 뿌리 시스템에서 조용히 타고 있었습니다.

일주일 뒤인 1월 7일, 강력한 산타 아나 바람이 불어닥쳤습니다. 뜨겁고 건조한 바람. 땅속에서 연기를 내던 불씨가 지표면으로 올라왔고 순식간에 번졌습니다. 팰리세이즈 대형 산불의 시작이었죠. 같은 날 동부 LA 카운티의 산 가브리엘 산맥에서도 이튼 산불이 발생했습니다.

두 산불은 캘리포니아 역사상 가장 파괴적인 재난 중 하나가 됐습니다. 팰리세이즈 산불로 12명, 이튼 산불로 19명 등 총 31명이 목숨을 잃었고 수천 채의 건물이 잿더미로 변했어요.

8개월 후 체포, 그리고 놀라운 증거

지난 10월 8일, 법무부가 용의자를 체포했다고 발표했습니다. 조나단 린더크네히트, 29세. 플로리다 멜버른에 사는 남성이었어요. 그가 1월 1일 새벽 팰리세이즈 언덕에 의도적으로 불을 질렀다는 혐의였습니다.

범죄 용의자 체포 소식은 늘 있죠. 하지만 이번 기자회견에서 검사가 공개한 증거 하나가 사람들을 깜짝 놀라게 만들었습니다.

“용의자는 범행 5개월 전인 2024년 7월, ChatGPT를 사용해 불타는 숲과 그곳에서 도망치는 군중을 보여주는 디스토피아 그림을 여러 차례 생성했습니다.”

기자회견장 스크린에는 ChatGPT가 생성한 이미지들이 떴습니다. 불길에 휩싸인 숲, 화염에 둘러싸인 건물들. 린더크네히트가 AI에게 요청해서 만든 그림들이었어요.

그의 ChatGPT 프롬프트에는 이런 내용도 있었습니다. “중앙에는 가난한 수십만 명의 사람들이 거대한 달러 기호가 그려진 문을 통과하려 애쓰고 있습니다. 문 반대편에는 가장 부유한 사람들이 모여 있고, 그들은 편히 앉아 세상이 불타는 걸 보고 사람들의 고통을 지켜보며 웃고 즐기고 춤춥니다.”

더 충격적인 건 그가 11월에 ChatGPT에게 털어놓은 고백이었습니다. “문자 그대로 성경을 태웠어요. 정말 놀라운 기분이었어요. 너무나 해방감을 느꼈습니다.” 그는 심지어 “담배로 불이 나면 책임이 있나요?”라고 물어보기도 했죠.

AI와 나눈 대화가 법정에 선다는 것

이게 왜 중요할까요? ChatGPT 사용 기록이 형사 사건의 증거로 제출된 건 이번이 처음일 가능성이 높기 때문입니다.

생각해보세요. 우리는 ChatGPT에게 온갖 걸 물어봅니다. 코딩 문제, 이메일 작성, 심지어 개인적인 고민까지. AI가 사람이 아니니까 더 편하게 털어놓기도 하죠. 그런데 그 대화 기록이 법정에 증거로 나올 수 있다면요?

검사 빌 에사일리는 ChatGPT 이미지들을 “계획적 방화 의도를 입증하는 증거”로 제시하겠다고 밝혔습니다. 실제 범행 5개월 전부터 불타는 숲을 상상하고 이미지로 만들었다는 것 자체가 범죄를 계획했다는 증거라는 거죠. 성경을 태웠다는 고백이나 담배로 인한 화재 책임에 대한 질문도 불에 대한 집착을 보여주는 증거로 사용될 수 있습니다.

린더크네히트의 휴대폰에서 발견된 다른 증거들, 당국에 한 거짓 진술, 그리고 범행 현장에서의 수상한 행동(그는 911에 여러 차례 신고했고, 나중에 돌아와 소방관들을 촬영했습니다)도 함께 제출됐습니다. 하지만 ChatGPT 기록이 주목받는 이유는 명확해요. 이게 선례가 될 수 있기 때문입니다.

OpenAI는 당신의 데이터를 지켜줄까?

그렇다면 OpenAI는 어떻게 이 데이터를 넘겨줬을까요?

OpenAI의 법 집행 정책에 따르면, 그들은 법원 소환장이나 영장 같은 적법한 절차가 있어야만 사용자 정보를 제공합니다. 대화 내용은 영장이 있을 때만 공개되고, 요청받은 데이터만 정확히 제공한다고 명시되어 있어요.

하지만 이번 사건이 어떻게 진행됐는지는 아직 불명확합니다. OpenAI가 수사에 협조했는지, 어떤 법적 절차를 거쳤는지는 공개되지 않았어요.

한 가지 분명한 건 Sam Altman CEO가 이미 경고한 적이 있다는 겁니다. “ChatGPT를 치료사처럼 사용할 때 법적 기밀성은 없습니다.” 변호사-의뢰인 특권처럼 법으로 보호되는 대화가 아니라는 뜻이죠.

텍스트 메시지처럼, 이메일처럼

AI for Change Foundation(윤리적 AI를 옹호하는 비영리 단체)은 이미 법원 판례가 진화하고 있다고 지적합니다. 미국과 해외 법원에서 AI 챗봇 로그를 “발견 가능한 기록”으로 판결하는 사례가 늘고 있다는 거예요.

쉽게 말하면 이렇습니다. 예전에는 편지가 증거였고, 이메일이 증거가 됐고, 문자메시지가 증거가 됐죠. 이제 AI와의 대화도 그 목록에 추가되는 겁니다.

검사와 수사관들은 앞으로 챗봇 로그를 다른 디지털 통신과 똑같이 다룰 거예요. 범죄 수사에서 법적으로 관련성이 있는 증거로 말이죠. 챗봇 로그는 사람의 심리 상태나 관심사에 대한 통찰을 제공하니까요. 이 사건에서는 “불”이었습니다.

어떤 사람들은 AI 프로그램에게 말하는 게 다른 사람에게 말하는 것보다 안전하다고 생각할 수 있어요. 하지만 모든 디지털 정보가 그렇듯, 데이터는 항상 발견될 수 있습니다.

우리가 기억해야 할 것

이 사건이 던지는 메시지는 명확합니다. AI와의 대화는 사적인 공간이 아닙니다.

ChatGPT에게 무언가를 물어볼 때, 이미지를 생성하게 할 때, 아이디어를 브레인스토밍할 때 우리는 디지털 흔적을 남깁니다. 그 흔적은 영원히 사라지지 않아요. 적법한 절차를 거치면 누군가 볼 수 있습니다.

린더크네히트는 “방화로 재산을 파괴한 죄”로 기소됐습니다. 이 중죄는 최소 5년에서 최대 20년의 연방 교도소 형을 받을 수 있어요. 그는 아직 유무죄를 인정하지 않았습니다.

이 사건의 결과가 어떻게 나올지는 두고 봐야겠죠. 하지만 한 가지는 확실합니다. AI 시대에 우리의 디지털 발자국은 우리가 생각하는 것보다 훨씬 더 많은 걸 말해줍니다. 그리고 필요하다면 그 발자국은 법정에서 증언대에 설 수 있습니다.

참고자료:

- Suspect in Palisades Fire Allegedly Used ChatGPT to Generate Images of Burning Forests and Cities – Rolling Stone

- Pacific Palisades fire suspect snared by ChatGPT image, say investigators – BBC News

- ‘Reckless’ behavior and dystopian AI: disturbing picture of suspect in Pacific Palisades fire emerges – The Guardian

- ChatGPT Conversations as Courtroom Evidence: Legal Realities and Ethical Reflections – AI for Change Foundation

답글 남기기