DeepSeek

DeepSeek V4 출시, 1M 컨텍스트를 에이전트가 실제로 쓸 수 있게 만든 방법

DeepSeek V4가 1M 토큰 컨텍스트를 실용적으로 만든 방법. CSA·HCA 하이브리드 어텐션으로 KV 캐시를 90% 줄이고 에이전트 추론 흐름을 개선했습니다.

Written by

TurboQuant에 “Pied Piper”라는 별명이 붙은 이유, 그리고 그 비교가 과장인 이유

구글 TurboQuant 발표에 업계가 ‘Pied Piper’, ‘DeepSeek 모멘트’라 반응한 이유와 그 비교가 과장인 이유를 분석합니다.

Written by

a16z AI Top 100, ChatGPT 독주 속 3개 블록으로 갈라진 시장

a16z가 발표한 AI 소비자 제품 Top 100 6번째 에디션 분석. ChatGPT 독주 속 경쟁자 급성장, 3개 지정학적 블록 분화, 에이전트 신흥 카테고리 부상을 정리합니다.

Written by

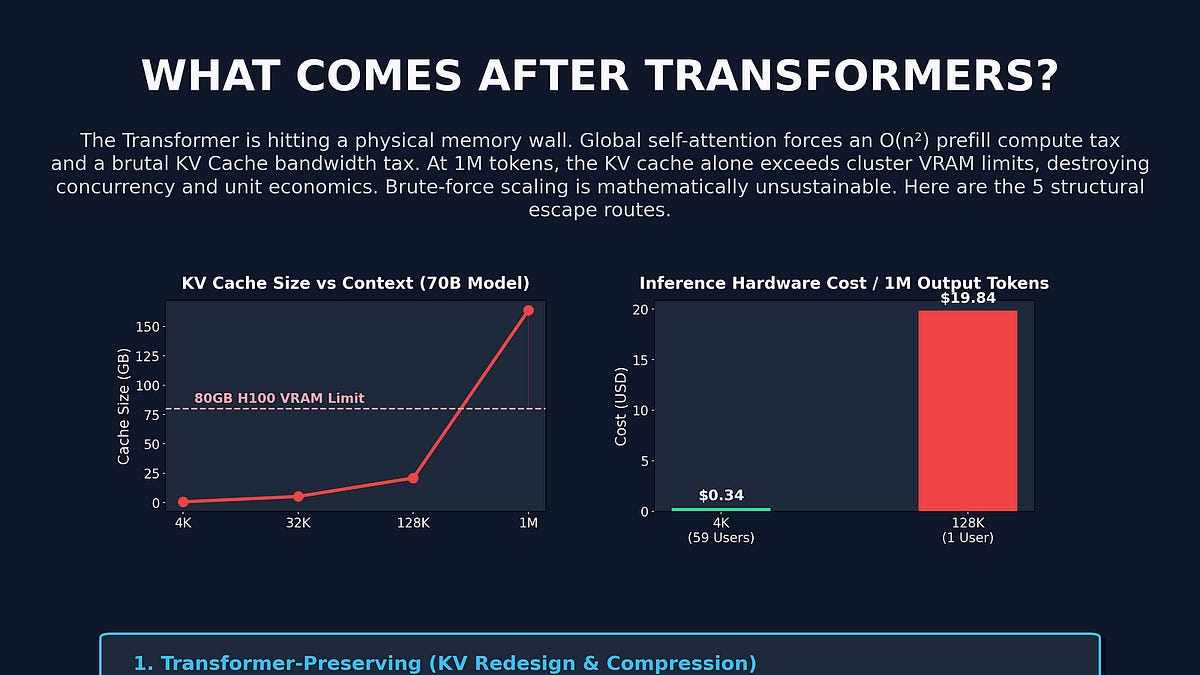

긴 컨텍스트 LLM의 숨겨진 함정, H100 동시 사용자 59명이 1명이 되는 이유

128K 컨텍스트 하나로 H100 동시 사용자가 59명에서 1명이 되는 이유. KV 캐시 압축·Mamba·하이브리드 등 5가지 탈출 전략의 트레이드오프를 비용 수치와 함께 분석합니다.

Written by

DeepSeek·MiniMax의 Claude 1600만 쿼리 추출, Anthropic이 밝힌 AI 증류 공격의 실체

Anthropic이 중국 AI 3사의 Claude 무단 증류를 공식 고발했습니다. 1,600만 건 데이터 추출의 실체와 업계의 “위선” 논란까지 정리했습니다.

Written by

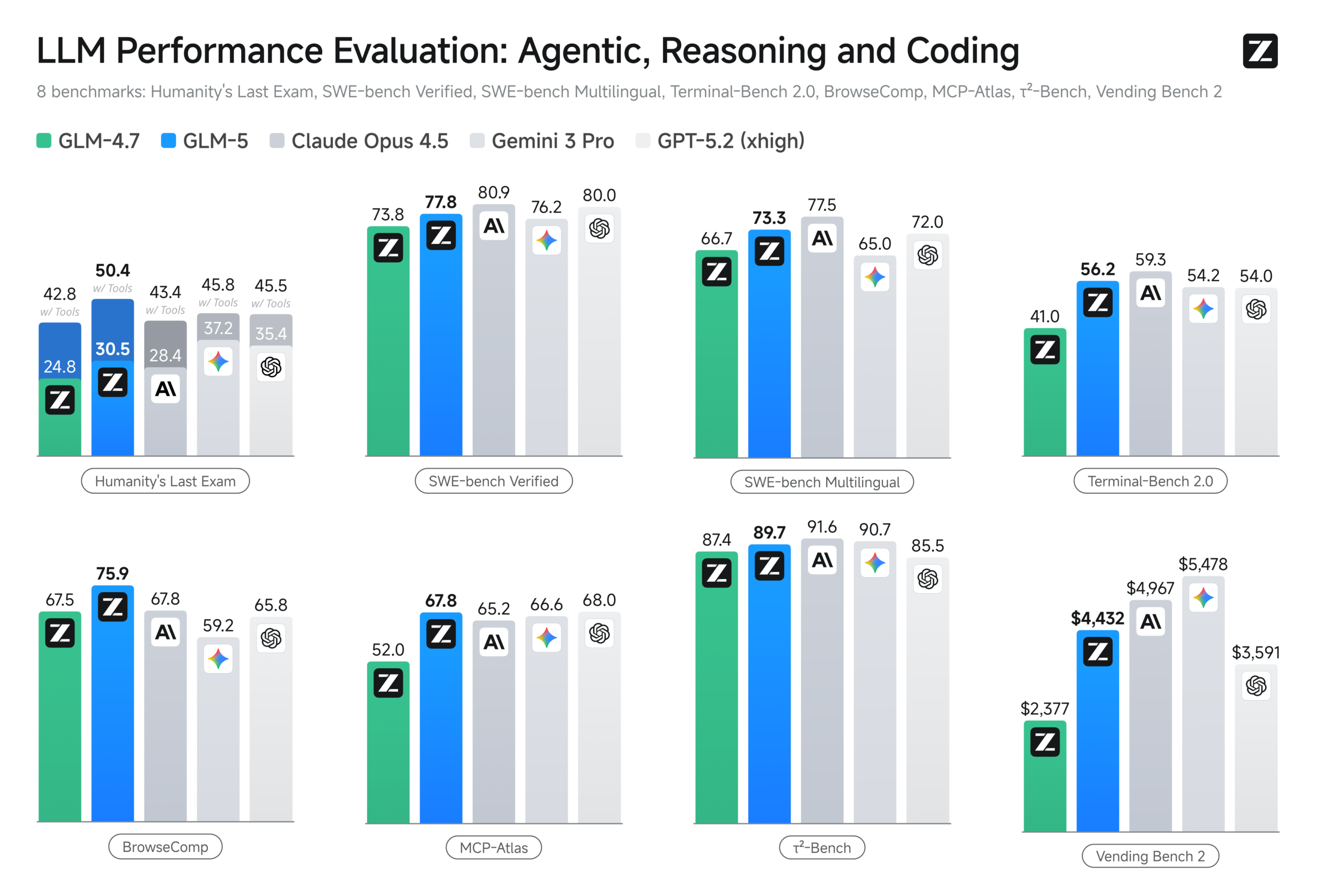

GLM-5 등장, 744B 파라미터 오픈소스 모델이 에이전트 벤치마크 1위

Z.ai가 744B 파라미터 오픈소스 모델 GLM-5를 공개했습니다. DeepSeek 기술을 통합해 에이전트 작업에 특화된 성능을 보여줍니다.

Written by

DeepSeek OCR 2, 비주얼 토큰 80% 줄이고 Gemini 3 Pro 능가

DeepSeek OCR 2가 비주얼 토큰을 80% 줄이면서도 Gemini 3 Pro를 능가한 비결. 의미 기반 이미지 재배열로 문서 AI의 새 지평을 엽니다.

Written by

중국 정부가 만든 3,739개 AI 지도, DeepSeek은 우연이 아니었다

중국 정부의 AI 알고리즘 등록 시스템이 공개한 3,739개 AI 도구 데이터. DeepSeek은 우연이 아니라 치열한 국내 경쟁의 결과였습니다.

Written by

LLM 쿼리 하나에 전기 얼마나 쓸까, DeepSeek부터 GPT까지 에너지 실측

LLM 쿼리 하나에 실제로 얼마나 전기가 쓰일까? DeepSeek R1부터 GPT-OSS-120B까지 오픈소스 벤치마크 데이터로 실측한 에너지 비용과 벤치마크의 함정을 분석합니다.

Written by

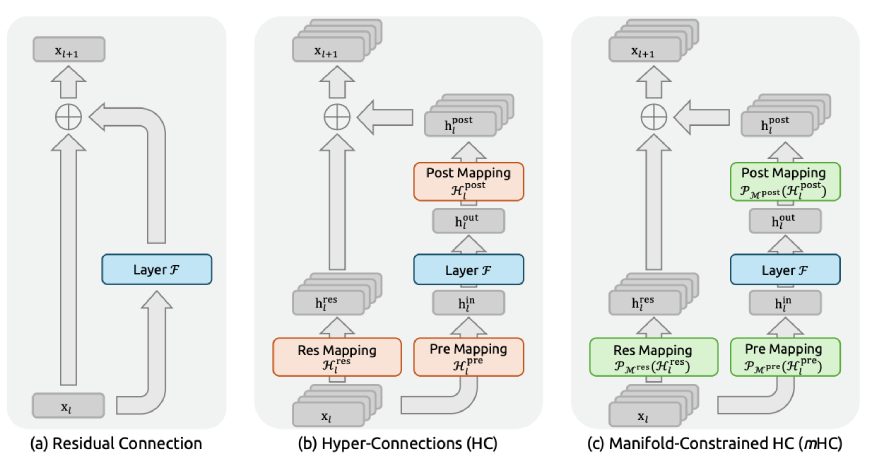

DeepSeek, AI 학습 불안정성을 3000배→1.6배로 잡다: mHC 아키텍처의 비밀

DeepSeek의 mHC 아키텍처가 대규모 AI 모델 학습의 불안정성 문제를 어떻게 해결했는지 소개합니다. 신호 증폭 3000배→1.6배 개선으로 안정성과 성능을 동시에 확보한 비결을 설명합니다.

Written by