MCP를 Claude에서만 쓸 수 있다고 생각하셨나요? 이제 오픈소스 LLM으로도 강력한 AI 에이전트를 만들 수 있습니다.

Hugging Face의 Vaibhav Seshadri가 MCP(Model Context Protocol)와 OpenAI의 오픈소스 모델 gpt-oss를 결합해 AI 에이전트를 만드는 실전 튜토리얼을 공개했습니다. MCP는 원래 Anthropic이 개발한 표준 프로토콜이지만, 이제 어떤 LLM으로도 외부 도구와 데이터를 연결할 수 있다는 걸 보여주는 사례죠.

출처: Building Smart Agents with MCP and OpenAI gpt-oss – GitHub

gpt-oss: OpenAI가 만든 오픈소스 추론 모델

gpt-oss는 OpenAI가 최근 공개한 오픈소스 추론 모델입니다. 120B 버전과 20B 버전 두 가지가 있는데, 놀라운 건 성능입니다. 120B 모델은 OpenAI의 유료 모델인 o4-mini와 거의 비슷한 수준의 추론 능력을 보여주면서도, 단일 H100 GPU(80GB)에서 돌아갑니다. 20B 모델은 더 작아서 16GB 메모리만 있으면 실행 가능하죠.

이 모델들은 단순한 텍스트 생성을 넘어 도구 사용(tool use), 웹 검색, 파이썬 코드 실행 같은 에이전트 기능에 최적화되어 있습니다. 특히 추론 수준을 low/medium/high로 조절할 수 있어서, 복잡한 문제는 깊게 생각하고 간단한 질문은 빠르게 답하는 식으로 활용할 수 있습니다.

Tiny Agents로 간단하게 시작하기

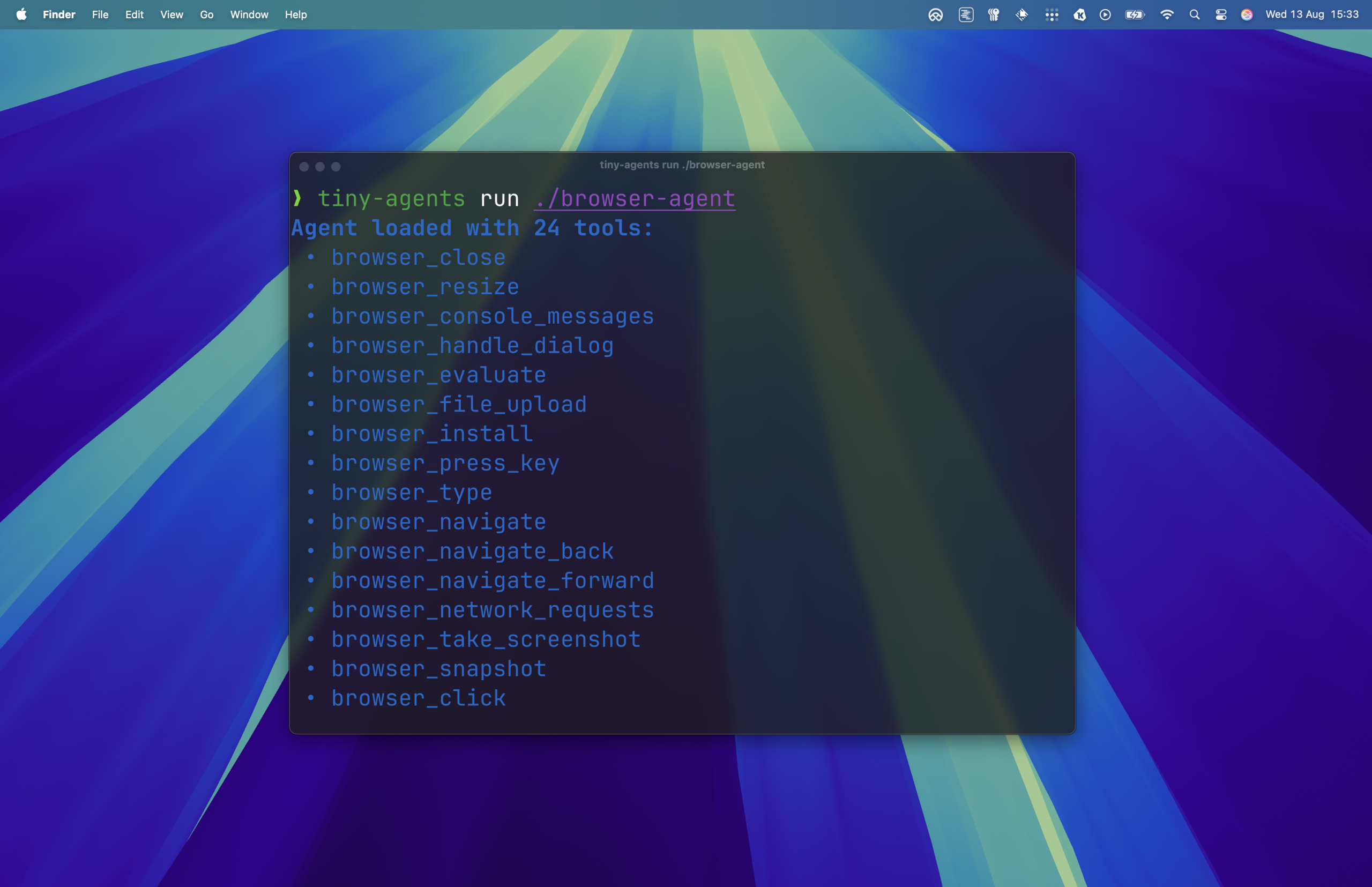

Hugging Face는 MCP를 쉽게 사용할 수 있는 경량 클라이언트를 제공합니다. TypeScript용 @huggingface/tiny-agents와 Python용 huggingface_hub[mcp]인데, 설정이 정말 간단합니다.

에이전트 설정은 JSON 파일 하나로 끝납니다. 어떤 모델을 쓸지, 어떤 도구에 접근할지만 명시하면 됩니다. 예를 들어 웹 브라우징 에이전트를 만들려면 Microsoft의 Playwright MCP 서버를 연결하고, gpt-oss-120b 모델을 지정하는 식이죠.

{

"model": "openai/gpt-oss-120b",

"provider": "fireworks-ai",

"servers": [

{

"type": "stdio",

"command": "npx",

"args": ["@playwright/mcp@latest"]

}

]

}Python으로는 pip install -U "huggingface_hub[mcp]>=0.32.0"만 설치하면 바로 실행할 수 있습니다. 명령어 한 줄이면 끝이에요.

tiny-agents run ./browser-agent이제 채팅창에서 “Hugging Face에서 인기 있는 모델 10개를 찾아줘”라고 하면, 에이전트가 알아서 웹사이트에 접속해 정보를 수집해옵니다.

Hugging Face MCP 서버로 확장하기

더 재미있는 건 Hugging Face의 MCP 서버입니다. 이걸 연결하면 1000개가 넘는 AI 모델과 공간(Spaces)을 도구로 사용할 수 있습니다. 이미지 생성 모델 FLUX나 비디오 생성 모델 LTX-Video 같은 걸 에이전트가 직접 호출해서 작업을 처리하는 거죠.

설정 방법은 비슷합니다. agent.json에 Hugging Face MCP 서버 URL을 추가하고, 본인의 Hugging Face 토큰으로 인증하면 됩니다.

{

"model": "openai/gpt-oss-120b",

"provider": "fireworks-ai",

"servers": [

{

"type": "http",

"url": "https://huggingface.co/mcp",

"headers": {

"Authorization": "Bearer ${input:hf-token}"

}

}

]

}“해변 풍경 이미지를 만들어줘”라고 하면, 에이전트가 FLUX 모델을 찾아 이미지를 생성하고, “이걸 비디오로 만들어줘”라고 하면 LTX-Video를 실행해 짧은 영상을 만들어냅니다. 모든 게 자동으로 연결되는 거죠.

오픈소스가 여는 가능성

이 튜토리얼의 의미는 명확합니다. MCP라는 표준 프로토콜 덕분에, 이제 어떤 LLM으로도 강력한 AI 에이전트를 만들 수 있다는 겁니다. Claude나 GPT 같은 유료 API에 의존할 필요 없이, 오픈소스 모델로도 충분히 실용적인 에이전트를 구축할 수 있죠.

특히 gpt-oss는 Apache 2.0 라이선스로 공개되어 있어서 상업적으로도 자유롭게 사용할 수 있습니다. 자체 인프라에서 돌리면 데이터 프라이버시도 완벽하게 통제할 수 있고요. 비용 측면에서도 API 호출료 대신 GPU 비용만 내면 되니 대규모 서비스에서는 훨씬 경제적일 수 있습니다.

물론 한계도 있습니다. GPT-4o나 Claude Sonnet 같은 최신 상용 모델에 비하면 성능이 떨어지는 건 사실이에요. 멀티모달 기능도 없습니다. 하지만 많은 실무 작업에서는 이 정도 성능이면 충분하고, 무엇보다 커스터마이징이 자유롭다는 게 큰 장점입니다.

Hugging Face 생태계와의 결합은 더욱 흥미롭습니다. 수천 개의 오픈소스 모델과 도구를 자유롭게 조합할 수 있으니, 특정 도메인에 특화된 에이전트를 만들기에 이상적이죠. 의료, 법률, 금융 같은 전문 분야에서 자체 AI 시스템을 구축하려는 조직에게는 특히 유용할 겁니다.

참고자료:

답글 남기기