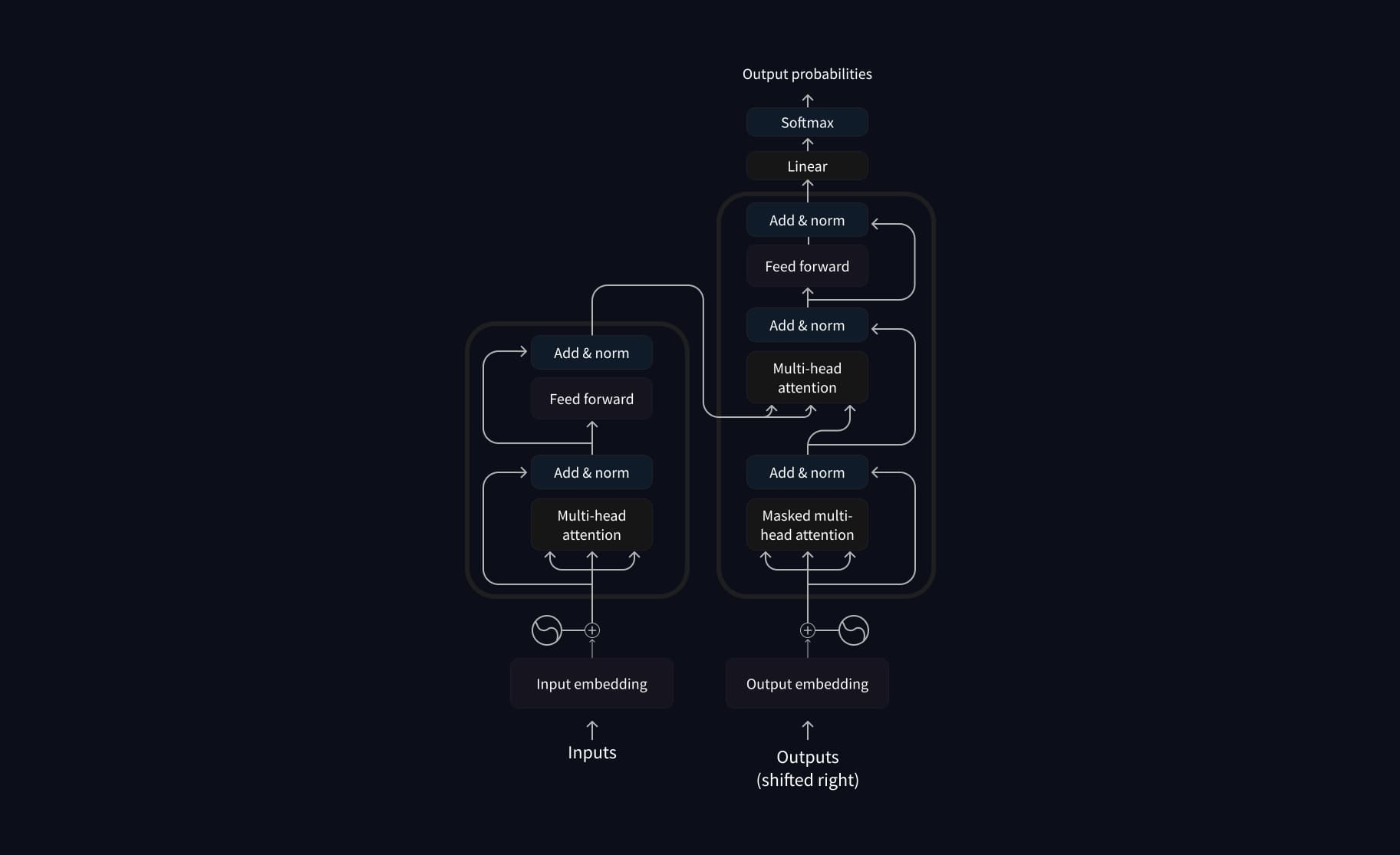

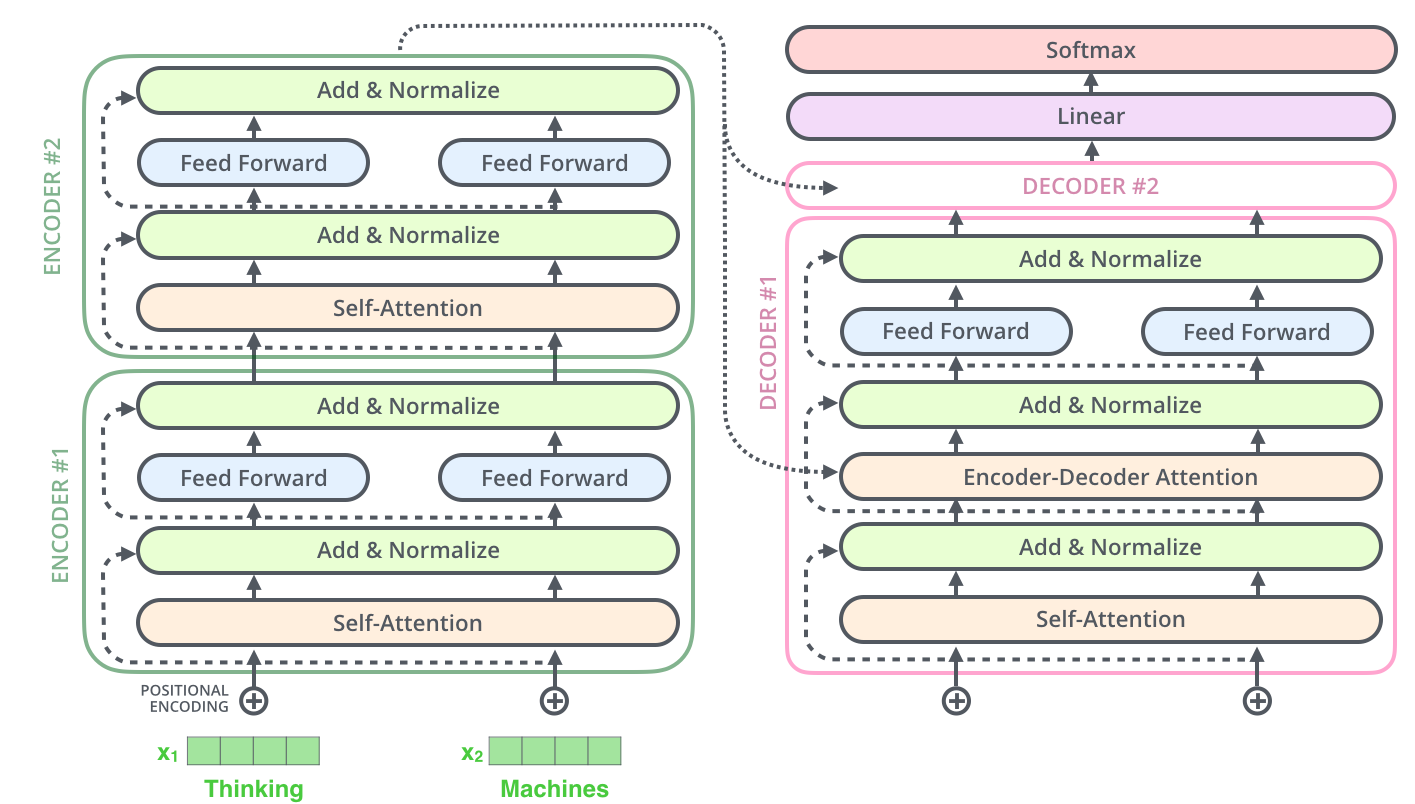

트랜스포머

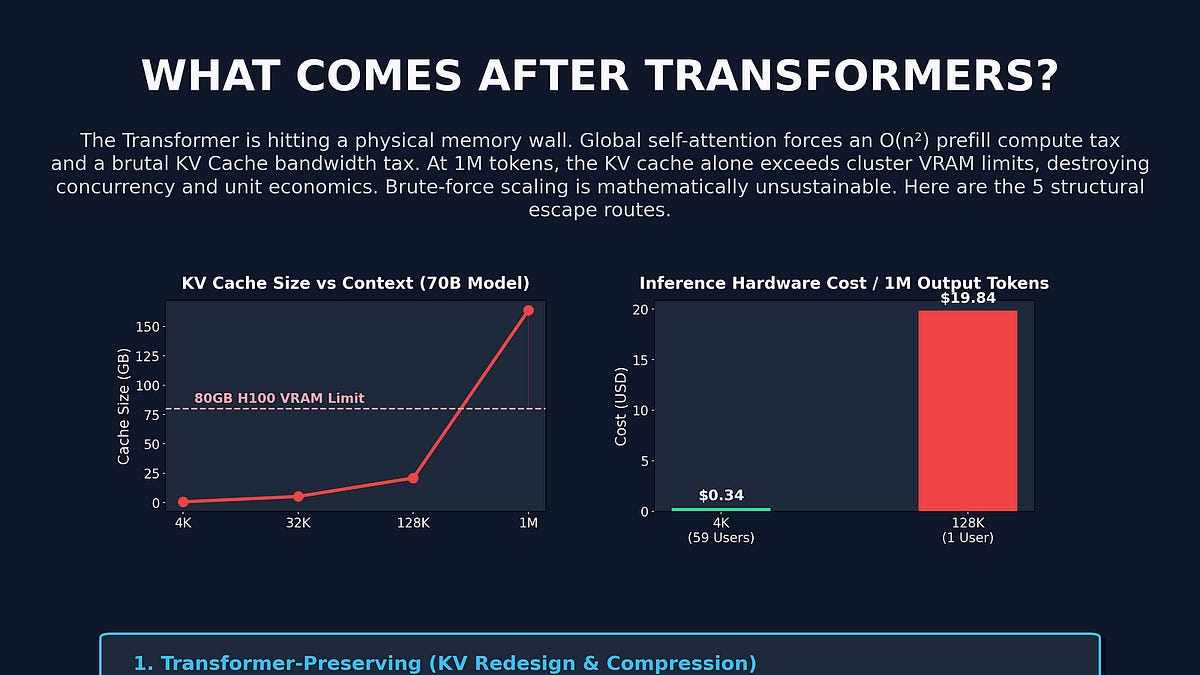

긴 컨텍스트 LLM의 숨겨진 함정, H100 동시 사용자 59명이 1명이 되는 이유

128K 컨텍스트 하나로 H100 동시 사용자가 59명에서 1명이 되는 이유. KV 캐시 압축·Mamba·하이브리드 등 5가지 탈출 전략의 트레이드오프를 비용 수치와 함께 분석합니다.

Written by

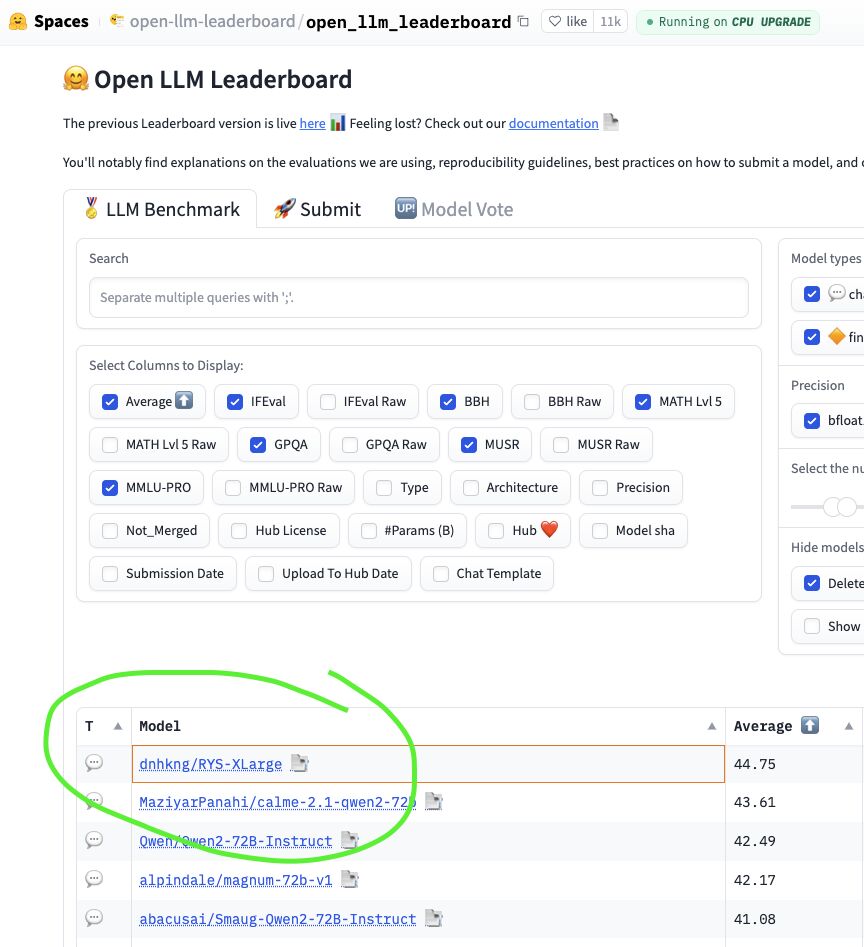

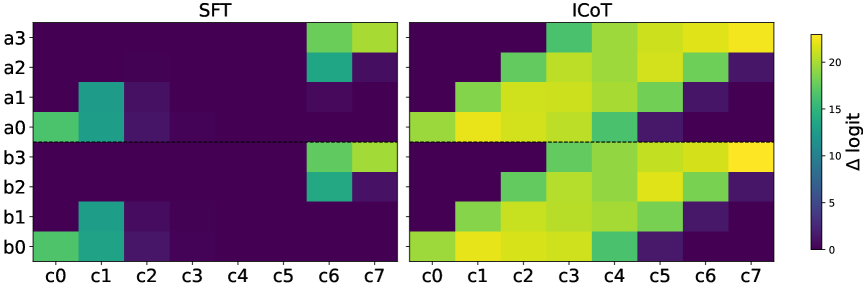

Qwen2-72B 중간 레이어 7개 복제로 리더보드 1위, 가중치는 단 하나도 안 건드리고

가중치 수정 없이 레이어 복제만으로 LLM 리더보드 1위를 달성한 실험. 트랜스포머 내부의 기능적 ‘회로’ 구조를 발견한 LLM Neuroanatomy 이론을 소개합니다.

Written by

GPT가 곱셈을 못하는 진짜 이유: 트랜스포머의 숨겨진 약점

GPT-4도 4×4 곱셈에서 95% 이상 실패하는 이유를 하버드와 MIT 연구진이 밝혔습니다. 트랜스포머의 장거리 의존성 학습 한계와 실무 적용 가능한 해결책을 소개합니다.

Written by

트랜스포머 창시자의 고백: AI 혁신을 막는 건 기술이 아니라 돈

트랜스포머 아키텍처 공동 창시자 Llion Jones가 자신의 창작물을 떠나는 이유. AI 업계의 과도한 투자와 경쟁이 오히려 창의적 연구를 막고 있다는 내부자의 솔직한 고백과, 다음 AI 혁신을 위해 필요한 것.

Written by

BERT는 텍스트 디퓨전 모델이었다: RoBERTa로 30분 만에 만든 생성 AI

BERT의 마스크 언어 모델링이 사실 디퓨전 모델의 한 형태였다는 발견과, RoBERTa를 30분 학습으로 텍스트 생성 모델로 전환한 실험을 소개합니다.

Written by

OpenAI gpt-oss: GPT-2에서 오픈소스 추론 모델까지의 기술 진화 여정

OpenAI의 첫 오픈소스 추론 모델 gpt-oss의 기술적 혁신과 활용 방법을 GPT-2와 비교 분석하여 소개하는 실용 가이드

Written by

AI 시대의 콘텐츠 전략: 인간과 AI가 정보를 처리하는 놀라운 공통점

인간과 AI가 콘텐츠를 처리하는 방식의 과학적 공통점을 분석하고, AI 시대에 맞는 새로운 콘텐츠 전략 GEO(Generative Engine Optimization)의 핵심 원칙과 실전 가이드를 제시합니다.

Written by

AI 발전의 진짜 동력은 새로운 아이디어가 아닌 새로운 데이터

AI 발전의 진정한 동력이 새로운 알고리즘이 아닌 새로운 데이터셋에 있다는 관점을 소개합니다. 지난 15년간 AI의 4대 패러다임 전환을 분석하고, 다음 AI 혁신이 어디서 나올지 전망합니다.

Written by

트랜스포머 모델은 어떻게 문맥을 이해할까? N-gram 통계로 살펴보는 LLM의 작동 원리

트랜스포머 기반 언어 모델이 문맥을 어떻게 이해하고 활용하는지 N-gram 통계를 통해 분석한 최신 연구를 소개합니다. 모델이 다음 토큰을 예측할 때 사용하는 통계적 규칙과 학습 과정에서 나타나는 커리큘럼 학습, 과적합 감지 방법 등 흥미로운 발견을 알아봅니다.

Written by

트랜스포머 모델의 텍스트 생성 파라미터 완전 가이드

트랜스포머 모델에서 텍스트 생성의 품질을 결정짓는 핵심 파라미터인 Temperature, Top-K, Top-P, Repetition Penalty 등을 상세히 설명하고, 다양한 응용 분야별 최적 설정과 실제 코드 예제를 통해 활용법을 안내하는 실용 가이드입니다.

Written by