LLM

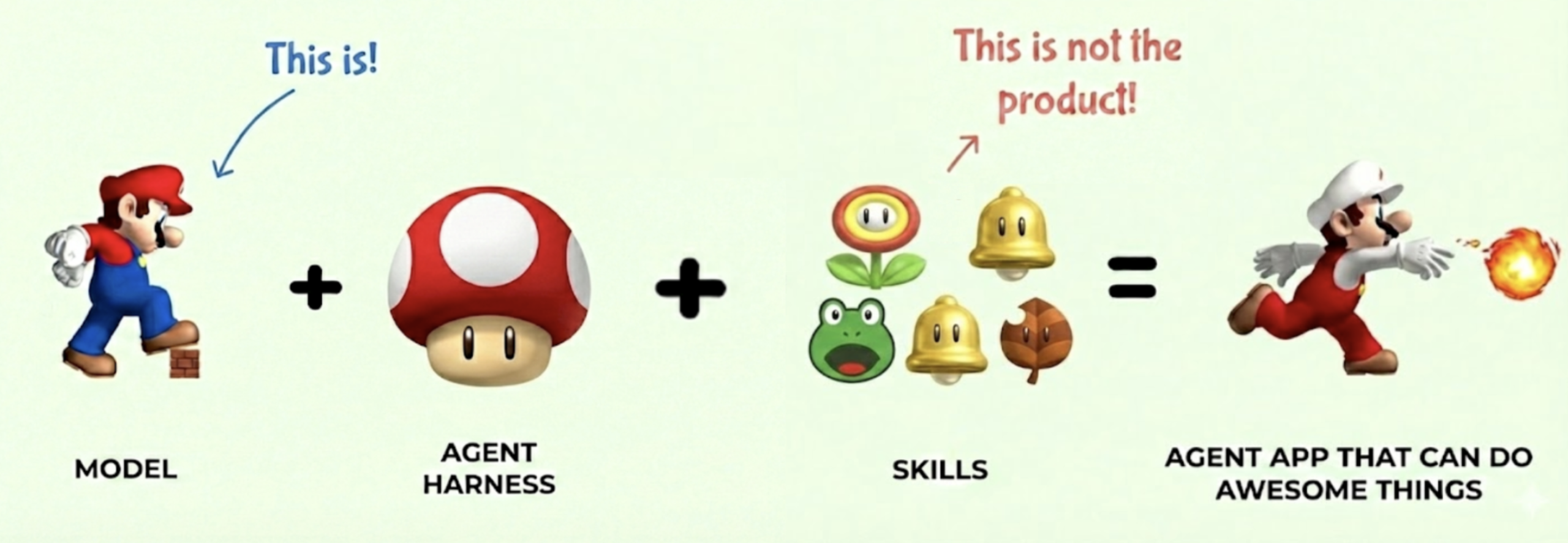

마리오로 이해하는 에이전틱 AI, 슈퍼버섯부터 강화학습까지

마리오 게임 비유로 에이전틱 AI의 기반 모델, 모델 하네스, 도구, 강화학습을 쉽게 설명합니다. ML 엔지니어 Han Lee의 원문 큐레이션.

Written by

멀티턴 대화에서 LLM 정확도 33% 하락, GPT-5도 예외 없었다

GPT-5 포함 최신 LLM도 대화가 길어지면 정확도가 33% 하락한다는 연구. 원인과 패턴을 분석합니다.

Written by

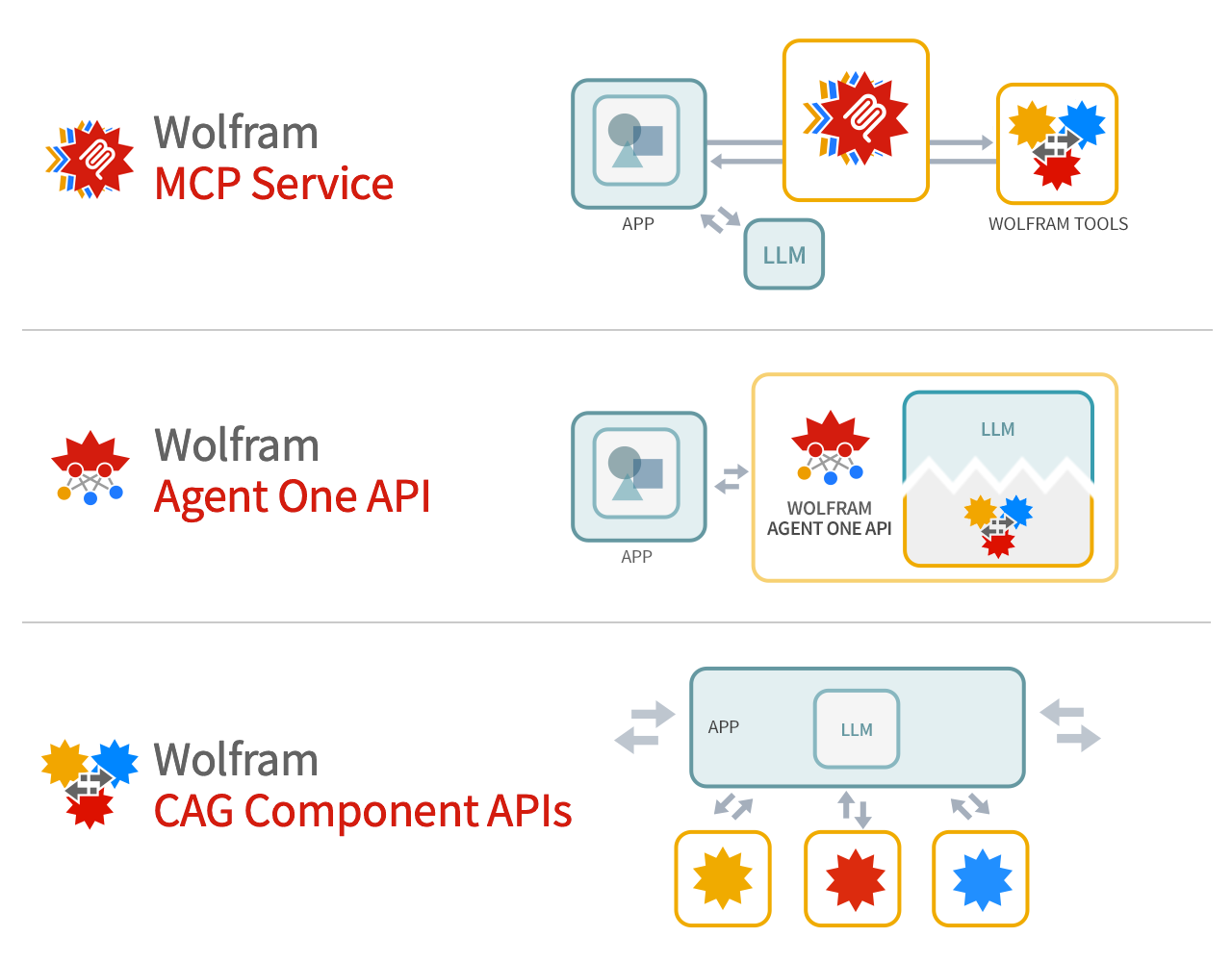

Wolfram, LLM 정밀 계산 한계 보완하는 Foundation Tool 공식 출시

Wolfram이 LLM의 정밀 계산 한계를 보완하는 Foundation Tool을 공식 출시. CAG 기술로 실시간 계산 결과를 LLM 응답에 주입하는 새로운 방식을 소개합니다.

Written by

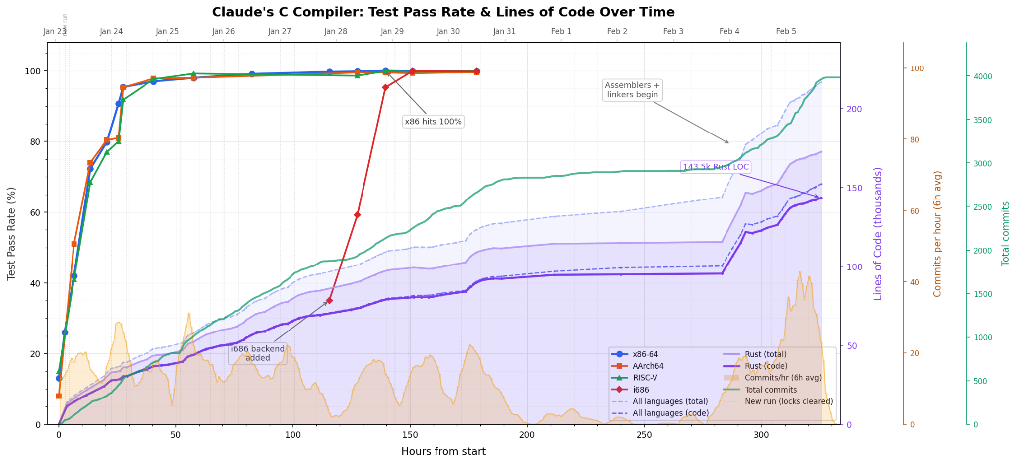

Claude 에이전트 16개가 C 컴파일러를 만들었다, 그리고 드러낸 것들

Anthropic이 Claude 에이전트 16개로 C 컴파일러를 만든 실험. 무엇을 해냈고, 어디서 한계가 드러났는지 — AI 코딩의 현재 위치를 보여주는 $20,000짜리 사례입니다.

Written by

Claude는 캐릭터다, Anthropic이 밝힌 AI 어시스턴트의 페르소나 작동 원리

Anthropic이 제안한 페르소나 선택 모델(PSM) 소개. LLM이 학습을 통해 어시스턴트 캐릭터를 형성하는 원리와 AI 개발에 주는 시사점을 다룹니다.

Written by

MCP 컨텍스트 문제 99.9% 해결한 Cloudflare의 Code Mode

Cloudflare가 공개한 Code Mode MCP 서버. search()와 execute() 두 도구만으로 2,500개 API를 1,000 토큰에 커버, 기존 대비 99.9% 절감한 접근법을 소개합니다.

Written by

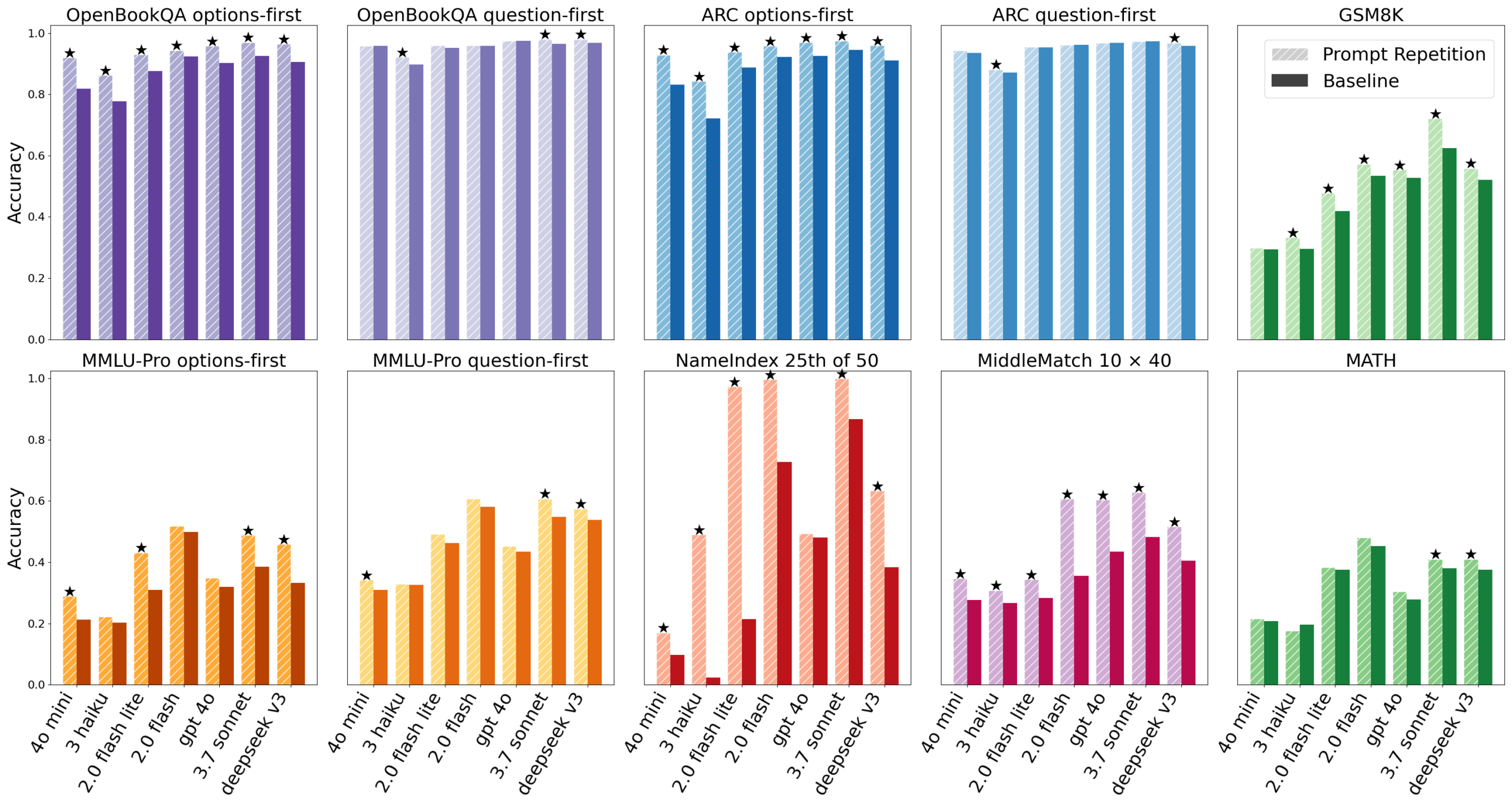

프롬프트 두 번 붙여넣기로 LLM 정확도 높이는 방법, Google 연구 결과

Google Research가 발견한 프롬프트 반복 기법. LLM에 같은 프롬프트를 두 번 입력하면 비용·지연 증가 없이 정확도가 오릅니다.

Written by

Qwen3.5, 397B MoE 아키텍처로 네이티브 멀티모달 에이전트 시대 열다

Alibaba가 공개한 Qwen3.5는 397B 파라미터 MoE 모델로, 추론 시 17B만 활성화해 비용을 낮추고 네이티브 멀티모달과 에이전트 특화 훈련을 결합했습니다.

Written by

AI 테스트 전부 통과, 버그는 그대로였다, Ground Truth 문제

AI가 작성한 테스트가 모두 통과해도 버그가 남아있는 이유. Ground Truth 문제와 AST 비교 방식으로 해결한 Doodledapp 팀의 실전 경험을 소개합니다.

Written by

AI가 글을 다듬을수록 사라지는 것들, ‘시멘틱 어블레이션’

AI가 글을 다듬을수록 독창성과 정보 밀도가 사라지는 현상, ‘시멘틱 어블레이션’ 개념과 그 작동 원리를 소개합니다.

Written by