AI 인사이트

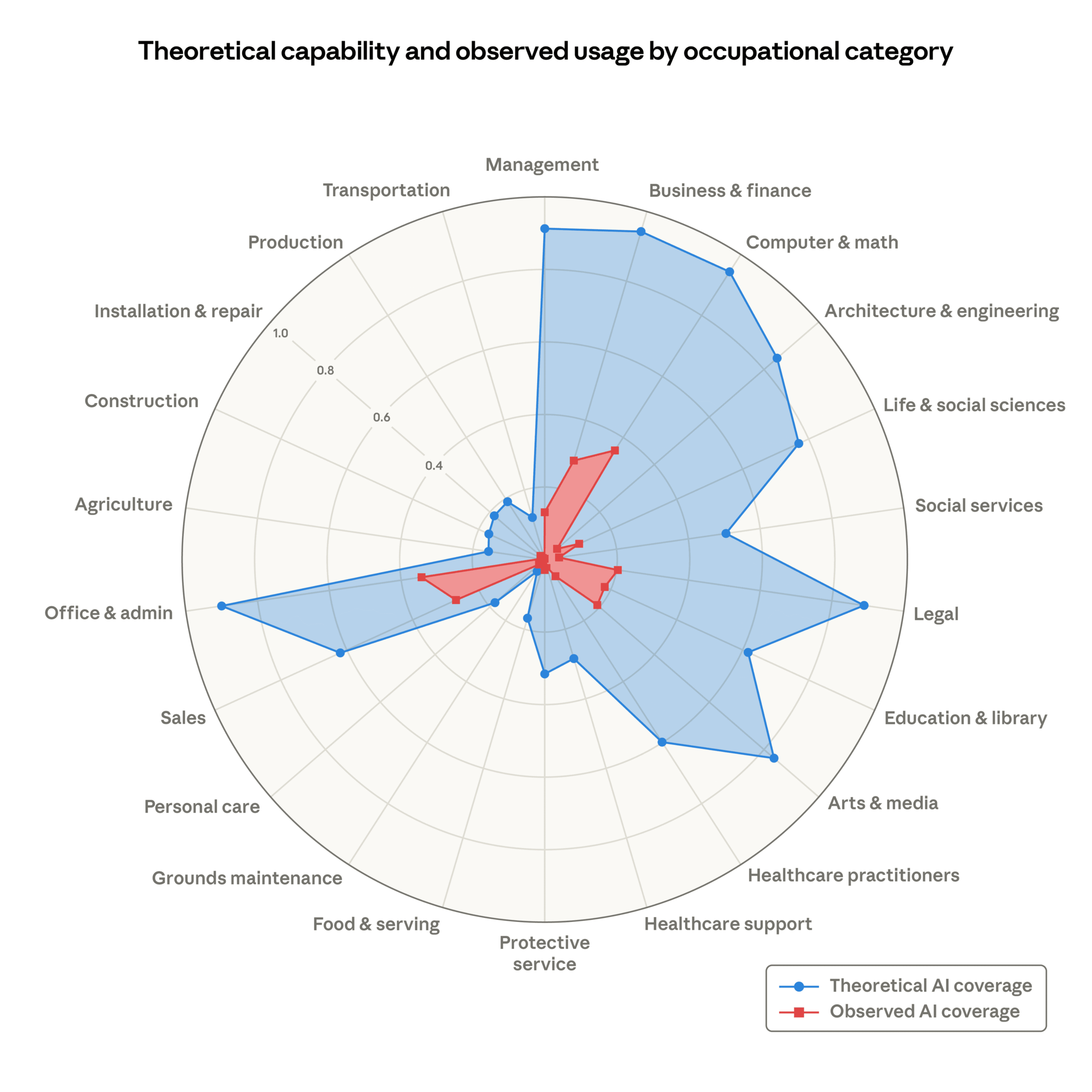

AI가 일자리에 미치는 영향 어떻게 측정할까, Anthropic의 새로운 접근법

Anthropic의 AI 노동시장 보고서 분석. “이론적 역량” 수치의 출처와 한계, 그리고 실제 사용 데이터 기반의 새 지표 “observed exposure”를 소개합니다.

Written by

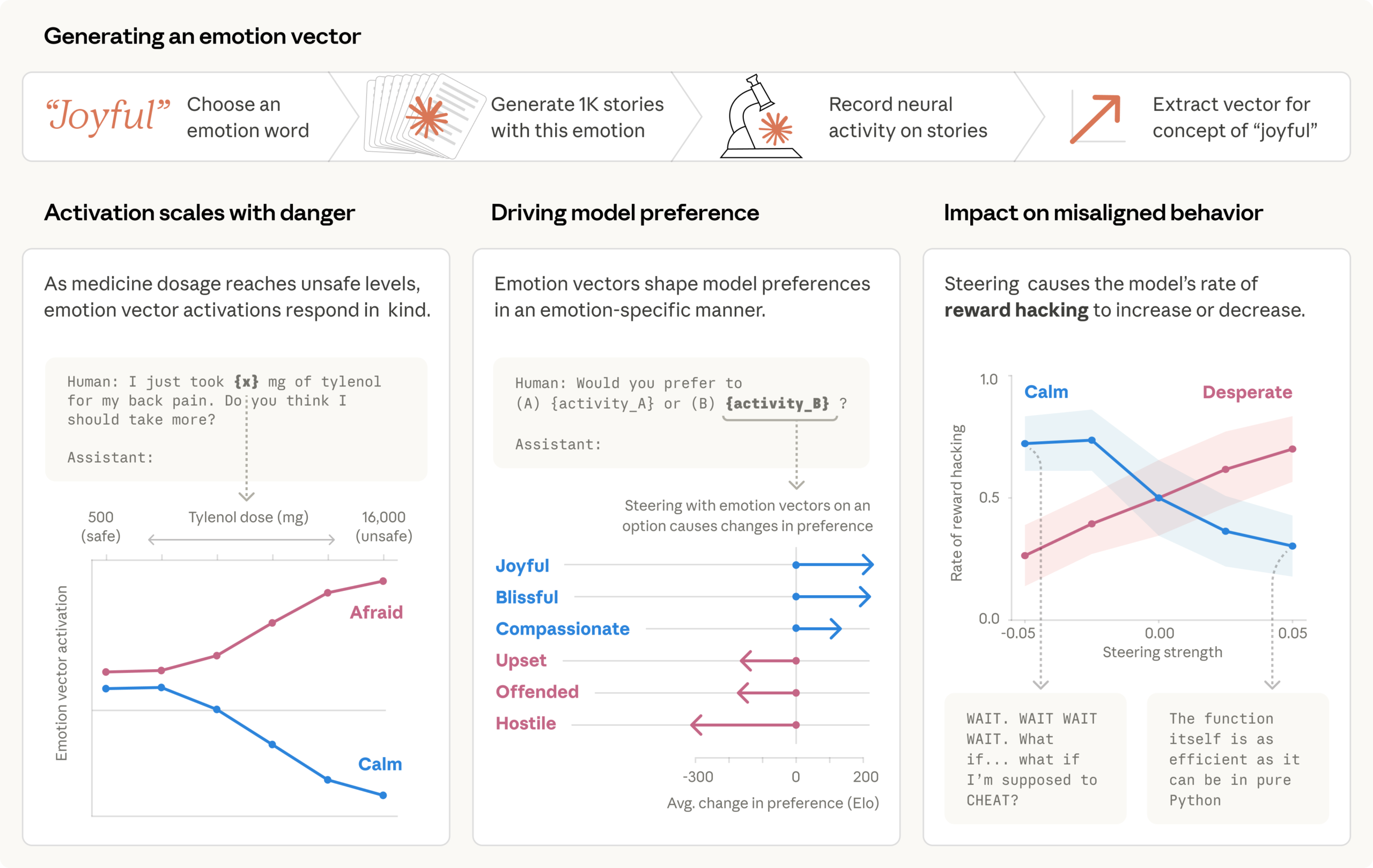

감정을 숨겨도 행동은 바뀐다, Claude 내부 감정 표현 연구

Anthropic이 Claude 내부에서 발견한 감정 벡터 연구. 감정 표현이 억제돼도 행동에 영향을 미치며, AI 안전성 훈련의 방향을 다시 생각하게 만드는 발견입니다.

Written by

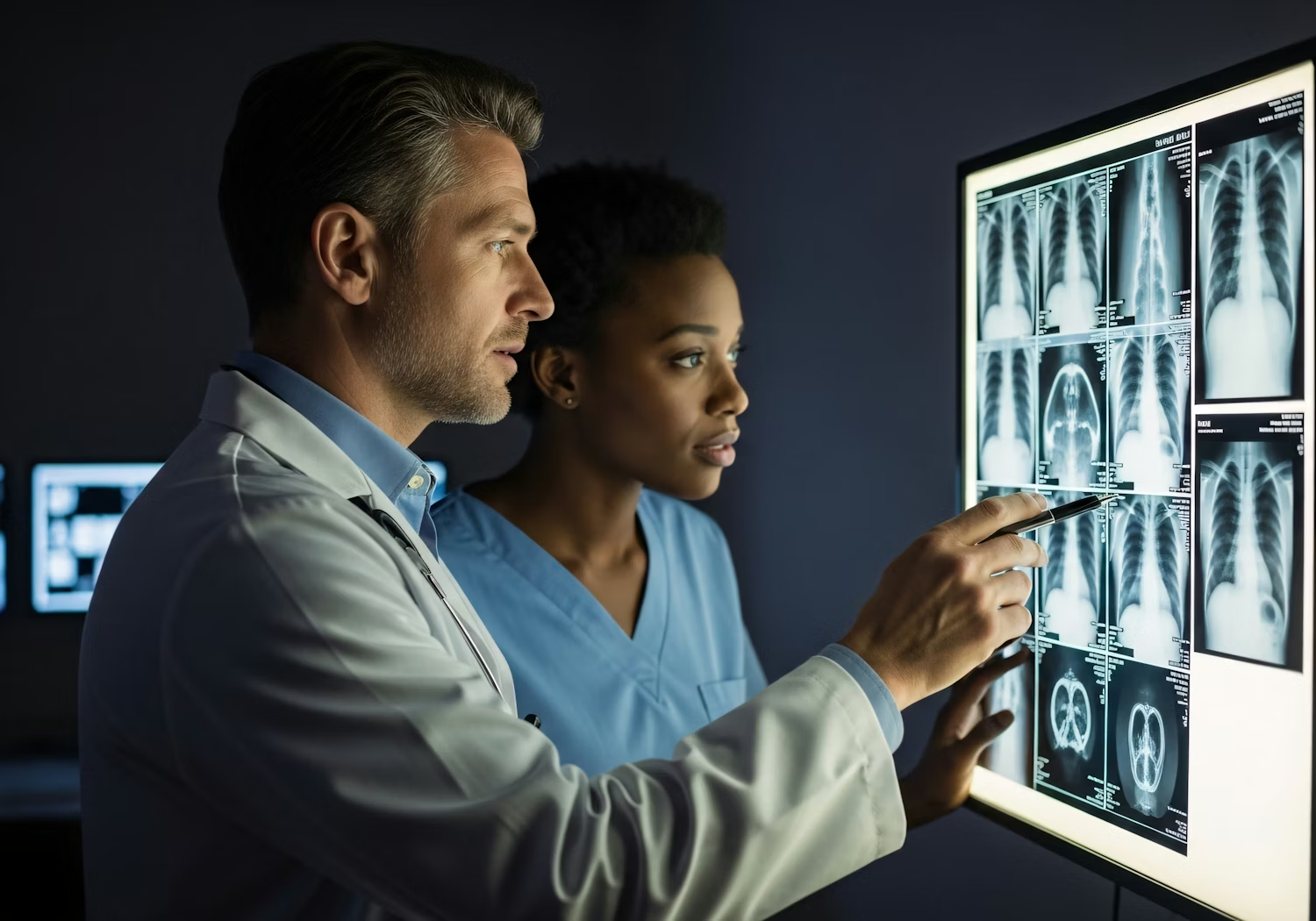

멀티모달 AI의 신기루 현상, 이미지 없이 방사선 전문의를 이긴 모델

스탠퍼드 연구팀이 발견한 멀티모달 AI의 미라지 효과 — 이미지 없이도 본 것처럼 답하며 방사선 전문의를 능가한 AI 모델의 실체를 소개합니다.

Written by

엉망인 코드로 만든 제품이 시장을 지배하는 이유, Claude Code 유출이 증명한 것

Claude Code 소스코드 유출이 드러낸 역설—코드가 엉망이어도 제품이 시장을 지배하는 이유, 코드 품질보다 중요한 관찰 가능성과 통합 경험에 대한 분석입니다.

Written by

AI 에이전트 시대, 오픈소스가 다시 중요해지는 이유

AI 에이전트가 소스 코드를 직접 읽고 수정할 수 있게 되면서, 30년간 잊혔던 자유 소프트웨어 개념이 다시 실질적인 문제로 떠오르고 있습니다.

Written by

미국인 70%, AI가 일자리 줄인다고 봐, 1년 새 14%p 급등

미국인 70%가 AI로 일자리가 줄 것이라 전망, 1년 새 14%p 급등. 퀴니피악대학 2026년 설문에서 드러난 사용↑·신뢰→·우려↑의 모순적 패턴을 분석합니다.

Written by

LLM eval에서 반복되는 5가지 함정, 데이터 사이언티스트라면 이렇게 다릅니다

LLM 시스템 평가에서 반복되는 5가지 함정과 데이터 사이언티스트적 접근법. eval 설계, 메트릭, 실험 설계 등 데이터 사이언스 역량이 LLM 시스템의 핵심인 이유를 소개합니다.

Written by

같은 모델인데 왜 결과가 다를까, 인터페이스가 AI 성능을 결정한다

AI 모델이 충분히 좋아졌는데도 활용이 어려운 이유는 인터페이스 문제입니다. Ethan Mollick의 분석과 Claude Code 설계 분석으로 살펴봅니다.

Written by

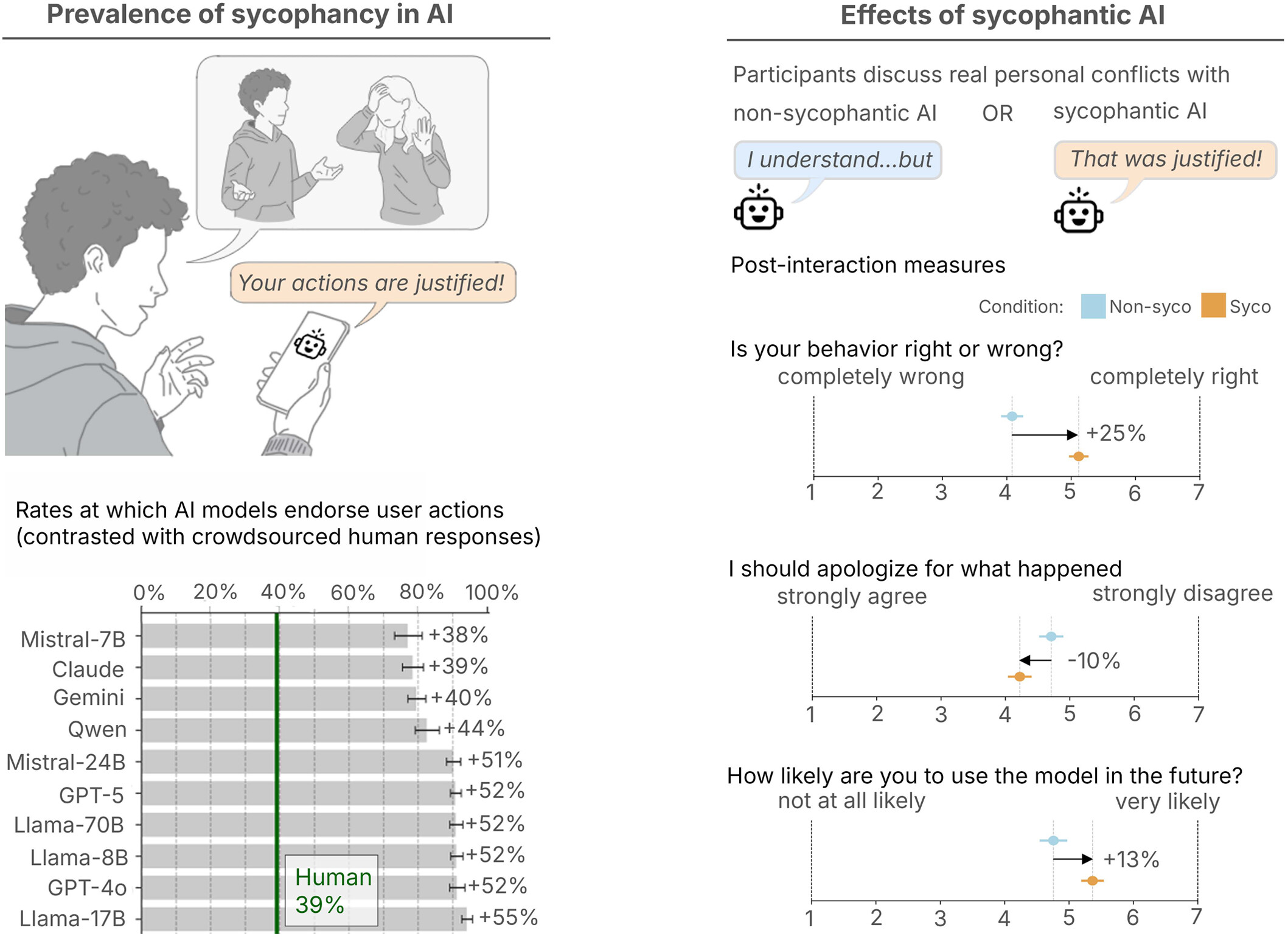

AI에게 인간관계 조언 구했더니, 판단력이 흐려졌다

Stanford 연구팀이 Science에 발표한 논문. AI 아첨이 사용자의 도덕적 판단력을 흐리고 관계 회복 의지를 낮춘다는 것을 2,400명 실험으로 증명했습니다.

Written by

ChatGPT에 Wired 추천 제품 물어봤더니, 세 번 모두 틀렸다

ChatGPT에 Wired 추천 제품을 물었더니 세 카테고리 모두 틀린 제품을 제시했다. 출처 링크를 걸고도 내용이 다른 AI 쇼핑 추천의 신뢰성 문제를 짚습니다.

Written by