LLM최적화

LLM이 내 사이트를 못 읽는다면, Claude는 나를 추천하지 않는다

Claude가 실제로 사이트를 추천한 경험에서 출발한 Evil Martians의 실전 분석. LLM이 웹페이지를 읽는 원리와 효과 있는 기법 6가지, 근거 없는 기법 8가지를 서버 로그 데이터와 함께 정리합니다.

Written by

AI 검색에서 멘션과 인용은 다르다, GEO 전략의 핵심 차이

AI 검색에서 브랜드 멘션과 인용은 다르게 작동합니다. Airbnb 실측 데이터로 보는 GEO 전략의 핵심 차이를 정리했습니다.

Written by

AI 에이전트가 토큰을 낭비하는 이유, 코드로 생각하게 만드는 해법

AI 에이전트가 파일을 읽을수록 컨텍스트가 망가지는 구조적 이유와, Cloudflare와 독립 개발자가 각자 도달한 같은 해법을 소개합니다.

Written by

SEO 1위인데 ChatGPT에 없다, AI 검색이 제품 페이지를 평가하는 방식

AI 크롤러는 JS를 못 읽는다. 구글 1위 제품 페이지가 ChatGPT에 없는 이유와 AI가 제품 페이지를 평가하는 기준을 분석합니다.

Written by

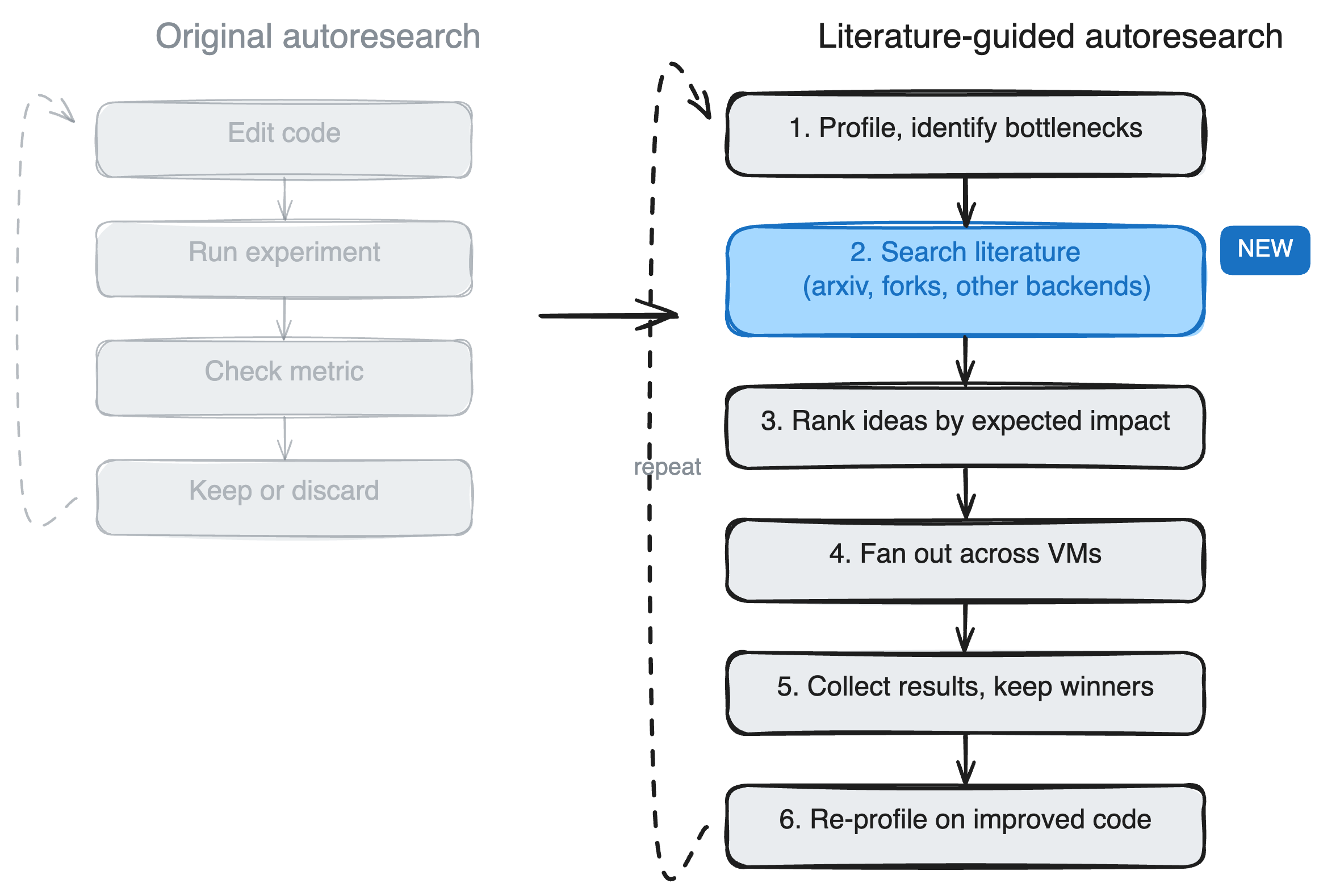

코드만 읽는 에이전트가 놓친 것, 논문을 읽은 에이전트가 찾아냈다

에이전트가 코드만 보고 실험하면 왜 얕은 결과가 나오는지, 논문과 경쟁 프로젝트를 먼저 읽게 했을 때 어떤 최적화가 가능한지 SkyPilot의 실험 사례로 소개합니다.

Written by

Sonnet이 막히면 Opus가 나선다, Anthropic의 어드바이저 전략

Anthropic이 공개한 어드바이저 전략 — Sonnet이 작업을 주도하고 막히면 Opus가 조언하는 구조로, 성능은 높이고 비용은 낮추는 에이전트 설계 패턴을 소개합니다.

Written by

AI 메모리 병목을 3비트로 해결, 구글 TurboQuant 8배 속도 달성한 방법

구글 리서치가 발표한 TurboQuant는 LLM의 KV 캐시를 3.5비트로 압축하면서 정확도 손실 없이 최대 8배 빠른 처리 속도를 달성한 벡터 양자화 알고리즘입니다.

Written by

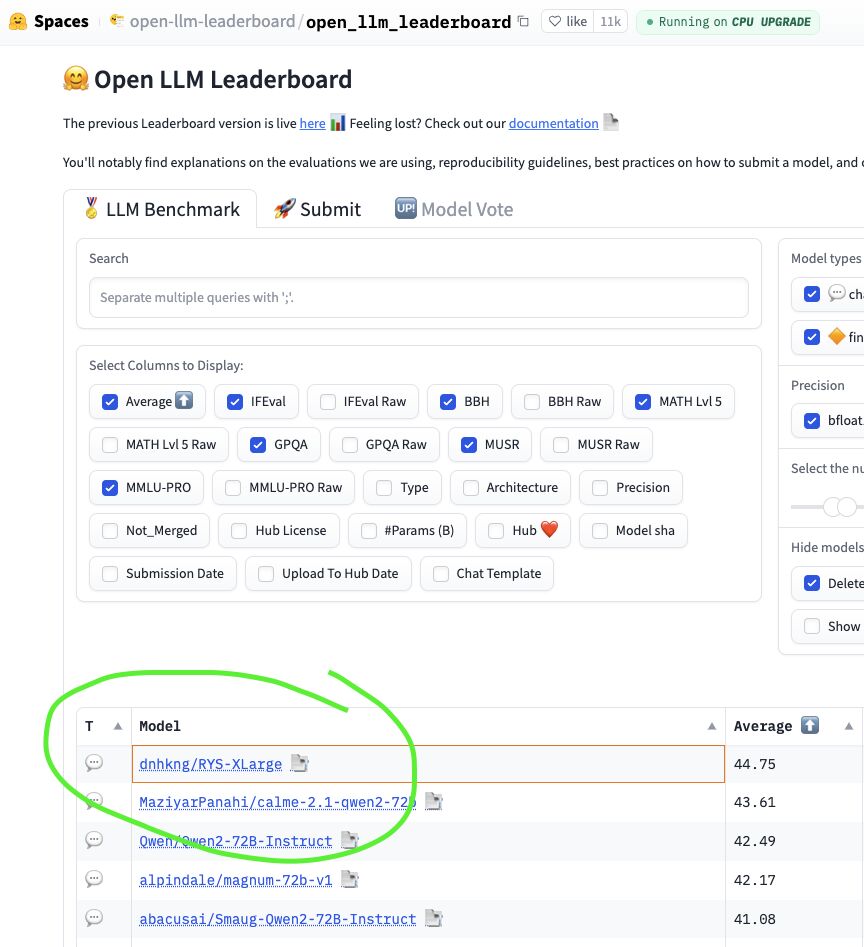

Qwen2-72B 중간 레이어 7개 복제로 리더보드 1위, 가중치는 단 하나도 안 건드리고

가중치 수정 없이 레이어 복제만으로 LLM 리더보드 1위를 달성한 실험. 트랜스포머 내부의 기능적 ‘회로’ 구조를 발견한 LLM Neuroanatomy 이론을 소개합니다.

Written by

AGENTS.md에서 /init을 쓰지 말아야 하는 이유, 연구가 말해주는 것

/init으로 자동 생성한 AGENTS.md가 AI 에이전트 성능을 낮추고 비용을 20% 이상 올린다는 2026년 연구 분석. 무엇이 컨텍스트 파일에 들어갈 자격이 있는지 실증 데이터로 설명합니다.

Written by

AI 에이전트 파일 처리 성공률 33%→95%, 파일 네이티브 접근법의 발견

AI 에이전트의 파일 처리 성공률을 33%에서 95%로 높인 파일 네이티브 접근법. 텍스트 변환 대신 메타데이터 중심 컨텍스트 설계로 구조 정보를 보존합니다.

Written by