RAG

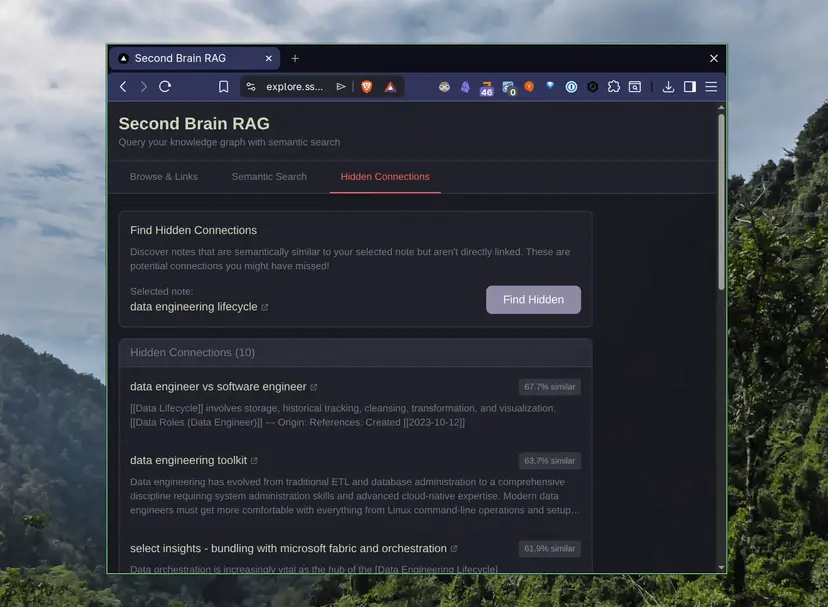

Obsidian 노트에 AI 검색을 붙인다면? DuckDB로 만드는 개인 지식 어시스턴트

Obsidian 노트 8천 개에 AI 검색을 붙인 사례. DuckDB를 벡터 DB로 활용해 의미 기반 검색과 숨겨진 연결을 찾는 방법을 소개합니다.

Written by

OpenAI의 사내 데이터 에이전트, 600페타바이트 속에서 답 찾는 법

OpenAI가 600페타바이트 데이터를 자연어로 분석하는 사내 에이전트 아키텍처 공개. 코드 크롤링, 6개 레이어 컨텍스트, 자가 수정 메커니즘 분석.

Written by

작은 LLM을 똑똑하게 만드는 법, Docker의 RAG 실전 가이드

30억 파라미터 작은 LLM으로 Claude를 뛰어넘기. Docker의 RAG 실전 가이드로 로컬 AI 활용법과 최적화 노하우를 소개합니다.

Written by

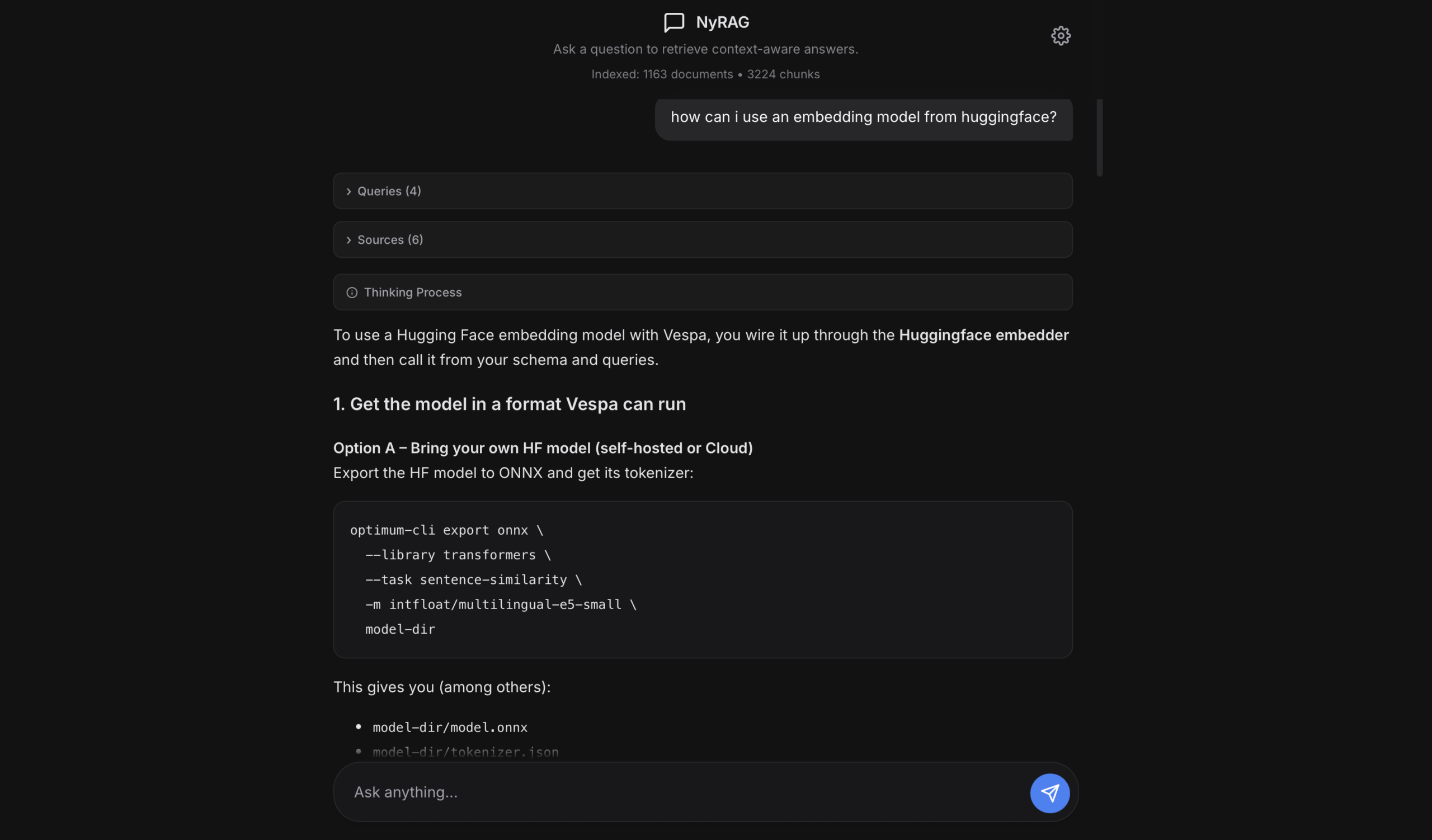

RAG 앱 구축을 설정 파일 하나로, NyRAG의 5단계 파이프라인

설정 파일만으로 RAG 앱을 구축하는 NyRAG의 5단계 파이프라인과 기술 아키텍처를 소개합니다. Vespa 기반 하이브리드 검색부터 로컬/클라우드 배포까지.

Written by

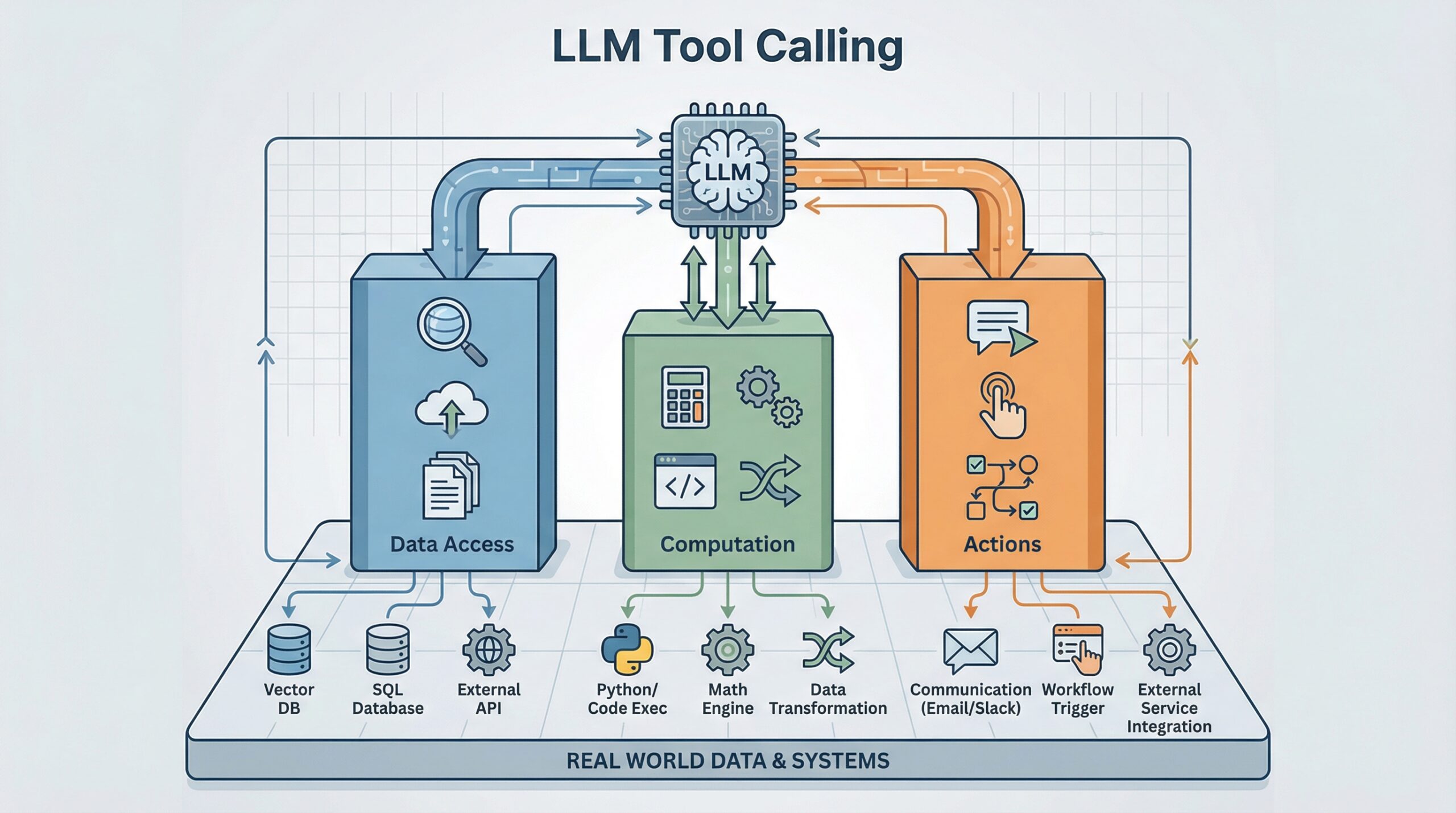

대화만 하는 챗봇을 일 처리하는 에이전트로, Tool Calling 설계법

ChatGPT가 웹 검색하고 코드를 실행하는 비밀, Tool Calling. 데이터·계산·행동 3가지 기둥으로 대화형 챗봇을 실제 일 처리하는 에이전트로 만드는 설계 프레임워크를 소개합니다.

Written by

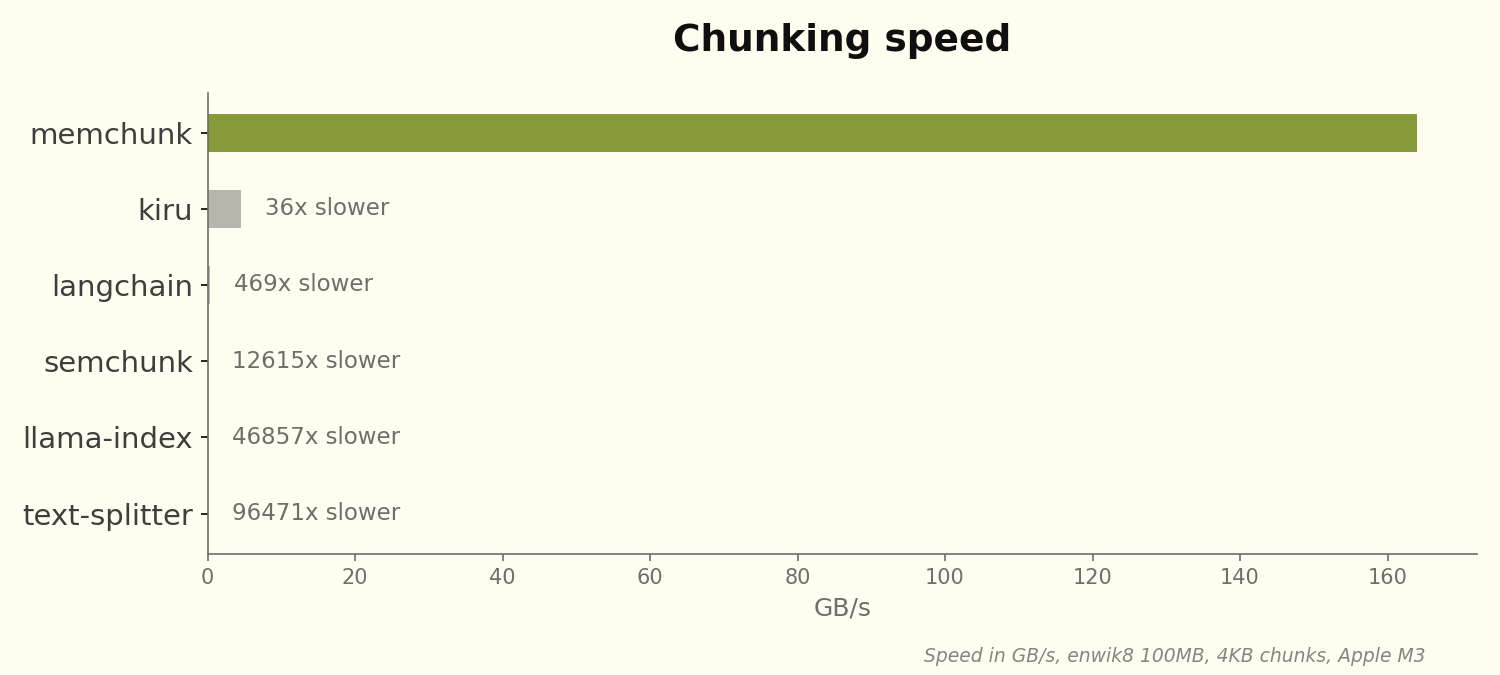

텍스트 청킹 164GB/s로 만들기: memchr와 SIMD로 기존 라이브러리 96,000배 빠르게

RAG 파이프라인용 텍스트 청킹을 164GB/s로 처리하는 memchunk. SIMD와 룩업 테이블로 기존 라이브러리보다 최대 96,000배 빠른 속도를 달성한 방법을 소개합니다.

Written by

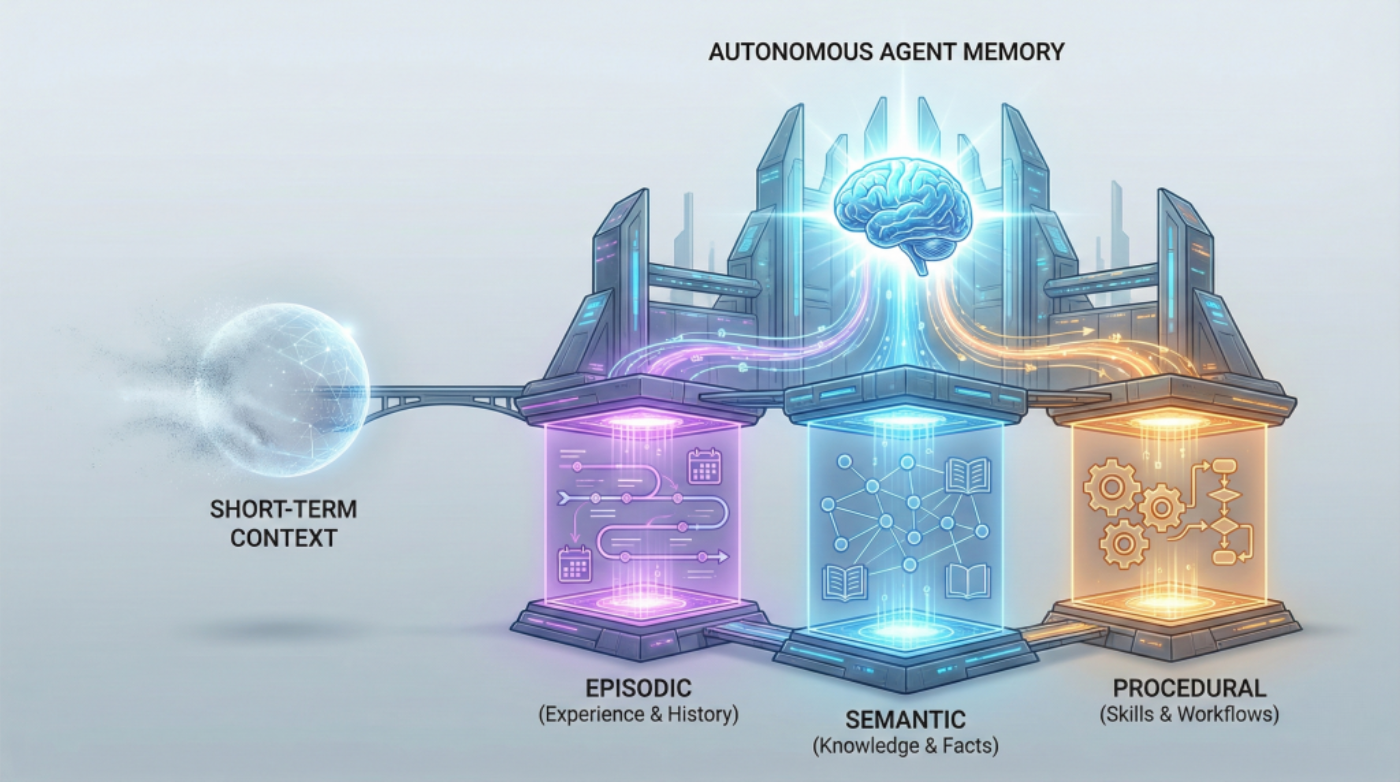

AI 에이전트의 3가지 장기 메모리: 경험·지식·스킬을 저장하는 기술

자율 AI 에이전트가 진정한 자율성을 갖추려면 3가지 장기 메모리가 필요합니다. 에피소드·의미론·절차 메모리의 역할과 구현 방법을 기술적으로 설명합니다.

Written by

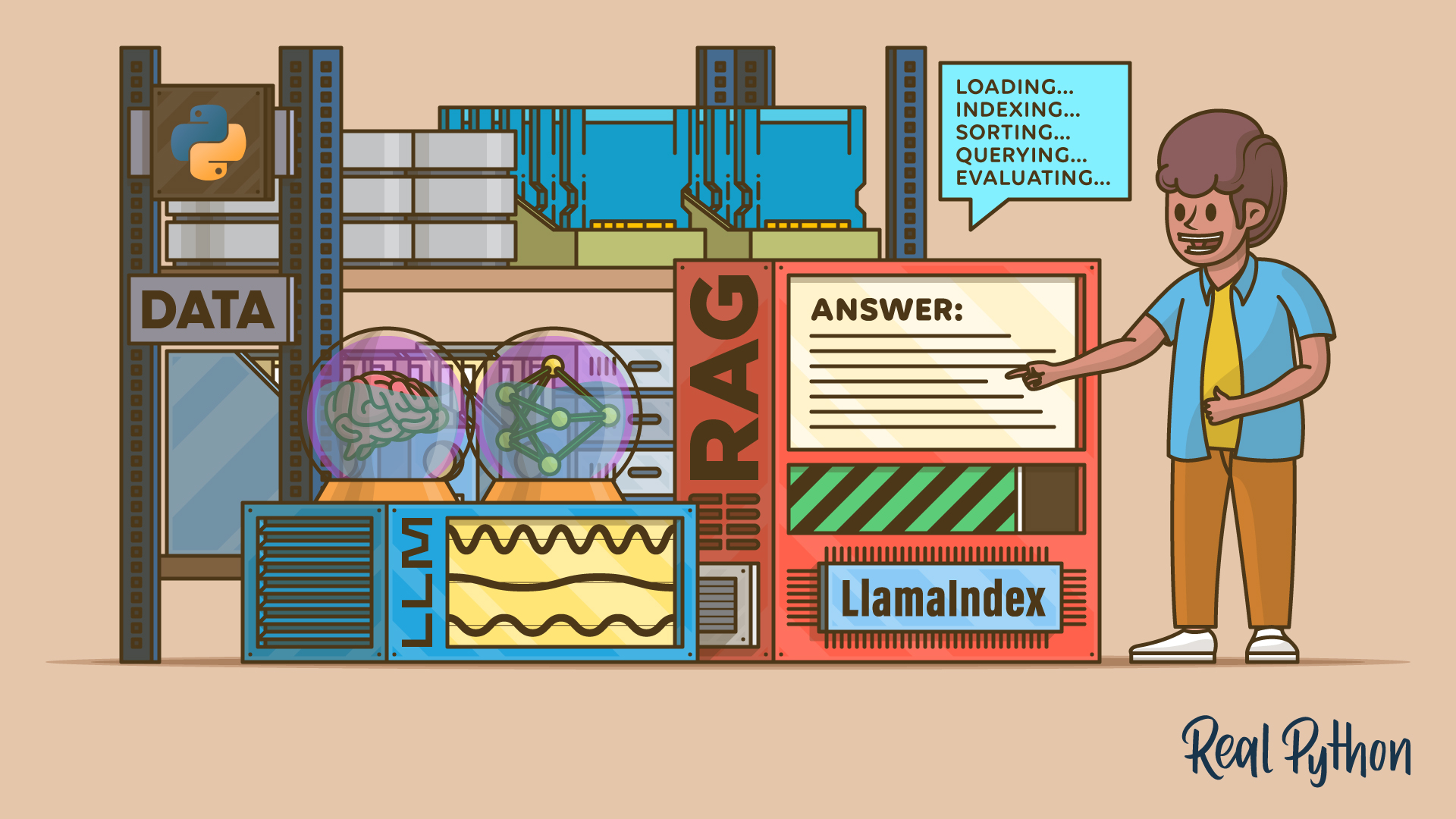

LlamaIndex RAG 실전 가이드: 인덱스 재사용으로 비용 90% 줄이기

LlamaIndex로 RAG 앱을 만들 때 인덱스 재사용으로 비용을 90% 줄이고, LLM을 자유롭게 교체하고, 비동기 쿼리로 성능을 높이는 실전 패턴을 소개합니다.

Written by

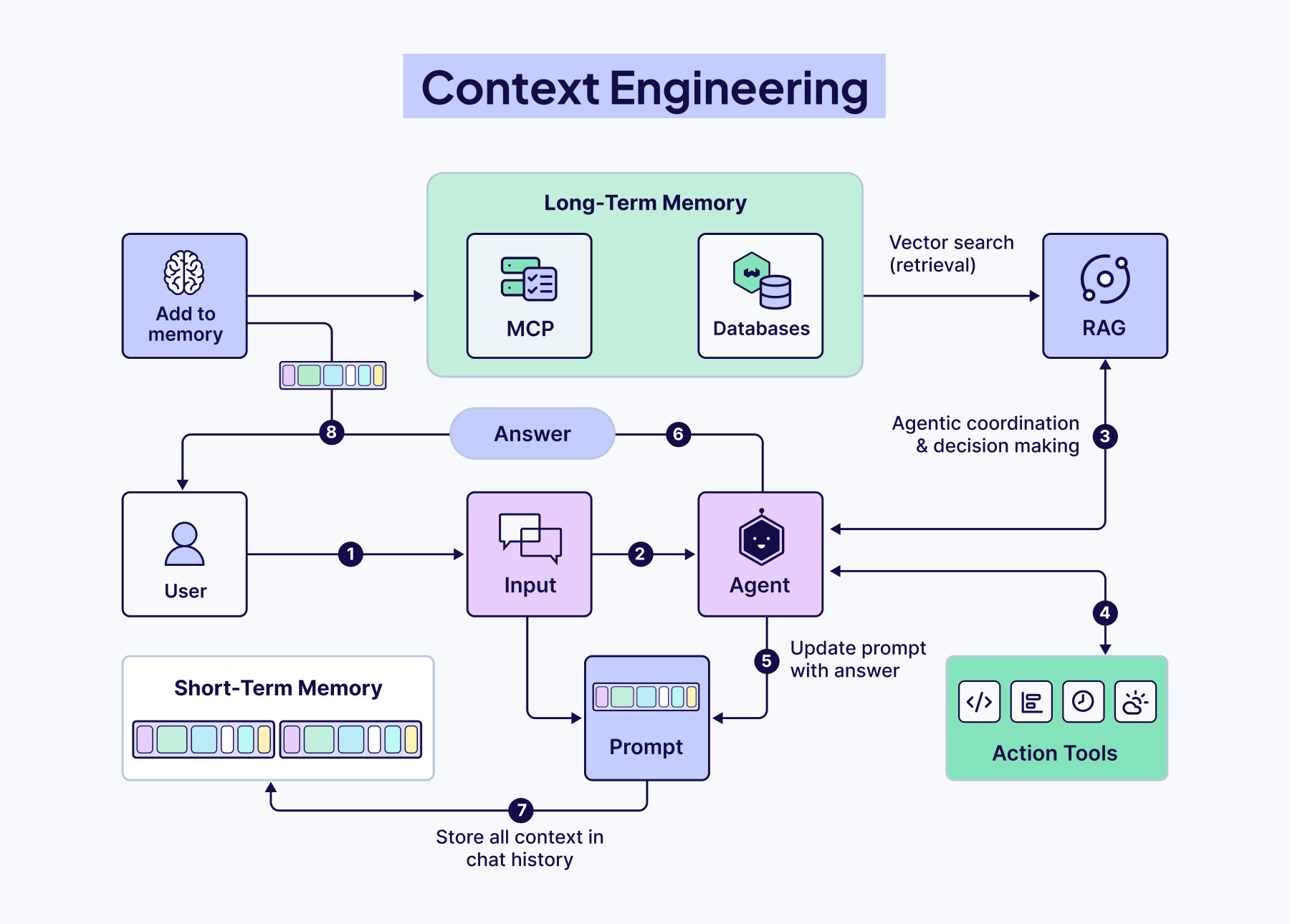

프롬프트 잘 쓴다고 끝? AI 시스템 실패의 진짜 원인은 컨텍스트 설계

LLM 앱이 데모를 넘어서지 못하는 이유는 프롬프트가 아닌 컨텍스트 설계에 있습니다. Weaviate가 제시하는 Context Engineering의 6가지 핵심 요소를 소개합니다.

Written by

26조 원 AI 검색 스타트업 Perplexity, 뉴욕타임스에 제소당하다

26조 원 가치 AI 검색 스타트업 Perplexity가 뉴욕타임스에 제소당했습니다. 페이월 콘텐츠를 실시간으로 가져오는 RAG 기술이 쟁점입니다.

Written by